学习向导¶

本节给出AMCT(Ascend Model Compression Toolkit,简称AMCT)的概念以及优势、文档的使用对象,并给出不同框架下AMCT的差异,用户根据场景选择不同框架进行模型压缩。

AMCT是一个针对昇腾芯片亲和的深度学习模型压缩工具包,提供量化、张量分解等多种模型压缩特性,压缩后模型体积变小,部署到NPU IP加速器上后可使能低比特运算,提高计算效率,达到性能提升的目标。

AMCT基于开源框架运作,实现了神经网络模型中数据与权重低比特量化、张量分解、模型部署优化(主要为算子融合)的功能,该工具优点如下:

使用方便,基于用户原有的框架环境,安装工具包即可。

接口简单,在用户基于开源框架的推理脚本基础上,调用API即可完成模型压缩,压缩后的模型支持在CPU和GPU运行。

与硬件配套,生成的压缩模型经过ATC工具转换后可在NPU IP加速器上实现低比特推理。

量化可配置,用户可自行修改量化配置文件,调整压缩策略,获取较优的压缩结果。

AMCT当前使用的压缩方法主要包括量化和张量分解,量化过程中可以实现模型部署优化(主要为算子融合)。

各种压缩方式优缺点比较

表 1 压缩方式比较

压缩方式 |

优点 |

缺点 |

支持框架 |

支持产品型号 |

|

|---|---|---|---|---|---|

量化 |

训练后量化 |

|

依赖校准数据集分布情况,如果校准数据集与验证数据集分布差异较大,会导致量化结果差;没有对权重进行重训练,量化后模型精度掉点较大。 |

|

IPV350 |

量化感知训练 |

|

|

|

IPV350 |

|

稀疏 |

通道稀疏 |

|

|

|

不支持该特性 |

4选2结构化稀疏 |

稀疏的粒度较小,可以保留较多重要信息,具有细粒度稀疏的精度优势。 |

|

|

不支持该特性。 |

|

组合压缩 |

- |

可以同时对模型进行量化和稀疏,得到更高的压缩率。 |

涉及重训练,过程比较耗时;同步进行了量化和稀疏,对模型精度影响大。 |

|

不支持该特性 |

张量分解 |

- |

将卷积核分解为低秩张量,降低存储空间和计算量 |

- |

|

不支持该特性 |

自动混合精度搜索 |

- |

解决用户手动调优困难,自动对每一层计算精度配置给出较优解。 |

- |

|

不支持该特性 |

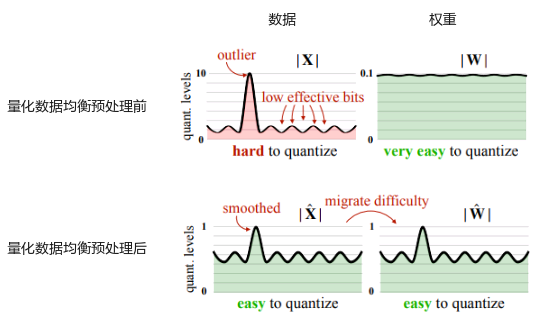

量化数据均衡预处理 |

- |

降低activation离群值对于量化后模型精度的影响。 |

- |

|

IPV350 |

逐层蒸馏 |

- |

在量化的基础上可以对权重进行微调,在保障较高精度的同时,对比重训练有更短的执行时长。 |

- |

PyTorch |

不支持该特性 |

AMCT各框架差异

手册 |

介绍 |

|---|---|

AMCT(PyTorch) |

针对PyTorch框架模型进行的压缩,需要搭建PyTorch环境,搭建完成后安装AMCT工具。 |

AMCT(ONNX) |

针对ONNX模型进行的压缩,需要搭建ONNX Runtime环境,搭建完成后安装AMCT工具。 |

AMCT(TensorFlow)(不支持) |

针对TensorFlow框架模型进行的压缩,需要搭建TensorFlow环境,搭建完成后安装AMCT工具。 如下产品型号不支持TensorFlow框架: IPV350 |

AMCT(Caffe)(不支持) |

针对Caffe框架模型进行的压缩,需要搭建Caffe环境,搭建完成后安装AMCT工具。 如下产品型号不支持Caffe框架: IPV350 |

使用对象

本文档用于指导开发者如何使用AMCT工具进行模型压缩,通过本文档您可以达成以下目标:

了解AMCT不同的压缩方法。

能够基于文档中提供的方法,完成不同模型的压缩。

掌握常用的压缩方法:量化。

熟悉Linux基本命令、具备Python语言程序开发能力,对机器学习、深度学习有一定了解的人员,可以更好地理解本文档。

概述¶

本节给出模型压缩过程中用到的概念,并介绍了不同压缩方法的原理。 本节介绍使用AMCT工具的具体流程,不同框架运行环境以及流程会有稍许差异。

基本概念¶

本节给出模型压缩过程中用到的概念,并介绍了不同压缩方法的原理。

量化

量化是指对模型的权重(weight)和数据(activation)进行低比特处理,让最终生成的网络模型更加轻量化,从而达到节省网络模型存储空间、降低传输时延、提高计算效率,达到性能提升与优化的目标。

AMCT将量化和模型转换分开,实现对模型中可量化算子的独立量化,并输出量化后的模型。其中量化后的仿真模型可以在CPU或者GPU上运行,完成精度仿真;量化后的部署模型可以部署在NPU IP加速器上运行,达到提升推理性能的目的。

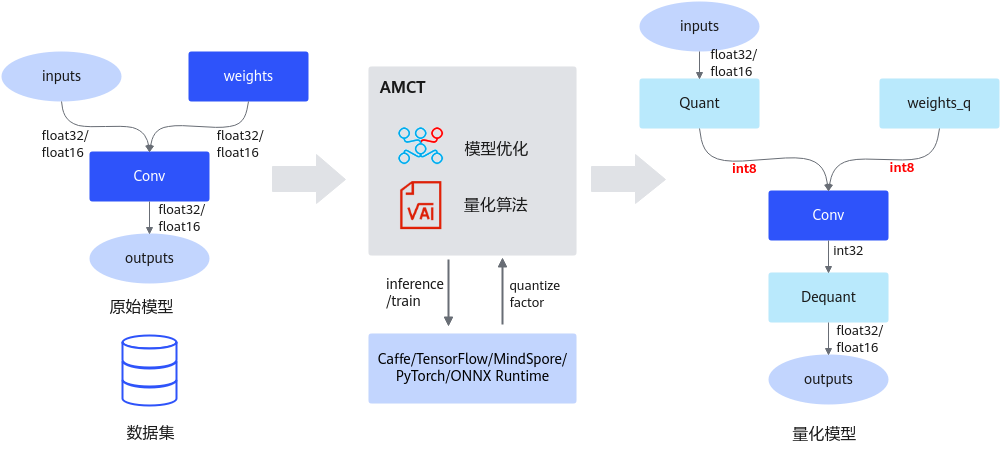

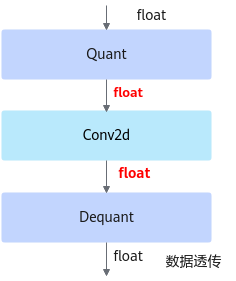

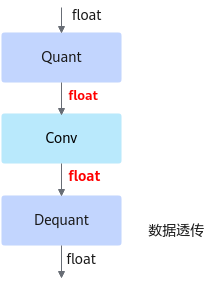

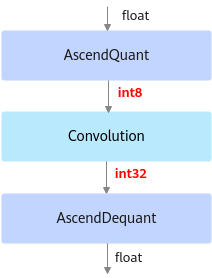

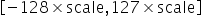

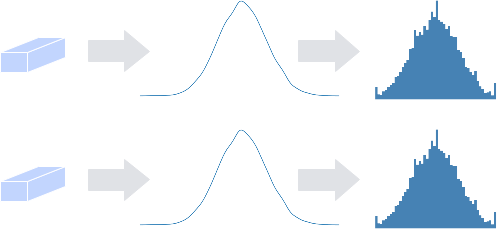

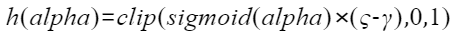

当前该工具仅支持对float32/float16数据类型的网络模型进行量化(Caffe框架、MindSpore框架不支持float16类型),以量化到INT8数据类型为例,其运行原理如下图所示。

图 1 量化运行原理

量化根据是否需要重训练,分为训练后量化(Post-Training Quantization,简称PTQ)和量化感知训练(Quantization-Aware Training,简称QAT),概念解释如下:

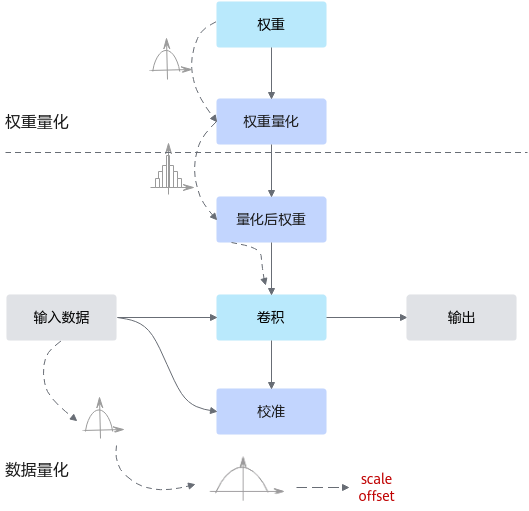

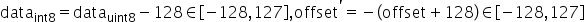

训练后量化

训练后量化是指在模型训练结束之后进行的量化,对训练后模型中的权重由浮点数量化到低比特整数,并通过少量校准数据基于推理过程对数据(activation)进行校准量化,从而尽可能减少量化过程中的精度损失。训练后量化简单易用,只需少量校准数据,适用于追求高易用性和缺乏训练资源的场景。

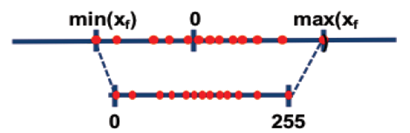

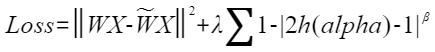

通常,训练后的模型权重已经确定,因此可以根据权重的数值离线计算得到权重的量化参数。而通常数据是在线输入的,因此无法准确获取数据的数值范围,通常需要一个较小的有代表性的数据集来模拟在线数据的分布,利用该数据集执行前向推理,得到对应的中间浮点结果,并根据这些浮点结果离线计算出数据的量化参数。其原理如下图所示。

图 2 训练后量化原理

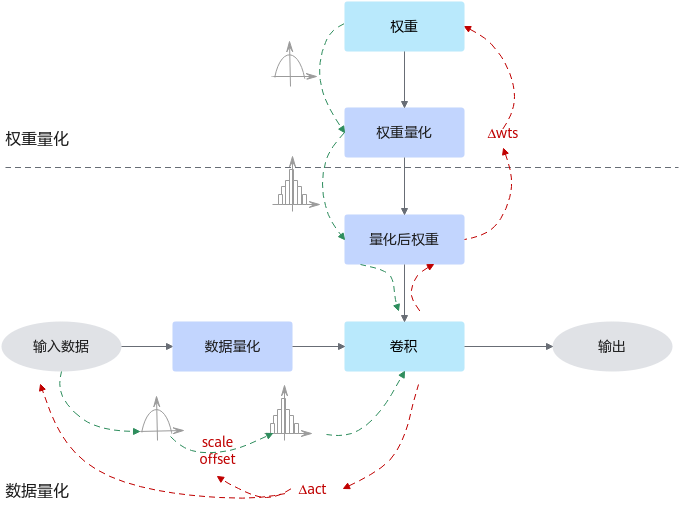

量化感知训练

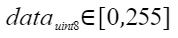

量化感知训练是指在重训练过程中引入量化,通过重训练提高模型对量化效应的能力,从而获得更高的量化模型精度的一种量化方式。量化感知训练借助用户完整训练数据集,在训练过程中引入伪量化的操作(从浮点量化到定点,再还原到浮点的操作),用来模拟前向推理时量化带来的误差,并借助训练让模型权重能更好地适应这种量化的信息损失,从而提升量化精度。

通常,量化感知训练相比训练后量化,精度损失会更小,但主要缺点是整体量化的耗时会更长;此外,量化过程需要的数据会更多,通常是完整训练数据集。

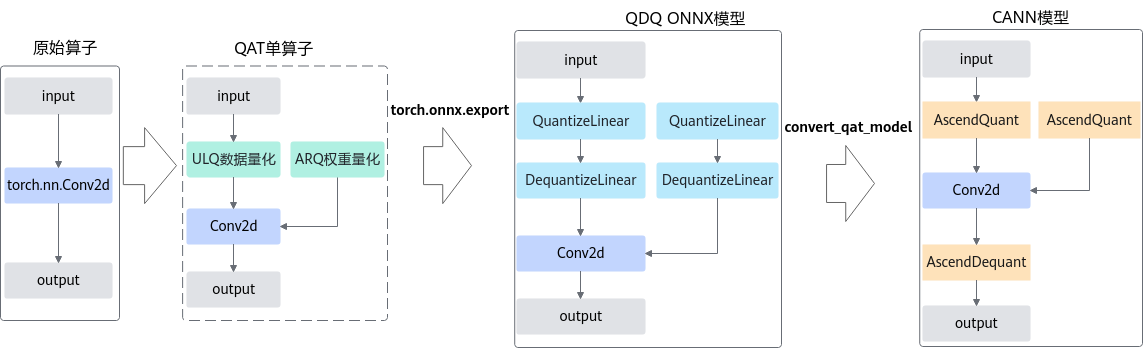

其运行原理如下图所示。

图 3 量化感知训练原理

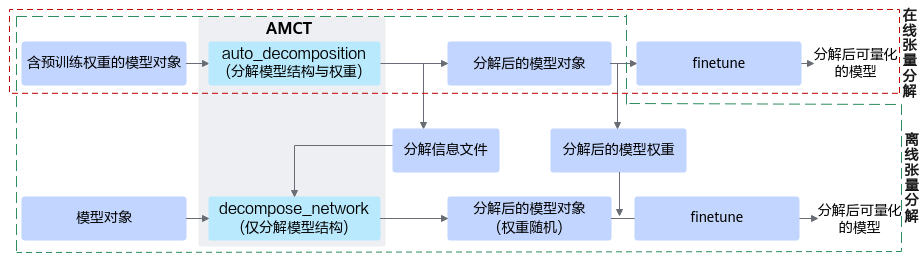

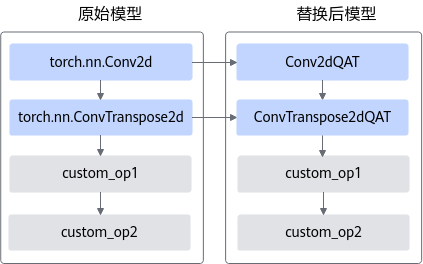

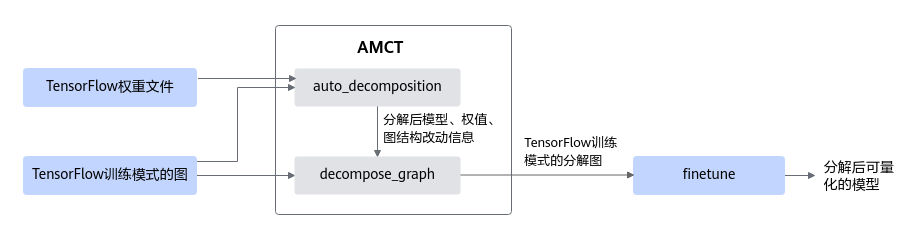

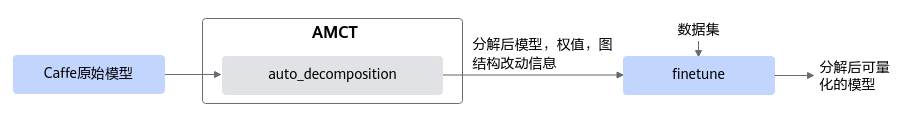

张量分解(不支持该特性)****

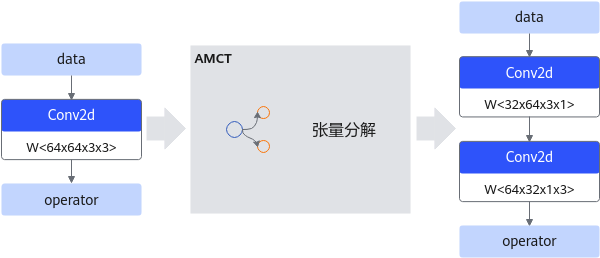

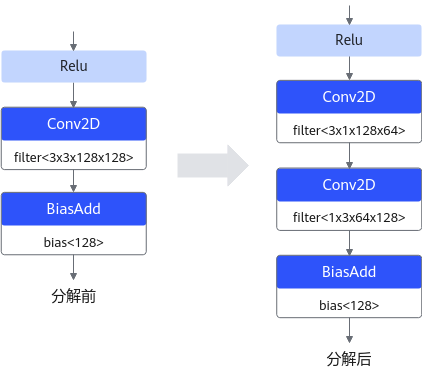

深度学习运算,尤其是CV(计算机视觉)类任务运算,包含大量的卷积运算,而张量分解通过分解卷积核的张量,可以将一个大卷积核分解为两个小卷积核的连乘,即将卷积核分解为低秩的张量,从而降低存储空间和计算量,降低推理开销。

以1个64*64*3*3的卷积分解为32*64*3*1和64*32*1*3的级联卷积为例,可以减少1 - (32*64*3*1 + 64*32*1*3) / 64*64*3*3 = 66.7%的计算量,在计算结果近似的情况下带来更具性价比的性能收益。张量分解运行原理如下图所示(以PyTorch框架为例)。

图 4 张量分解运行原理

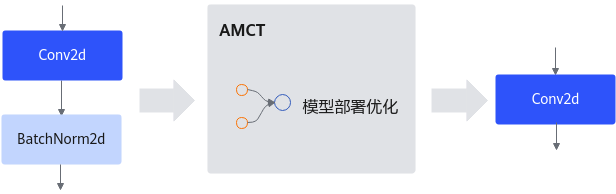

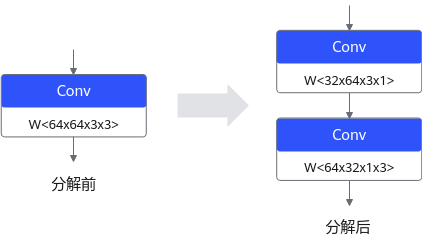

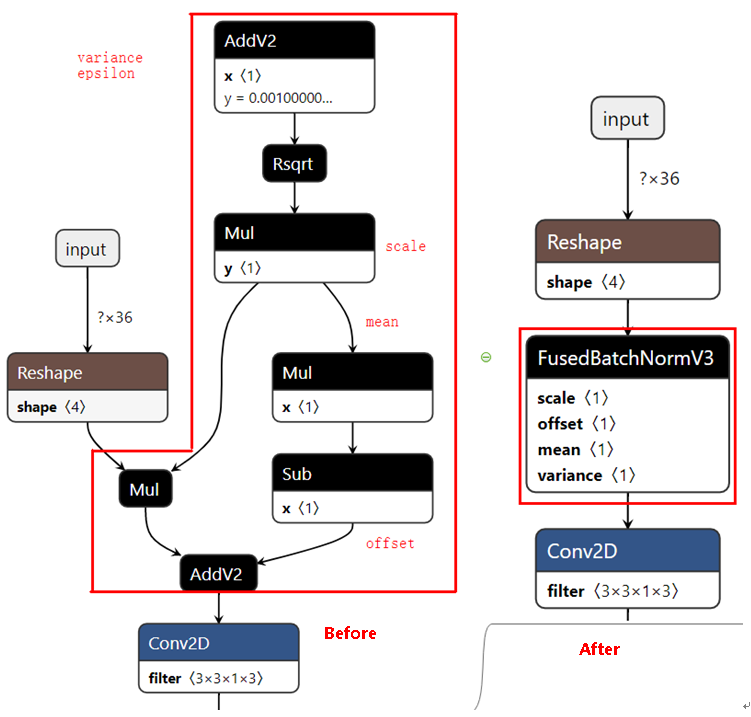

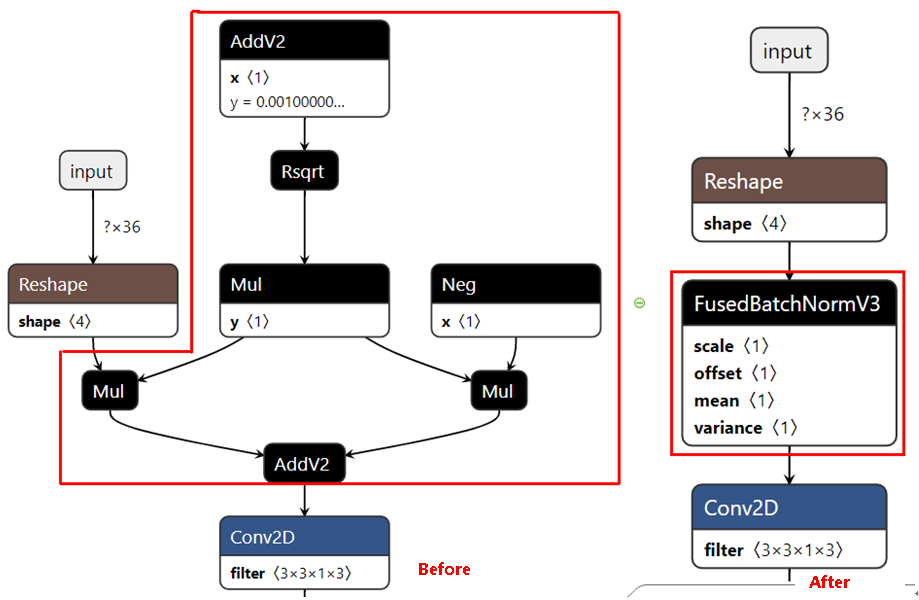

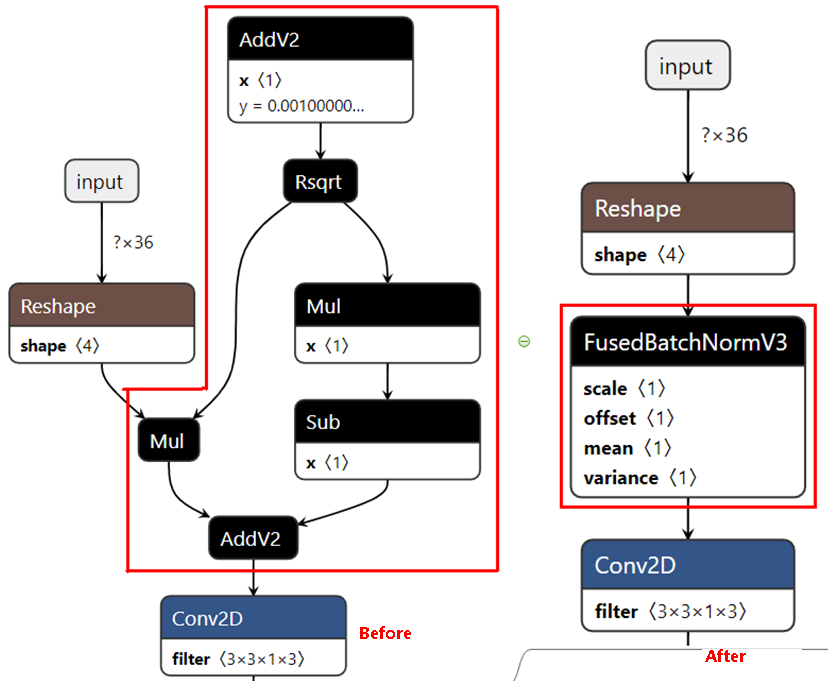

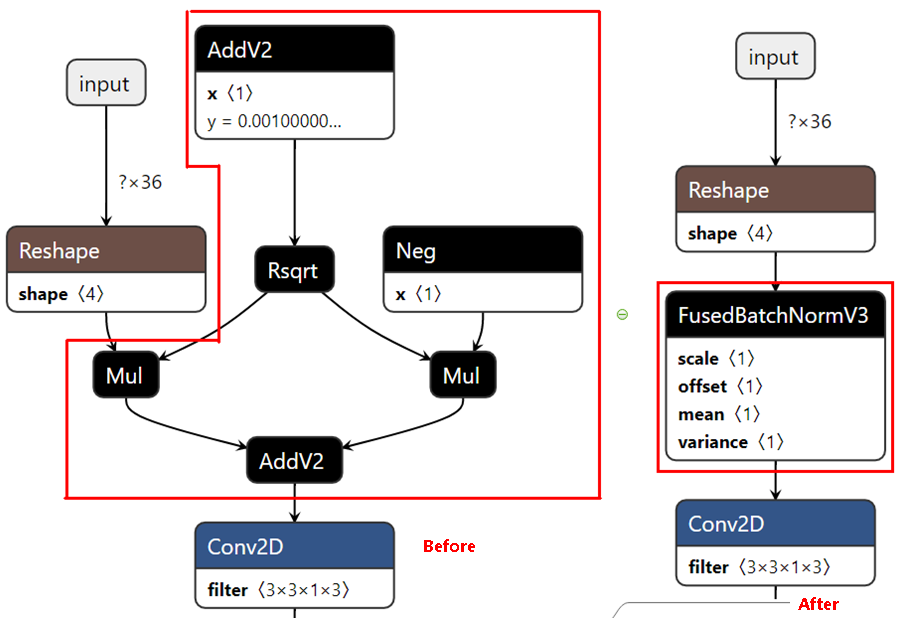

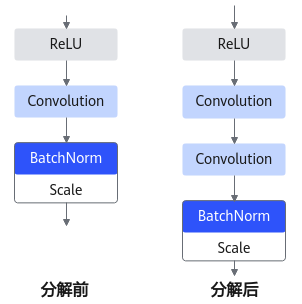

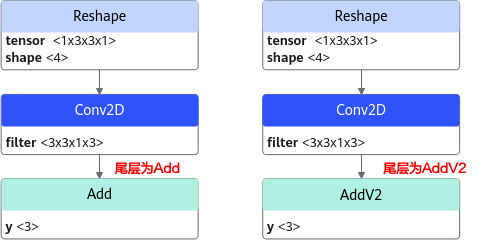

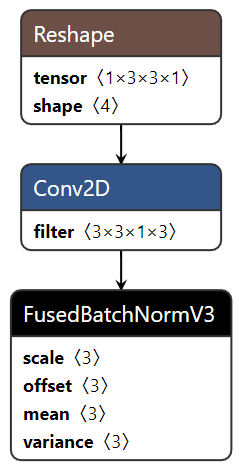

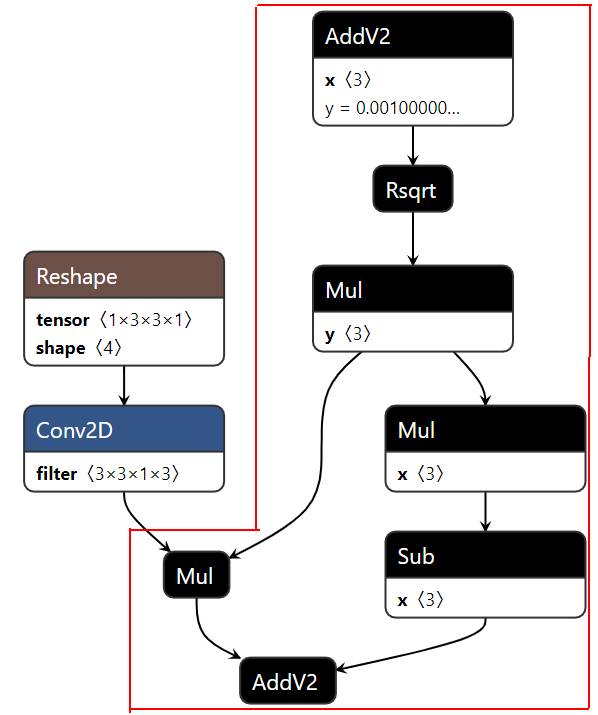

模型部署优化(不支持该特性)****

主要为算子融合,是指通过数学等价,将模型中的多个算子运算融合单算子运算,以减少实际前向过程中的运算量,如将卷积层和BN层融合为一个卷积层。

其运行原理如下图所示(以PyTorch框架为例)。

图 5 模型部署优化原理

稀疏(不支持该特性)****

稀疏是通过结构剪枝的方式,对模型中的部分算子实现权重的稀疏化,从而得到一个参数量更小、计算量更小的网络模型。AMCT目前有两种稀疏方式:通道稀疏和4选2结构化稀疏。每次只能使能其中一种稀疏方式,即对于同一层可压缩算子,通道稀疏和4选2结构化稀疏不能同时配置。

通道稀疏与4选2结构化稀疏相比,稀疏颗粒度更大,对模型的精度影响也越大,但是能够获取到的性能收益也越大,用户可以根据实际情况选择一种稀疏方式。

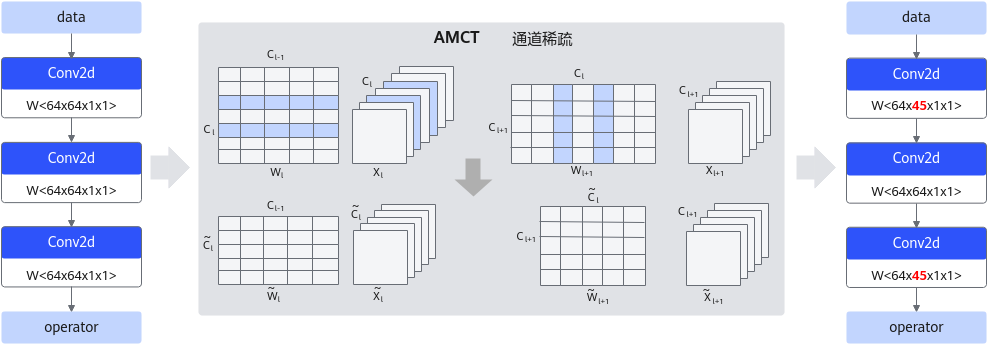

通道稀疏

通道稀疏基于重训练,通过裁剪网络通道数,在保持网络功能的前提下缩减模型参数量,从而降低整网的计算量。由于通道稀疏本身是依据通道的重要性进行裁剪,会裁剪掉重要性相对较低的通道,但是直接裁剪通道对网络精度影响较大,故裁剪后的模型需要进行重训练,以保证业务精度。通道稀疏的实现通常包括两个步骤:首先是通道选择,需要选择合适的通道组合以保留丰富的信息;然后是重建,需要使用选择的通道对下一层的输出进行重建。通道稀疏原理如下图所示。

图 6 通道稀疏示意图

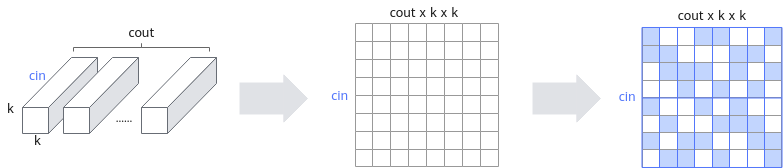

4选2结构化稀疏

由于硬件约束,该芯片不支持4选2结构化稀疏特性:使能后获取不到性能收益。

4选2结构化稀疏基于重训练,在每4个连续的权重中保留2个重要性相对较高的权重,其余权重置0。因为稀疏的粒度较小,因此4选2结构化稀疏可以保留较多重要信息,具有细粒度稀疏的精度优势;同时4选2结构化稀疏在专门设计的硬件上可以降低运算量,具有结构化稀疏的性能优势。与通道稀疏不同的是,4选2稀疏并不改变权重的形状,因此不会影响上层或下层的算子。

原理如下图所示,在cin维度上相邻的4个元素为一组,在每组4个元素中保留绝对值最大的两个元素,如果cin不是4的倍数,填0补齐到4的倍数。

图 7 4选2稀疏示意图

组合压缩(不支持该特性)****

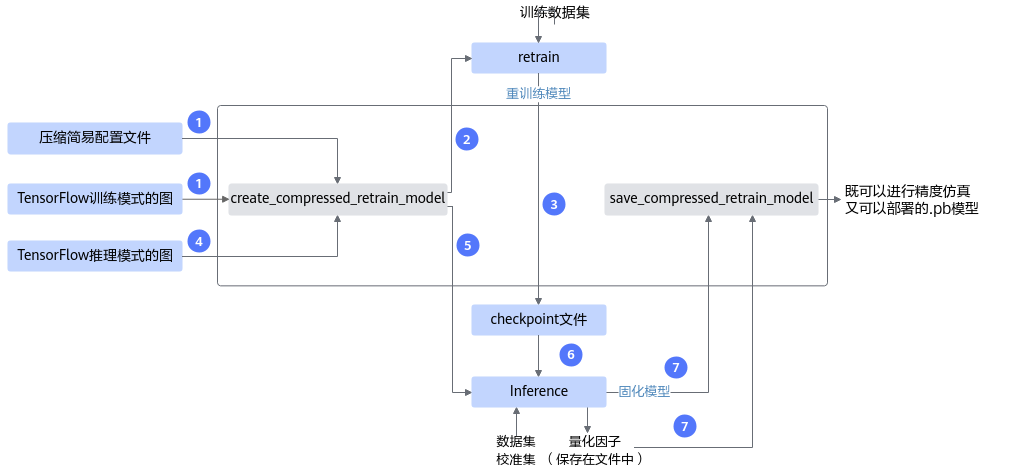

组合压缩是结合了稀疏和量化的特性,根据配置文件先进行稀疏,然后进行量化;在稀疏时根据相应算法插入稀疏算子,然后量化时,对稀疏后的模型插入数据和权重的量化层和SearchN的层,生成组合压缩模型,以期望得到更高的性能收益。生成组合压缩模型后,对模型进行重训练,保存为既可以进行精度仿真又可以部署的量化模型。

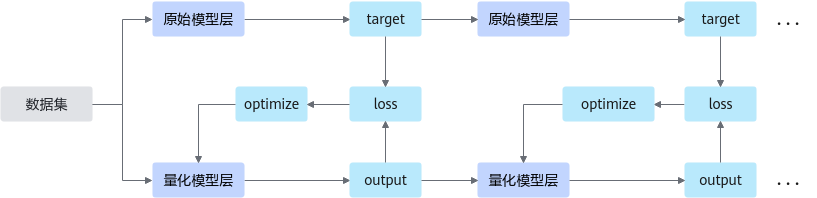

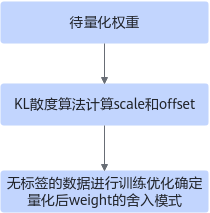

逐层蒸馏(不支持该特性)****

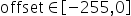

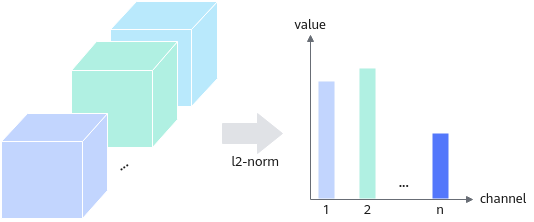

蒸馏量化是模型压缩的一种方法,利用原始模型的监督信息,对量化模型进行训练,以达到更好量化精度的目的。

将预训练好的原始模型作为教师网络,以教师网络层的输出做为目标,对学生网络进行监督训练,通过计算教师网络和学生网络输出预测值的损失,进行梯度更新,最终得到一个更高精度的量化模型。

相比训练后量化,知识蒸馏的量化可以取得更好的精度结果。

相比量化感知训练,知识蒸馏的量化不需要有标签的数据集,且可以在更短的量化时间内获得不错的量化结果。

图 8 逐层蒸馏示意图

工具运行流程¶

本节介绍使用AMCT工具的具体流程,不同框架运行环境以及流程会有稍许差异。

PyTorch/ONNX/TensorFlow/Caffe场景

如下产品型号不支持Caffe框架:

IPV350

如下产品型号不支持TensorFlow框架:

IPV350

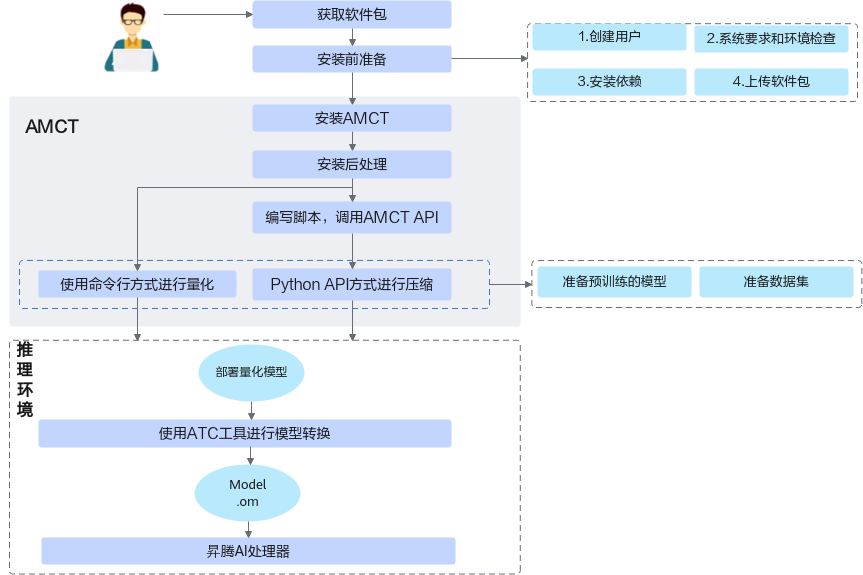

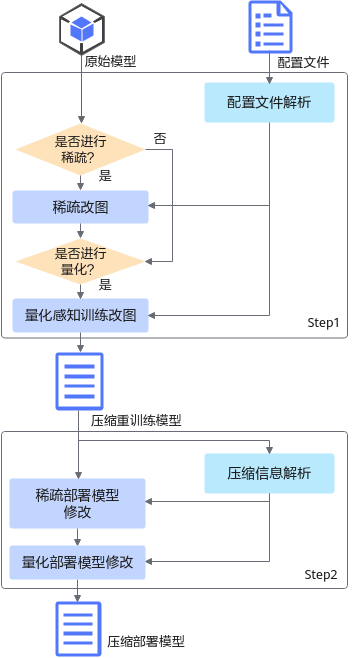

具体运行流程如图1所示。

图 1 运行流程

表 1 运行流程关键操作步骤说明

关键步骤 |

说明 |

|---|---|

获取软件包 |

安装前请先获取对应软件包,详情请参见获取软件包。 |

安装前准备 |

安装AMCT之前,需要创建AMCT的安装用户,检查系统环境是否满足要求,安装依赖以及上传软件包等一系列动作。详细操作请参见安装前准备。 不同框架环境配置不同,请参见对应框架进行操作。 |

安装 |

参见安装工具章节安装AMCT工具,不同框架安装命令不同,请参见对应框架安装步骤进行操作。 |

安装后处理 |

安装完AMCT后,需要参见安装后处理章节执行相关操作,没有该章节的框架,则忽略此步骤。 |

(可选)编写脚本,调用AMCT API |

如果使用AMCT提供的sample进行模型压缩,则可以直接调用本手册中的API; 如果用户需要压缩自己的网络模型,不使用本手册提供的sample链接进行压缩,则需要修改压缩脚本,进行适配,然后才能进行压缩。 |

压缩 |

执行压缩操作。 关于量化特性,AMCT提供了两种量化方法,命令行方式量化和调用Python API接口方式,两种方式详细区别请参见表1。

用户根据准备的原始网络模型以及数据集,采用本手册提供的量化脚本或者命令行,进行量化。 AMCT是基于深度学习框架进行开发的,在执行压缩过程中需要调用深度学习框架进行必要的推理或训练过程。 |

(后续处理)压缩后模型的推理 |

用户使用上述压缩后的部署模型,通过ATC工具转换成适配NPU IP加速器的离线模型,然后可以使用该模型进行推理。 |

准备环境¶

介绍安装前的准备动作,包括准备用户、检查环境、安装依赖、上传软件包等。 本节介绍AMCT工具具体的安装命令。

获取软件包¶

AMCT仅支持在Ubuntu 20.04 x86_64架构服务器安装;安装前,请先获取AMCT软件包:CANN-amct-{software version}-linux.x86_64.tar.gz

其中_{software version}_表示软件包具体版本号。

软件数字签名验证

为了防止软件包在传递过程或存储期间被恶意篡改,下载软件包时需下载对应的数字签名文件用于完整性验证。

在软件包下载之后,请参考《OpenPGP签名验证指南》,对从Support网站下载的软件包进行PGP数字签名校验。如果校验失败,请不要使用该软件包,先联系技术支持解决。

使用软件包安装/升级之前,也需要按上述过程先验证软件包的数字签名,确保软件包未被篡改。

安装前准备¶

介绍安装前的准备动作,包括准备用户、检查环境、安装依赖、上传软件包等。

用户准备¶

PyTorch/ONNX场景

支持任意用户(root或者非root)安装AMCT,本章节以非root用户为例进行操作。

若使用root用户安装,则不需要操作该章节,不需要对root用户做任何设置。

若使用已存在的非root用户安装,须保证该用户对$HOME目录具有读写以及可执行权限。

若使用新的非root用户安装,请参考如下步骤进行创建,如下操作请在root用户下执行。本手册以该种场景为例执行AMCT的安装。

执行以下命令创建AMCT安装用户并设置该用户的$HOME目录。

useradd -d /home/username -m username执行以下命令设置密码。

passwd username 说明:

_username_为安装AMCT的用户名,该用户的umask值不能小于0027:

说明:

_username_为安装AMCT的用户名,该用户的umask值不能小于0027:若要查看umask的值,则执行命令**:umask**

若要修改umask的值,则执行命令:umask 新的取值

系统要求和环境检查¶

AMCT(PyTorch)¶

AMCT目前支持在Ubuntu 22.04 x86_64架构操作系统安装,版本配套信息如下:

表 1 配套版本信息

类别 |

版本限制 |

获取方式 |

注意事项 |

|---|---|---|---|

PyTorch |

2.1.0

|

用户根据实际情况选择安装CPU或GPU,请参见安装依赖。 |

|

CUDA toolkit/CUDA driver |

11.8

|

请用户自行获取相关软件包进行安装,例如可以参见如下链接获取相关toolkit包,该包中包括driver软件包。 |

如果使用GPU模式执行量化功能,则CUDA软件必须安装。 |

ONNX |

1.14.0 |

请参见安装依赖。 |

|

ONNX Runtime |

1.16.0 |

||

Python |

Python3.10.x、Python3.11.x 推荐使用3.10.0 |

Ubuntu操作系统请参见安装Python3.9.2(Ubuntu)。 |

|

numpy |

|

请参见安装依赖。 |

|

protobuf |

|

AMCT(ONNX)¶

AMCT目前支持在Ubuntu 22.04 x86_64架构操作系统安装,版本配套信息如下:

表 1 配套版本信息

类别 |

版本限制 |

获取方式 |

注意事项 |

|---|---|---|---|

操作系统及版本 |

Ubuntu 22.04 x86_64 |

请从Ubuntu官网下载对应版本软件进行安装,安装完成后查询命令为: cat /etc/*release && uname -m |

支持基于CPU,GPU的量化。 |

ONNX和Opset |

1.14.0

|

请参见安装依赖。 |

|

ONNX Runtime |

1.16.0 |

ONNX执行框架,请参见安装依赖。 |

|

CUDA、cuDNN |

|

请用户自行获取相关软件包进行安装。 CUDA获取路径:https://developer.nvidia.com/cuda-toolkit-archive cuDNN获取路径:https://developer.nvidia.com/zh-cn/cudnn |

如果使用ONNX Runtime GPU模式执行量化功能,则CUDA、cuDNN软件必须安装。 |

Python |

Python3.10.x、Python3.11.x 推荐使用Python 3.10.0 |

Ubuntu操作系统请参见安装Python3.9.2(Ubuntu)。 |

|

numpy |

|

请参见安装依赖。 |

|

protobuf |

|

AMCT(TensorFlow)¶

IPV350不支持

表 1 配套版本信息

类别 |

版本限制 |

获取方式 |

备注 |

|---|---|---|---|

CUDA toolkit/CUDA driver |

11.2或10.0 |

请用户自行获取相关软件包进行安装,例如可以参见如下链接获取相关toolkit包,该包中包括driver软件包。 |

如果使用GPU模式执行量化功能,则CUDA软件必须安装。

|

Python |

Python3.7.x、Python3.8.x、Python3.9.x 推荐使用Python3.9.2 |

Ubuntu操作系统请参见安装Python3.9.2(Ubuntu)。 |

|

TensorFlow |

2.6.5或1.15.0 |

请参见安装依赖。 |

TensorFlow版本与Python版本的对应关系:

|

numpy |

1.16.0~1.23.5或1.20.0~1.23.5 |

请参见安装依赖。 |

|

protobuf |

3.13.0+ |

请参见安装依赖。 |

- |

AMCT(Caffe)¶

IPV350不支持

表 1 配套版本信息

类别 |

版本限制 |

获取方式 |

备注 |

|---|---|---|---|

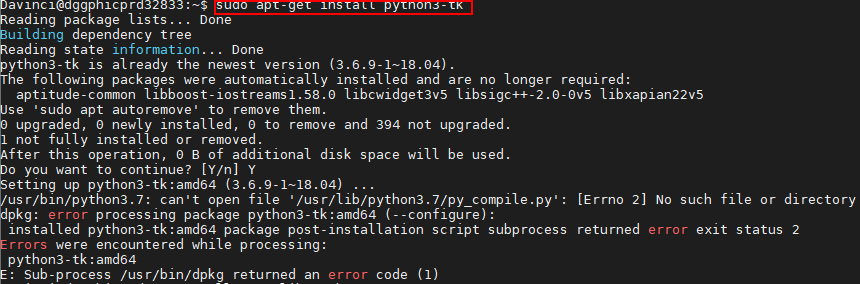

Caffe环境 |

caffe-master分支 当前仅支持commit id为9b891540183ddc834a02b2bd81b31afae71b2153的版本 |

请参考Caffe官方指导准备Caffe环境:https://github.com/BVLC/caffe/tree/master。 推荐使用源码方式安装Caffe环境,如果使用命令行方式安装,出现类似"/usr/bin/python3.7: can't open file '/usr/lib/python3.7/py_compile.py': [Error 2] No such file or directory"信息时,请参见使用命令行方式安装Caffe环境失败解决。 |

- |

CUDA toolkit/CUDA driver |

11.3或10.0 |

请用户自行获取相关软件包进行安装,例如可以参见如下链接获取相关toolkit包,该包中包括driver软件包。 |

如果使用GPU模式执行量化功能,则CUDA软件必须安装。 说明:

使用Ubuntu 20.04的情况下,推荐安装11.3版本CUDA软件。Ubuntu 20.04默认GCC版本为GCC9,如果使用10.0版本CUDA软件,因其配套GCC7版本,需要对默认的GCC版本进行降级,具体操作步骤请参见使用Ubuntu 20.04安装Caffe环境时,出现CUDA和GCC版本不匹配的编译报错。 |

Python |

Python3.7.x、Python3.8.x、Python3.9.x 推荐使用Python3.9.2 |

Ubuntu操作系统请参见安装Python3.9.2(Ubuntu)。 |

|

numpy |

1.20.0+ |

请参见安装依赖。 |

|

protobuf |

3.13.0+ |

安装依赖¶

AMCT(PyTorch)¶

请使用AMCT的安装用户安装依赖的软件,如果安装用户为非root,请确保该用户拥有sudo权限,请使用**su - username**命令切换到非root用户执行如下命令(如果安装用户为root,请将安装依赖命令中的--user删除)。

表 1 依赖列表

依赖名称 |

版本号 |

安装命令 |

|---|---|---|

PyTorch版本的CPU或GPU |

2.1.0 |

安装PyTorch时,请确保pip版本低于23.0.1,否则可能出现如下“ModuleNotFoundError:No module named 'torch' ”错误信息;如果用户pip版本高于23.0.1,且不想降低版本,则请优先安装wheel包(参考安装命令:pip3 install wheel --user),然后再执行后续操作。

|

ONNX |

1.14.0 |

|

ONNX Runtime |

1.16.0 |

|

Python |

以3.9.2版本为例 |

Ubuntu操作系统请参见安装Python3.9.2(Ubuntu)。 |

numpy |

|

|

protobuf |

|

|

AMCT(ONNX)¶

请使用AMCT的安装用户安装依赖的软件,如果安装用户为非root,请确保该用户拥有sudo权限,请使用**su - username**命令切换到非root用户执行如下命令(如果安装用户为root,请将安装依赖命令中的--user删除)。

表 1 依赖列表

依赖名称 |

版本号 |

安装命令 |

|---|---|---|

ONNX |

1.14.0 |

|

ONNX Runtime |

1.16.0 |

ONNX Runtime CPU安装命令请参见下面指导;1.9.0版本以下ONNX Runtime GPU版本需要用户自行安装。

|

Python |

以3.9.2版本为例 |

Ubuntu操作系统请参见安装Python3.9.2(Ubuntu)。 |

numpy |

|

|

protobuf |

|

|

AMCT(TensorFlow)¶

IPV350不支持

请使用AMCT的安装用户安装依赖的软件,如果安装用户为非root,请确保该用户拥有sudo权限,请使用**su - username**命令切换到非root用户执行如下命令(如果安装用户为root,请将安装依赖命令中的--user删除)。

表 1 依赖列表

依赖名称 |

版本号 |

安装命令 |

|---|---|---|

Python |

3.9.2或3.7.5 |

Ubuntu操作系统请参见安装Python3.9.2(Ubuntu)。 |

TensorFlow |

2.6.5或1.15.0 |

用户根据实际情况选择安装CPU或GPU。

须知:

|

numpy |

1.16.0~1.23.5或1.20.0~1.23.5 |

pip3 install numpy==1.16.0 --user 或pip3 install numpy==1.20.0 --user |

protobuf |

3.13.0+ |

pip3 install protobuf==3.13.0 --user |

AMCT(Caffe)¶

IPV350不支持

请使用AMCT的安装用户安装依赖的软件,如果安装用户为非root,请确保该用户拥有sudo权限,请使用**su - username**命令切换到非root用户执行如下命令(如果安装用户为root,请将安装依赖命令中的--user删除)。

表 1 依赖列表

依赖名称 |

版本号 |

安装命令 |

|---|---|---|

Python |

3.9.2 |

Ubuntu操作系统请参见安装Python3.9.2(Ubuntu)。 |

numpy |

1.20.0+ |

pip3 install numpy==1.20.0 --user |

protobuf |

3.13.0+ |

pip3 install protobuf==3.13.0 --user |

上传软件包¶

以AMCT的安装用户将CANN-amct-{software version}-linux.{arch}.tar.gz软件包上传到Linux服务器任意目录下,本示例为上传到$HOME/amct/目录。

执行如下命令解压AMCT软件包:

tar -zxvf CANN-amct-{software version}-linux.{arch}.tar.gz

获得如下内容:

表 1 AMCT软件包解压后内容

一级目录 |

二级目录 |

说明 |

使用场景及注意事项 |

|---|---|---|---|

amct_caffe/ |

Caffe框架AMCT目录。 |

|

|

amct_caffe-{version}-py3-none-linux_{arch}.whl |

Caffe框架AMCT安装包。 |

||

caffe_patch.tar.gz |

Caffe源代码增强包。 |

||

amct_tf/ |

TensorFlow框架AMCT目录。 |

||

amct_tensorflow-{version}-py3-none-linux_{arch}.tar.gz |

TensorFlow框架AMCT安装包,通过源码编译方式进行安装。 |

|

|

amct_tensorflow_ascend-{version}-py3-none-linux_{arch}.tar.gz |

基于TF_Adapter的AMCT安装包,通过源码编译方式进行安装。 |

|

|

amct_pytorch/ |

PyTorch框架AMCT目录。 |

|

|

amct_pytorch-{version}-py3-none-linux_{arch}.tar.gz |

PyTorch框架AMCT源码安装包。 |

||

amct_onnx/ |

ONNX模型AMCT目录。 |

|

|

amct_onnx-{version}-py3-none-linux_{arch}.whl |

ONNX模型AMCT安装包。 |

||

amct_onnx_op.tar.gz |

AMCT基于ONNX Runtime的自定义算子包。 |

||

conf/ |

- |

- |

记录包的安装信息,用户无需关注。 |

latest_manager/ |

- |

- |

安装升级使用的公共脚本,用户无需关注。 |

third_party/ |

Ascend-nca-{software version}-linux.{arch}.run |

NCA(Neural Compute Agent)软件包。 |

基于性能的自动量化场景下使用。该版本不支持third_party目录下的相关特性。 |

其中:_{version}表示AMCT具体版本号,{software version}为软件版本号,{arch}_表示具体操作系统架构。

安装工具¶

本节介绍AMCT工具具体的安装命令。

AMCT(PyTorch)

在AMCT软件包所在目录下,执行如下命令进行源码安装(如果安装用户为root,请将安装命令中的--user删除):

pip3 install amct_pytorch-{version}-py3-none-linux_{arch}.tar.gz --user其中:_{version}表示AMCT具体版本号,{arch}_表示软件包支持的安装服务器具体架构形态。如果使用root用户安装AMCT,并且使用了--target参数,请确保--target参数指定的路径为当前用户的路径,避免指定到其他非root用户。

若出现如下信息则说明工具安装成功。

Successfully build amct-pytorch ... Successfully installed amct-pytorch-{version}

用户可以在Python软件包所在路径下(例如:$HOME/.local/lib/python3.9/site-packages)查看已经安装的AMCT,例如:

drwxr-xr-x 5 amct amct 4096 Mar 17 11:50 amct_pytorch/ drwxr-xr-x 2 amct amct 4096 Mar 17 11:50 amct_pytorch-{version}.dist-info/

其中amct_pytorch即为AMCT所在安装目录。

说明:

amct_pytorch和amct_tensorflow不能在Python同一个进程中导入,两个包共用同一个basic_info.proto,同时导入会引发proto重复定义问题。

amct_tensorflow为TensorFlow框架AMCT的安装目录;basic_info.proto文件所在路径为:AMCT安装目录/proto。

说明:

amct_pytorch和amct_tensorflow不能在Python同一个进程中导入,两个包共用同一个basic_info.proto,同时导入会引发proto重复定义问题。

amct_tensorflow为TensorFlow框架AMCT的安装目录;basic_info.proto文件所在路径为:AMCT安装目录/proto。

AMCT(ONNX)

安装AMCT**。**

在AMCT软件包所在目录下,执行如下命令进行安装(如果安装用户为root,请将安装命令中的--user删除):

pip3 install amct_onnx-{version}-py3-none-linux_{arch}.whl --user其中:_{version}表示AMCT具体版本号,{arch}_表示软件包支持的安装服务器具体架构形态。如果使用root用户安装AMCT,并且使用了--target参数,请确保--target参数指定的路径为当前用户的路径,避免指定到其他非root用户。

若出现如下信息则说明工具安装成功。

Successfully installed amct-onnx-{version}用户可以在Python软件包所在路径下(例如:$HOME/.local/lib/python3.9/site-packages)查看已经安装的AMCT,例如:

drwxr-xr-x 5 amct amct 4096 Mar 17 11:50 amct_onnx/ drwxr-xr-x 2 amct amct 4096 Mar 17 11:50 amct_onnx-{version}.dist-info/

其中amct_onnx即为AMCT所在安装目录。

AMCT(TensorFlow)

IPV350不支持

在AMCT软件包所在目录,执行如下命令进行安装(如果安装用户为root,请将安装命令中的--user删除):

该格式软件包以源码方式安装,安装过程中执行编译并安装的操作:

pip3 install amct_tensorflow-{version}-py3-none-linux_{arch}.tar.gz --user其中:_{version}表示AMCT具体版本号,{arch}_表示软件包支持的安装服务器具体架构形态。如果使用root用户安装AMCT,并且使用了--target参数,请确保--target参数指定的路径为当前用户的路径,避免指定到其他非root用户。

如果用户的安装服务器缺少某些编译依赖,无法采用源码包的方式安装AMCT,则可以参见源码包编译为whl包,以whl包形式安装AMCT将源码包编译为whl包进行安装。

若出现如下信息则说明工具安装成功。

Successfully installed amct-tensorflow-{version}用户可以在Python软件包所在路径下(例如:$HOME/.local/lib/python3.9/site-packages)查看已经安装的AMCT,例如:

drwxr-xr-x 5 amct amct 4096 Mar 17 11:50 amct_tensorflow/ drwxr-xr-x 2 amct amct 4096 Mar 17 11:50 amct_tensorflow-{version}.dist-info/

其中amct_tensorflow即为AMCT所在安装目录。

说明:

amct_tensorflow和amct_pytorch不能在Python同一个进程中导入,两个包共用同一个basic_info.proto,同时导入会引发proto重复定义问题。

amct_pytorch为PyTorch框架AMCT的安装目录;basic_info.proto文件所在路径为:AMCT安装目录/proto。

说明:

amct_tensorflow和amct_pytorch不能在Python同一个进程中导入,两个包共用同一个basic_info.proto,同时导入会引发proto重复定义问题。

amct_pytorch为PyTorch框架AMCT的安装目录;basic_info.proto文件所在路径为:AMCT安装目录/proto。

AMCT(Caffe)

IPV350不支持

在AMCT软件包所在目录,执行如下命令进行安装(如果安装用户为root,请将安装命令中的--user删除):

pip3 install amct_caffe-{version}-py3-none-linux_{arch}.whl --user其中:_{version}表示AMCT具体版本号,{arch}_表示软件包支持的安装服务器具体架构形态。如果使用root用户安装AMCT,并且使用了--target参数,请确保--target参数指定的路径为当前用户的路径,避免指定到其他非root用户。

若出现如下信息则说明工具安装成功。

Successfully installed amct-caffe-{version}用户可以在Python3.9.2安装包所在路径下(例如:$HOME/.local/lib/python3.9/site-packages,该路径请以用户实际安装的为准)查看已经安装的AMCT,例如:

drwxr-xr-x 5 amct amct 4096 Mar 17 11:50 amct_caffe/ drwxr-xr-x 2 amct amct 4096 Mar 17 11:50 amct_caffe-{version}.dist-info/

其中amct_caffe即为AMCT所在安装目录。

安装后处理¶

AMCT量化过程中的日志信息以及日志级别,可以通过环境变量设置,本章节给出详细设置方法。

AMCT(PyTorch)¶

AMCT量化过程中的日志信息以及日志级别,可以通过环境变量设置,本章节给出详细设置方法。

日志包括打印在屏幕上的日志以及保存到amct_log/amct_pytorch.log文件中的日志,该部分环境变量为可选配置,如果不设置,则按照默认日志级别,默认级别为INFO。

说明: amct_pytorch.log文件中的日志重新执行量化时会被覆盖,请用户自行进行保存。此外,由于生成的日志文件大小和所要量化模型层数有关,请用户确保AMCT工具所在服务器有足够空间: 以量化resnet101模型为例,日志级别设置为INFO,日志文件大小为5KB左右,中间临时文件大小为170MB左右;日志级别设置为DEBUG,日志文件大小为2MB左右,中间临时文件大小为170MB左右。

变量取值

日志打印级别通过如下两个变量设置:

AMCT_LOG_FILE_LEVEL:控制amct_pytorch.log日志文件的信息级别以及生成精度仿真模型时,对应量化层生成的日志文件信息级别。

AMCT_LOG_LEVEL:控制屏幕输出的信息级别。

有效取值以及含义如表1所示。

表 1 变量取值范围

信息级别

含义

信息描述

DEBUG

输出DEBUG/INFO/WARNING/ERROR级别的运行信息。

详细的流程信息,包括量化层及对应的处理阶段(融合,参数量化或者数据量化等)。

INFO

输出INFO/WARNING/ERROR级别的运行信息。默认为INFO。

概要的量化处理信息,包含量化的阶段等信息。

WARNING

输出WARNING/ERROR级别的运行信息。

量化处理过程中的警告信息。

ERROR

输出ERROR级别的运行信息。

量化处理过程中的错误信息。

信息级别不区分大小写,即Info、info、INFO均为有效取值。

使用示例

如下命令只是样例,用户根据实际情况进行设置。

将量化日志amct_pytorch.log信息级别设置为INFO级别。

export AMCT_LOG_FILE_LEVEL=INFO将屏幕打印输出信息级别设置为INFO级别。

export AMCT_LOG_LEVEL=INFO

AMCT(ONNX)¶

由于AMCT存在基于ONNX Runtime的自定义算子包,而自定义算子包编译时依赖ONNX Runtime提供的头文件,该头文件需要用户自行下载后,然后编译并安装自定义算子包。 AMCT量化过程中的日志信息以及日志级别,可以通过环境变量设置,本章节给出详细设置方法。

编译并安装自定义算子包¶

由于AMCT存在基于ONNX Runtime的自定义算子包,而自定义算子包编译时依赖ONNX Runtime提供的头文件,该头文件需要用户自行下载后,然后编译并安装自定义算子包。

方法如下,该步骤为必选操作,否则可能会导致AMCT无法使用:

解压自定义算子包。

tar -zvxf amct_onnx_op.tar.gz解压后文件目录组织如下:

amct_onnx_op # 自定义算子根目录 ├── inc # 自定义算子编译头文件目录 ├── src # 自定义算子实现源文件,请参见ONNX Runtime官方API说明 └── setup.py # 编译脚本,编译自定义算子,并且拷贝生成动态库至AMCT软件包内

说明:

编译基于ONNX Runtime的自定义算子需要依赖ONNX Runtime提供的头文件,该文件需要在线从GitHub上下载。如果用户AMCT所在服务器能链接网络,并且能连通GitHub,则可以直接进行2;如果无法连接网络,则请自行下载如下文件,下载链接请单击Link,然后上传到AMCT所在服务器amct_onnx_op/inc目录:

说明:

编译基于ONNX Runtime的自定义算子需要依赖ONNX Runtime提供的头文件,该文件需要在线从GitHub上下载。如果用户AMCT所在服务器能链接网络,并且能连通GitHub,则可以直接进行2;如果无法连接网络,则请自行下载如下文件,下载链接请单击Link,然后上传到AMCT所在服务器amct_onnx_op/inc目录:onnxruntime_cxx_api.h

onnxruntime_cxx_inline.h

onnxruntime_c_api.h

onnxruntime_session_options_config_keys.h

onnxruntime_float16.h 下载的头文件版本必须和ONNX Runtime版本一致,如果import amct_onnx时出现“segmentation fault”,建议删除头文件,卸载amct_onnx后下载正确版本的头文件后重新安装。

进入amct_onnx_op目录,编译并安装自定义算子包。

cd amct_onnx_op && python3 setup.py build出现以下信息表示编译并安装自定义算子包成功,若编译失败,请参见编译并安装自定义算子包时提示"AttributeError: module ‘onnxruntime’ has no attribute ‘SessionOption’"信息进行处理。

[INFO] Build amct_onnx_op success! [INFO] Install amct_onnx_op success!

设置环境变量¶

AMCT量化过程中的日志信息以及日志级别,可以通过环境变量设置,本章节给出详细设置方法。

日志包括打印在屏幕上的日志以及保存到amct_log/amct_onnx.log文件中的日志。该部分环境变量为可选配置,如果不设置,则按照默认日志级别,默认级别为INFO。

变量取值

日志打印级别通过如下两个变量设置:

AMCT_LOG_FILE_LEVEL:控制amct_onnx.log日志文件的信息级别以及生成精度仿真模型时,对应量化层生成的日志文件信息级别。

AMCT_LOG_LEVEL:控制屏幕输出的信息级别。

有效取值以及含义如表1所示。

表 1 变量取值范围

信息级别

含义

信息描述

DEBUG

输出DEBUG/INFO/WARNING/ERROR级别的运行信息。

详细的流程信息,包括量化层及对应的处理阶段(融合,参数量化或者数据量化等)。

INFO

输出INFO/WARNING/ERROR级别的运行信息。默认为INFO。

概要的量化处理信息,包含量化的阶段等信息。

WARNING

输出WARNING/ERROR级别的运行信息。

量化处理过程中的警告信息。

ERROR

输出ERROR级别的运行信息。

量化处理过程中的错误信息。

信息级别不区分大小写,即Info、info、INFO均为有效取值。

使用示例

如下命令只是样例,用户根据实际情况进行设置。

将量化日志amct_onnx.log信息级别设置为INFO级别。

export AMCT_LOG_FILE_LEVEL=INFO将屏幕打印输出信息级别设置为INFO级别。

export AMCT_LOG_LEVEL=INFO

AMCT(Caffe)¶

IPV350不支持

安装完AMCT后,量化模型前,用户需要获取并安装Caffe源代码增强包caffe_patch.tar.gz。 设置日志打印级别,其中日志包括打印在屏幕上的日志以及保存到amct_log/amct_caffe.log文件中的日志。该部分环境变量为可选配置,如果不设置,则按照默认日志级别,默认级别为INFO。

Caffe patch安装¶

安装完AMCT后,量化模型前,用户需要获取并安装Caffe源代码增强包caffe_patch.tar.gz。

该增强包用于完成如下内容:

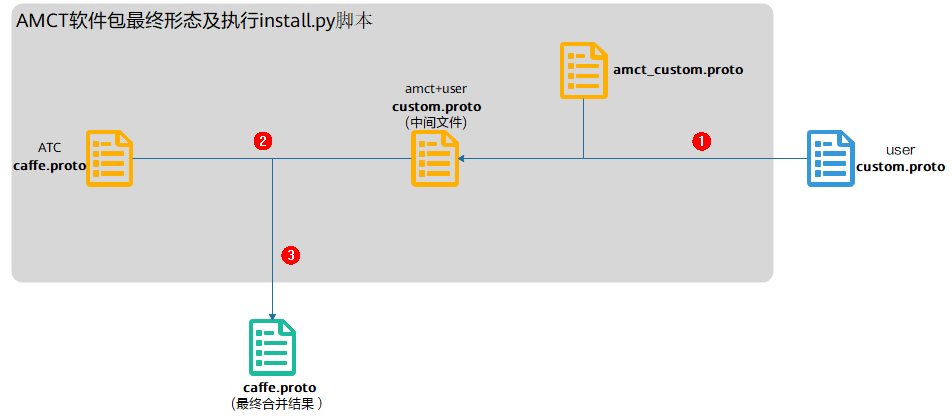

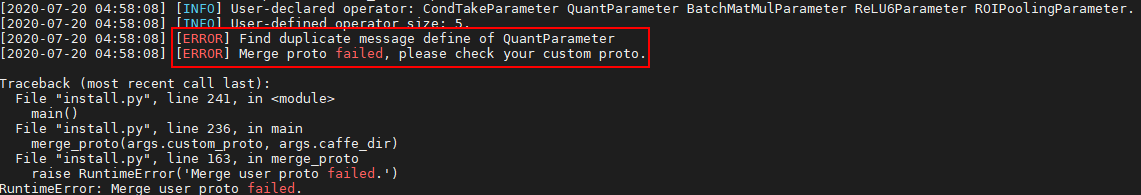

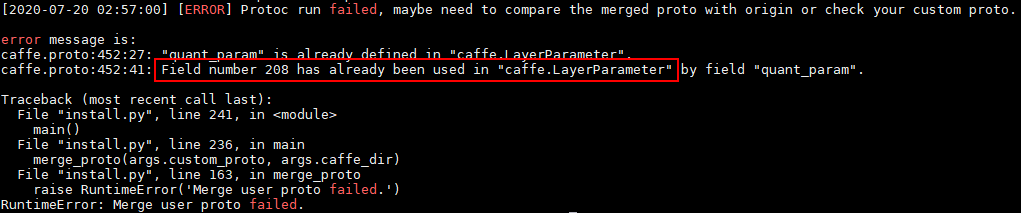

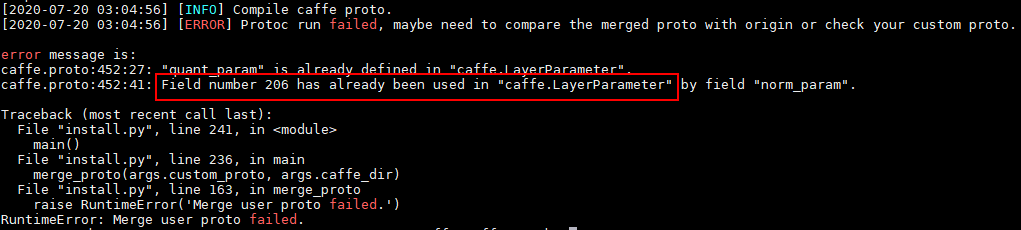

如果AMCT所在服务器有用户自定义的custom.proto文件,则需要和AMCT软件包中提供的proto文件进行合并。该软件包提供了基于Caffe1.0版本的caffe.proto文件、AMCT自定义层以及caffe-master相较于caffe1.0更新层的amct_custom.proto文件。proto合并原理请参见proto合并原理。

拷贝新增源码和动态库文件到Caffe环境_caffe-master_工程目录下。

对Caffe环境_caffe-master_工程目录下部分文件安装patch,以实现对文件的自动修改。

proto合并前提条件

用户自行准备自定义的custom.proto,并上传到AMCT所在服务器任意目录。

样例如下,以下样例中的自定义层及参数仅作为参考,请用户根据实际场景对参数进行自定义。

message LayerParameter {

optional ReLU6Parameter relu6_param = 2060;

optional ROIPoolingParameter roi_pooling_param = 8266711;

}

message ReLU6Parameter {

optional float negative_slope = 1 [default = 0];

}

message ROIPoolingParameter {

// Pad, kernel size, and stride are all given as a single value for equal

// dimensions in height and width or as Y, X pairs.

optional uint32 pooled_h = 1 [default = 0]; // The pooled output height

optional uint32 pooled_w = 2 [default = 0]; // The pooled output width

// Multiplicative spatial scale factor to translate ROI coords from their

// input scale to the scale used when pooling

optional float spatial_scale = 3 [default = 1];

}

custom.proto主要分为两部分:

LayerParameter注册自定义层:

message LayerParameter { # user definition fields, each field takes one line. optional FieldType0 field_name0 = field_num0; optional FieldType1 field_name1 = field_num1; }

该字段用于在LayerParameter中声明用户自定义层,用户自定义层需要加入到LayerParameter中,从而可以在Caffe框架中写入Layer并从Layer中读取到;该声明分为四个部分:

optional:表示该定义在LayerParameter中是可选的,只能配置为optional。

FieldType:声明当前字段对应的自定义类型,需要有相应的message定义。

field_name:当前声明的id,需要唯一,如果提示冲突,需要用户修改自己的id名称,后续需要通过该id来访问相应的内容。

field_num:当前声明的编号,需要唯一,如果提示冲突,需要用户修改自己的编号值,建议区间段小于5000,并且不与ATC提供的caffe.proto中的编号冲突,在二进制caffemodel中需要通过该编号去解析对应字段。

示例如下:

message LayerParameter { optional ReLU6Parameter relu6_param = 2060; optional ROIPoolingParameter roi_pooling_param = 8266711; }

说明:

说明:custom.proto中用户自定义层编号建议区间段小于5000,并且不与ATC提供的caffe.proto中的内置编号冲突。

amct_custom.proto中的编号从200000开始(包括200000)。

caffe.proto中ATC自定义层的编号区间段为:[5000,200000)。

message定义自定义层参数:

message ReLU6Parameter { optional float negative_slope = 1 [default = 0]; }

用户自定义层参数定义,用于定义用户自定义层详细的参数内容,详细内容可以参考google protobuf。

该字段需要保证和AMCT自定义层amct_custom.proto不冲突,如果冲突,proto合并时会提示错误信息,用户根据提示信息进行修改;与ATC内置caffe.proto冲突则会优先使用用户的message定义覆盖。

当前AMCT自定义message包括:QuantParameter、DeQuantParameter、IFMRParameter、LSTMQuantParameter、SearchNParameter、 RetrainDataQuantParameter、RetrainWeightQuantParameter、SingleLayerRecord、 ScaleOffsetRecord,用户自定义层时不能同上述message名重复。

安装步骤

用户可以执行caffe_patch中的自动安装脚本install.py,如果脚本执行成功,则会自动将caffe_patch中的patch内容安装到Caffe环境_caffe-master_工程目录下,并完成proto合并、新增源码和动态库文件替换的功能。安装或手动修改完成后,需要重新编译Caffe环境。具体操作方法如下:

解压Caffe源代码增强包。

以AMCT的安装用户在软件包所在路径执行如下命令,解压caffe_patch.tar.gz软件包:

tar -zxvf caffe_patch.tar.gz获得如下内容:

caffe_patch ├── include //用于存放自定义层定义头文件以及公共函数 │ └── caffe │ ├── layers │ └── util ├── install.py //Caffe环境proto合并、patch安装以及源码和动态库文件执行脚本 ├── merge_proto //proto合并目录 │ ├── amct_custom.proto //AMCT自定义层以及caffe-master相较于Caffe1.0的更新层 │ ├── caffe.proto //ATC工具中内置的caffe.proto │ └── merge_proto.sh //proto合并脚本,实际合并时install.py会调用该脚本 ├── patch //LSTM层相关的patch文件 │ ├── lstm_calibration_layer.cpp.patch //用于在caffe-master/src/caffe/layers目录生成lstm_calibration_layer.cpp │ ├── lstm_calibration_layer.hpp.patch //用于在caffe-master/include/caffe/layers目录生成lstm_calibration_layer.hpp │ ├── lstm_quant_layer.cpp.patch //用于在caffe-master/src/caffe/layers/目录生成lstm_quant_layer.cpp │ └── lstm_quant_layer.hpp.patch //用于在caffe-master/include/caffe/layers/目录生成lstm_quant_layer.hpp ├── quant_lib //用于存放量化算法核心动态库 │ ├── libquant_gpu.so │ └── libquant.so └── src //用于存放自定义层实现源码文件以及公共函数 └── caffe ├── layers └── util

切换到caffe_patch/install.py脚本所在目录,执行如下命令。

python3 install.py --caffe_dir CAFFE_DIR [--custom_proto CUSTOM_PROTO_FILE]参数解释如下:

表 1 量化脚本所用参数说明

参数

说明

--h

可选。显示帮助信息。

--caffe_dir

必填。Caffe源代码路径,支持相对路径和绝对路径。

--custom_proto

可选。用户自定义custom.proto文件路径,支持相对路径和绝对路径。

使用样例如下:

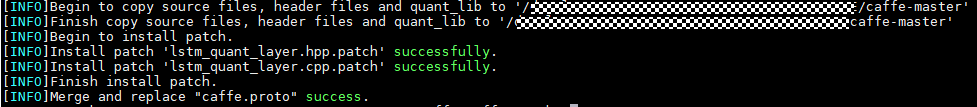

python3 install.py --caffe_dir caffe-master --custom_proto custom.proto若提示如下信息,则说明执行成功。

# 拷贝新增源码和动态库文件到Caffe环境caffe-master工程目录下 [INFO]Begin to copy source files, header files and quant_lib to '$HOME/AMCT/AMCT_CAFFE/caffe-master' [INFO]Finish copy source files, header files and quant_lib to '$HOME/AMCT/AMCT_CAFFE/caffe-master' # 安装patch [INFO]Begin to install patch. [INFO]Install patch 'lstm_calibration_layer.cpp.patch' successfully. [INFO]Install patch 'lstm_quant_layer.hpp.patch' successfully. [INFO]Install patch 'lstm_quant_layer.cpp.patch' successfully. [INFO]Install patch 'lstm_quant_layer.hpp.patch' successfully. [INFO]Finish install patch. # proto合并 [INFO]Merge and replace "caffe.proto" success. # 修改Makefile [INFO]Merge and replace "Makefile" success.

执行脚本过程中(使用install.py脚本时,支持重复安装patch):

如果安装patch失败,则请用户自行将Caffe工程中caffe-master/src/caffe/layers/lstm_layer.cpp和caffe-master/include/caffe/layers/lstm_layer.hpp文件还原为caffe-master原生的。

proto合并阶段如果提示ERROR信息,则请参见执行proto合并时提示ERROR信息解决。

如果修改Makefile失败,则请根据提示信息进行修改;如果执行成功,则再次执行该脚本时,不会重复修改Makefile。

检查Python layer配置,如果没有配置,增加Python layer的实现。

修改Caffe工程中caffe-master/Makefile.config文件。

增加Python layer的实现。

# Uncomment to support layers written in Python (will link against Python libs) WITH_PYTHON_LAYER := 1

(可选)新增C++11标准代码的支持。

由于AMCT新增算子需要C++11支持,需要确保caffe-master/Makefile中增加了--std=c++11编译选项。2中执行install.py脚本时会自动修改该文件,请用户检查caffe-master/Makefile如下代码片段加粗部分是否增加--std=c++11编译选项,若已增加则该步骤请忽略,否则请手动修改。

# Complete build flags. COMMON_FLAGS += $(foreach includedir,$(INCLUDE_DIRS),-I$(includedir)) --std=c++11 CXXFLAGS += -pthread -fPIC $(COMMON_FLAGS) $(WARNINGS) NVCCFLAGS += -ccbin=$(CXX) -Xcompiler -fPIC $(COMMON_FLAGS)

返回caffe-master目录,执行如下命令重新编译Caffe以及pycaffe环境:

#如果用户环境安装patch之前已经编译过Caffe工程,安装patch之后,需要先执行make clean,然后再执行编译命令 make clean make all -j && make pycaffe -j

caffe.proto修改后需要重新编译为caffe_pb2.py:由于AMCT需要解析用户的Caffe模型,用户使用Caffe模型时可能会新增自定义层,此时需要修改caffe.proto文件,修改后,需要用户自行提供从修改后的caffe.proto文件编译出的caffe_pb2.py,给AMCT使用。

说明:

如果用户使用protoc方式来重新编译caffe.proto,例如protoc --python_out=./caffe.proto,此时,需要同步修改PYTHONPATH中caffe.proto所在路径。如下所示,${path}请替换为caffe.proto实际路径。

说明:

如果用户使用protoc方式来重新编译caffe.proto,例如protoc --python_out=./caffe.proto,此时,需要同步修改PYTHONPATH中caffe.proto所在路径。如下所示,${path}请替换为caffe.proto实际路径。export PYTHONPATH=$PYTHONPATH:${path}

环境变量设置¶

设置日志打印级别,其中日志包括打印在屏幕上的日志以及保存到amct_log/amct_caffe.log文件中的日志。该部分环境变量为可选配置,如果不设置,则按照默认日志级别,默认级别为INFO。

变量取值

日志打印级别通过如下两个变量设置:

AMCT_LOG_FILE_LEVEL:控制amct_caffe.log日志文件的信息级别以及生成精度仿真模型时,对应量化层生成的日志文件信息级别。

AMCT_LOG_LEVEL:控制屏幕输出的信息级别。

有效取值以及含义如表1所示。

表 1 变量取值范围

信息级别

含义

信息描述

DEBUG

输出DEBUG/INFO/WARNING/ERROR级别的运行信息。

详细的流程信息,包括量化层及对应的处理阶段(融合,参数量化或者数据量化等)。

INFO

输出INFO/WARNING/ERROR级别的运行信息。默认为INFO。

概要的量化处理信息,包含量化的阶段等信息。

WARNING

输出WARNING/ERROR级别的运行信息。

量化处理过程中的警告信息。

ERROR

输出ERROR级别的运行信息。

量化处理过程中的错误信息。

信息级别不区分大小写,即Info、info、INFO均为有效取值。

使用示例

如下命令只是样例,用户根据实际情况进行设置。

将量化日志amct_caffe.log信息级别设置为INFO级别。

export AMCT_LOG_FILE_LEVEL=INFO将屏幕打印输出信息级别设置为INFO级别。

export AMCT_LOG_LEVEL=INFO

常用操作¶

建议使用最新版本的AMCT,以便获得最新功能。 若用户不再使用AMCT时,可以参见该章节将其卸载。

工具更新¶

建议使用最新版本的AMCT,以便获得最新功能。

使用新版本之前请先参见工具卸载章节卸载之前版本的AMCT,然后参见安装工具章节安装最新版本。针对AMCT(Caffe),安装新版本的AMCT后,Caffe环境需要重新编译,详细方法请参见5。

工具卸载¶

若用户不再使用AMCT时,可以参见该章节将其卸载。

以AMCT的安装用户在Linux服务器任意目录执行如下命令进行卸载:

pip3 uninstall amct_xxx出现如下信息时,输入“y“:

Uninstalling amct-xxx-{version}: Would remove: ... ... Proceed (y/n)? y

若出现如下信息则说明卸载成功:

Successfully uninstalled amct-xxx-{version}卸载过程中不会卸载已经安装的框架,比如PyTorch,TensorFlow等,上述_xxx_请替换为具体的框架名称,比如pytorch,tensorflow等。

快速入门¶

本章节以压缩特性中的量化功能为例,并借助sample中的网络模型,为您介绍如何使用命令行方式压缩一个模型。

AMCT支持命令行方式和Python API接口方式量化原始网络模型,命令行方式压缩方式,目前仅支持ONNX框架:

其他未支持的框架和特性,只能使用Python API方式进行量化。命令行方式相比Python API接口方式有以下优点:

表 1 量化方式比较

命令行方式 |

Python API接口方式 |

|---|---|

量化准备动作简单,只需准备模型和模型匹配的数据集即可。 |

需要了解Python语法和量化流程。 |

量化过程简单,只涉及参数选择,无需对量化脚本进行适配。 |

需要适配修改量化脚本。 |

|

|

压缩ONNX网络模型

前提条件

已安装AMCT(ONNX)工具包,详情请参见准备环境。

获取sample包

单击Link获取sample软件包,并上传到AMCT所在服务器任意路径,例如上传到:_$HOME/software/AMCT_Pkg/_amct_sample。

解压sample软件包。

切换到_amct_sample_目录,执行如下命令解压sample包。

unzip samples-master.zip cd samples-master/python/level1_single_api/9_amct/amct_onnx/cmd

获得如下目录信息:

|-- README_CN.md |-- data # 数据集存放路径 |-- model # ONNX 模型文件所在目录 |-- scripts | |-- run_calibration.sh # 执行量化封装脚本 | |-- run_convert_qat.sh # QAT模型适配CANN模型命令行脚本 | |-- run_customized_calibration.sh # 用户自定义的训练后量化脚本 |-- src |-- process_data.py # 数据集预处理脚本,生成模型的输入数据;如果更换为其他数据集,需保证处理后数据shape与模型输入shape一致 |-- evaluator.py # 系统内置的,基于“Evaluator”基类并且包含evaluator评估器的Python脚本

量化模型

获取ONNX网络模型。

单击Link,获取resnet101_v11.onnx网络的模型文件(*.onnx),并以AMCT软件包运行用户将获取的文件上传至Linux服务器sample目录amct_onnx/cmd/model。

准备模型相匹配的二进制数据集。

切换到amct_onnx/cmd/data,依次执行如下命令,用于下载校准数据集。

wget https://obs-9be7.obs.cn-east-2.myhuaweicloud.com/models/amct_acl/classification/imagenet_calibration.tar.gz tar -zxvf imagenet_calibration.tar.gz

执行完成后,在images目录会生成*.jpg格式数据集。

在amct_onnx/cmd目录,执行如下命令将images目录下*.jpg格式数据集转换为bin格式数据集。

python3 ./src/process_data.py执行完成后,在data目录生成calibration目录,并在该目录中生成calibration.bin格式数据集。

在任意目录执行如下命令进行网络模型的量化操作。如下命令中使用的目录以及文件均为样例,请以实际为准。

amct_onnx calibration --model ./model/resnet101_v11.onnx --save_path ./results/resnet101_v11 --input_shape "input:16,3,224,224" --data_dir "./data/calibration" --data_types "float32"amct_onnx二进制所在路径为安装用户$HOME/.local/bin目录。用户可以通过amct_onnx calibration --help命令查看命令行涉及的所有参数,关于参数的详细解释以及使用方法请参见命令行参数说明。

说明:

说明:如果执行amct_onnx calibration --help命令后,查询不到AMCT工具,则可能是安装该工具时,使用的Python版本不对,参见安装Python3.9.2(Ubuntu)重新执行如下环境变量后再次尝试(路径请替换为实际安装的地址):

export PATH=/usr/local/python3.9.2/bin:$PATHAMCT的sample还提供了3量化命令以及2.b中数据集预处理脚本的封装脚本run_calibration.sh,用户准备完模型以及下载好数据集后,可以直接使用该脚本执行量化,切换到amct_onnx/cmd目录,执行如下命令:

bash ./scripts/run_calibration.sh若提示如下信息且无Error日志信息,则说明模型量化成功。

INFO - [AMCT]:[Utils]: The model file is saved in $HOME/xxx/results/resnet101_v11_fake_quant_model.onnx量化后生成文件说明如下:

amct_log/amct_onnx.log:记录了工具的日志信息,包括量化过程的日志信息。

上述日志文件重新执行量化时会被覆盖,请用户自行进行保存。此外,由于生成的日志文件大小和所要量化模型层数有关,请用户确保AMCT工具所在服务器有足够空间:

以量化resnet101模型为例,日志级别设置为INFO,日志文件大小为5KB左右,中间临时文件大小为170MB左右;日志级别设置为DEBUG,日志文件大小为2MB左右,中间临时文件大小为170MB左右。

results:量化结果文件。

resnet101_v11_deploy_model.onnx:量化后的可在NPU IP加速器部署的模型文件。

resnet101_v11_fake_quant_model.onnx:量化后的可在ONNX执行框架ONNX Runtime进行精度仿真的模型文件。

resnet101_v11_quant.json:量化信息文件(该文件名称和量化后模型名称保持统一),记录了量化模型同原始模型节点的映射关系,用于量化后模型同原始模型精度比对使用。

(可选)_随机数_时间戳,_该目录只有AMCT_LOG_LEVEL=DEBUG时才会生成,设置方法请参见设置环境变量。

quant_config.json:量化配置文件,描述了如何对模型中的每一层进行量化。如果当前目录已经存在量化配置文件,则再次进行量化时,如果新生成的量化配置文件与已有的文件同名,则会覆盖已有的量化配置文件,否则生成新的量化配置文件。

实际量化过程中,如果量化后的模型推理精度不满足要求,则用户可以根据量化后的quant_config.json,自行构造简易配置文件_config.cfg_,构造原则请参见调优流程。然后使用--calibration_config参数重新进行量化。通过该文件用户可以自行决定校准使用的数据量,以及控制哪些层进行量化等。

record.txt:记录量化因子的文件。关于该文件的原型定义请参见record记录文件。

modified_model.onnx、updated_model.onnx:量化过程中的中间文件。

压缩开源框架的TensorFlow网络模型

前提条件

已安装AMCT(TensorFlow)工具包,详情请参见准备环境。

IPV350不支持TensorFlow框架。

获取sample包

单击Link获取sample软件包,并上传到AMCT所在服务器任意路径,例如上传到:_$HOME/software/AMCT_Pkg/_amct_sample。

解压sample软件包。

切换到_amct_sample_目录,执行如下命令解压sample包。

unzip samples-master.zip cd samples-master/python/level1_single_api/9_amct/amct_tensorflow/cmd

获得如下目录信息:

|-- README_CN.md |-- data # 数据集存放路径 |-- model # TensorFlow模型文件所在目录 |-- scripts | |-- run_calibration.sh # 执行量化封装脚本 | |-- run_convert_qat.sh # QAT模型适配CANN模型命令行脚本 | |-- run_customized_calibration.sh # 用户自定义的训练后量化脚本 |-- src |-- evaluator.py # 系统内置的,基于“Evaluator”基类并且包含evaluator评估器的Python脚本 |-- process_data.py # 数据集预处理脚本,生成模型的输入数据;如果更换为其他数据集,需保证处理后数据shape与模型输入shape一致

量化模型

获取待量化的TensorFlow网络模型。

单击Link获取MobileNet V2网络模型,解压后将其中的(*.pb)文件,以AMCT软件包运行用户上传至Linux服务器sample目录amct_tensorflow/cmd/model。

准备模型相匹配的二进制数据集。

切换到amct_tensorflow/cmd/data,依次执行如下命令,用于下载校准数据集。

cd amct_tensorflow/cmd/data mkdir image && cd image wget https://obs-9be7.obs.cn-east-2.myhuaweicloud.com/models/amct_acl/classification/calibration.rar unrar e calibration.rar

上述命令执行完成后,在image/calibration目录会生成*.jpg格式数据集。

在amct_tensorflow/cmd目录,执行如下命令将calibration目录下*.jpg格式数据集转换为bin格式数据集。

python3 ./src/process_data.py执行完成后,在data目录会生成新的calibration目录,并在该目录生成calibration.bin格式数据集。

在任意目录执行如下命令进行网络模型的量化操作。如下命令中使用的目录以及文件均为样例,请以实际为准。

amct_tensorflow calibration --model=./model/mobilenet_v2_1.0_224_frozen.pb --save_path=./results/mobilenet_v2 --outputs="MobilenetV2/Predictions/Reshape_1:0" --input_shape="input:32,224,224,3" --data_dir="./data/calibration/" --data_types="float32"amct_tensorflow二进制所在路径为安装用户$HOME/.local/bin目录。用户可以通过amct_tensorflow calibration --help命令查看命令行涉及的所有参数,关于参数的详细解释以及使用方法请参见命令行参数说明。

说明:

说明:如果执行amct_tensorflow calibration --help命令后,查询不到AMCT工具,则可能是安装该工具时,使用的Python版本不对,参见安装Python3.9.2(Ubuntu)重新执行如下环境变量后再次尝试(路径请替换为实际安装的地址)。

export PATH=/usr/local/python3.9.2/bin:$PATHAMCT的sample还提供了3量化命令以及2.b中数据集预处理脚本的封装脚本run_calibration.sh,用户准备完模型以及下载好数据集后,可以直接使用该脚本执行量化,切换到amct_tensorflow/cmd目录,执行如下命令:

bash ./scripts/run_calibration.sh若提示如下信息且无Error日志信息,则说明模型量化成功。

INFO - [AMCT]:[save_model]: The model is saved in $HOME/xxx/results/mobilenet_v2_quantized.pb量化后生成文件说明如下:

amct_log/amct_tensorflow.log:记录了工具的日志信息,包括量化过程的日志信息。

上述日志文件重新执行量化时会被覆盖,请用户自行进行保存。此外,由于生成的日志文件大小和所要量化模型层数有关,请用户确保AMCT工具所在服务器有足够空间:

以量化resnet101模型为例,日志级别设置为INFO,日志文件大小为5KB左右,中间临时文件大小为170MB左右;日志级别设置为DEBUG,日志文件大小为2MB左右,中间临时文件大小为170MB左右。

results:量化结果文件。

mobilenet_v2_quantized.pb:量化后的可在TensorFlow环境进行精度仿真并可在NPU IP加速器部署的模型。

mobilenet_v2_quant.json:量化信息文件(该文件名称和量化后模型名称保持统一),记录了量化模型同原始模型节点的映射关系,用于量化后模型同原始模型精度比对使用。

(可选)随机数_时间戳:该目录只有set_logging_level接口打屏日志级别设置为debug才会生成。

quant_config.json:量化配置文件,描述了如何对模型中的每一层进行量化。如果当前目录已经存在量化配置文件,则再次进行量化时,如果新生成的量化配置文件与已有的文件同名,则会覆盖已有的量化配置文件,否则生成新的量化配置文件。

实际量化过程中,如果量化后的模型推理精度不满足要求,则用户可以根据量化后的quant_config.json,自行构造简易配置文件_config.cfg_,构造原则请参见调优流程。然后使用--calibration_config参数重新进行量化。通过该文件用户可以自行决定校准使用的数据量,以及控制哪些层进行量化等。

record.txt:记录量化因子的文件。关于该文件的原型定义请参见record记录文件。

压缩开源框架的Caffe网络模型

前提条件

已安装AMCT(Caffe)工具包,详情请参见准备环境。

IPV350不支持Caffe框架。

获取sample包

单击Link获取sample软件包,并上传到AMCT所在服务器任意路径,例如上传到:_$HOME/software/AMCT_Pkg/_amct_sample。

解压sample软件包。

切换到_amct_sample_目录,执行如下命令解压sample包。

unzip samples-master.zip cd samples-master/python/level1_single_api/9_amct/amct_caffe/cmd

获得如下目录信息:

|-- README_CN.md |-- data # 数据集存放目录 |-- model # Caffe模型文件所在目录 |-- scripts | |-- run_calibration.sh # 执行量化封装脚本 | |-- run_customized_calibration.sh # 用户自定义的训练后量化脚本 |-- src |-- download_models.py # 模型文件下载脚本 |-- evaluator.py # 系统内置的,基于“Evaluator”基类并且包含evaluator评估器的Python脚本 |-- process_data.py # 数据集预处理脚本,生成模型的输入数据;如果更换为其他数据集,需保证处理后数据shape与模型输入shape一致

量化模型

获取待量化的Caffe网络模型。

切换到amct_caffe/cmd目录,执行如下命令下载模型文件和权重文件。

python3 ./src/download_models.py --close_certificate_verify其中,--close_certificate_verify参数可选,用于关闭证书验证参数,确保模型正常下载。如果模型下载过程中提示认证失败相关信息,则可以增加该参数重新下载。

若提示如下信息,则说明模型文件下载成功:

[INFO]Download 'ResNet-50-deploy.prototxt' to 'xxx/amct_caffe/cmd/model/ResNet-50-deploy.prototxt' success. [INFO]Download file_name to 'xxx/amct_caffe/cmd/model/ResNet-50-model.caffemodel' success.

用户可以根据提示信息,在amct_caffe/cmd/model路径看到已经下载的模型文件。

准备模型相匹配的二进制数据集。

切换到amct_caffe/cmd目录,执行如下命令,用于下载校准数据集。

cd data mkdir image && cd image wget https://obs-9be7.obs.cn-east-2.myhuaweicloud.com/models/amct_acl/classification/calibration.rar unrar e calibration.rar

在amct_caffe/cmd目录,执行如下命令将calibration目录下*.jpg格式数据集转换为bin格式数据集。

python3 ./src/process_data.py执行完成后,在data目录会生成新的calibration目录,并在该目录生成calibration.bin格式数据集。

在任意路径执行如下命令进行网络模型的量化操作。如下命令中使用的目录以及文件均为样例,请以实际为准。

amct_caffe calibration --model=./model/ResNet-50-deploy.prototxt --weights=./model/ResNet-50-model.caffemodel --save_path=./results/ResNet-50 --input_shape="data:1,3,224,224" --data_dir="./data/calibration" --data_types="float32"amct_caffe二进制所在路径为安装用户$HOME/.local/bin目录。用户可以通过amct_caffe calibration --help命令查看命令行涉及的所有参数,关于参数的详细解释以及使用方法请参见命令行参数说明。

说明:

说明:如果执行amct_caffe calibration --help命令后,查询不到AMCT工具,则可能是安装该工具时,使用的Python版本不对,参见安装Python3.9.2(Ubuntu)重新执行如下环境变量后再次尝试(路径请替换为实际安装的地址):

export PATH=/usr/local/python3.9.2/bin:$PATHAMCT的sample还提供了3量化命令以及2.b中数据集预处理脚本的封装脚本run_calibration.sh,用户准备完模型以及下载好数据集后,可以直接使用该脚本执行量化,切换到amct_caffe/cmd目录,执行如下命令:

bash ./scripts/run_calibration.sh若提示如下信息且无Error日志信息,则说明模型量化成功。

INFO - [AMCT]:[Utils]: The weights_file is saved in $HOME/xxx/results/ResNet-50_fake_quant_weights.caffemodel INFO - [AMCT]:[Utils]: The model_file is saved in $HOME/xxx/results/ResNet-50_fake_quant_model.prototxt

量化后生成文件说明如下:

amct_log/amct_caffe.log:记录了工具的日志信息,包括量化过程的日志信息。

上述日志文件重新执行量化时会被覆盖,请用户自行进行保存。此外,由于生成的日志文件大小和所要量化模型层数有关,请用户确保AMCT工具所在服务器有足够空间:

以量化resnet101模型为例,日志级别设置为INFO,日志文件大小为5KB左右,中间临时文件大小为170MB左右;日志级别设置为DEBUG,日志文件大小为2MB左右,中间临时文件大小为170MB左右。

results:量化结果文件。

ResNet-50_deploy_model.prototxt:量化后的可在NPU IP加速器部署的模型文件。

ResNet-50_deploy_weights.caffemodel:量化后的可在NPU IP加速器部署的权重文件。

ResNet-50_fake_quant_model.prototxt:量化后的可在Caffe环境进行精度仿真模型文件。

ResNet-50_fake_quant_weights.caffemodel:量化后的可在Caffe环境进行精度仿真权重文件。

ResNet-50_quant.json:量化信息文件(该文件名称和量化后模型名称保持统一),记录了量化模型同原始模型节点的映射关系,用于量化后模型同原始模型精度比对使用。

(可选)_随机数_时间戳,_该目录只有AMCT_LOG_LEVEL=DEBUG时才会生成,设置方法请参见环境变量设置。

quant_config.json:量化配置文件,描述了如何对模型中的每一层进行量化。如果当前目录已经存在量化配置文件,则再次进行量化时,如果新生成的量化配置文件与已有的文件同名,则会覆盖已有的量化配置文件,否则生成新的量化配置文件。

实际量化过程中,如果量化后的模型推理精度不满足要求,则用户可以根据量化后的quant_config.json,自行构造简易配置文件_config.cfg_,构造原则请参见调优流程。然后使用--calibration_config参数重新进行量化。通过该文件用户可以自行决定校准使用的数据量,以及控制哪些层进行量化等。

modified_model.prototxt、modified_model.caffemodel:量化过程中生成的中间模型文件。

record.txt:记录量化因子的文件。关于该文件的原型定义请参见record记录文件。

AMCT(PyTorch)¶

量化¶

本章节详细介绍AMCT量化场景,以及每个场景下的功能。

简介¶

本章节详细介绍AMCT量化场景,以及每个场景下的功能。

量化分类

量化根据是否需要重训练,分为训练后量化(Post-Training Quantization,简称PTQ)和量化感知训练(Quantization-Aware Training,简称QAT),概念解释请参见量化。

训练后量化

根据量化后是否手动调优量化配置文件,分为手工量化和基于精度的自动量化。训练后量化使用的量化算法请参见训练后量化算法。

根据是否对权重数据进行压缩又分为均匀量化和非均匀量化(不支持)。如果量化后的精度不满足要求,则可以进行基于精度的自动量化或手工调优,推荐使用基于精度的自动量化。

量化感知训练

量化感知训练当前仅支持对float32数据类型的网络模型进行量化。量化感知训练使用的量化算法请参见量化感知训练算法。

当前仅支持手工量化,如果量化后的精度不满足要求,可以进行手工调优。

相关概念

量化过程中使用的相关术语解释如下:

表 1 量化过程中的相关概念

术语 |

解释 |

|---|---|

数据量化和权重量化 |

训练后量化和量化感知训练,根据量化对象不同,又分为数据(activation)量化和权重(weight)量化。 当前NPU IP加速器支持数据(activation)做对称/非对称量化,权重(weight)仅支持做对称量化(量化根据量化后数据中心点是否为0可以分为对称量化、非对称量化,详细的量化算法原理请参见量化算法原理)。

|

量化位宽 |

量化根据量化后低比特位宽大小分为常见的INT8、INT4、INT16,Binary量化等,当前版本仅支持INT8和INT16量化。

|

测试数据集 |

数据集的子集,用于最终测试模型的效果。 |

校准 |

训练后量化场景中,做前向推理获取数据量化因子的过程。 |

校准数据集 |

训练后量化场景中,做前向推理使用的数据集。该数据集的分布代表着所有数据集的分布,获取校准集时应该具有代表性,推荐使用测试集的子集作为校准数据集。如果数据集不是模型匹配的数据集或者代表性不够,则根据校准集计算得到的量化因子,在全数据集上表现较差,量化损失大,量化后精度低。 |

训练数据集 |

数据集的子集,基于用户训练网络中的数据集,用于对模型进行训练。 |

量化因子 |

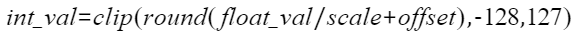

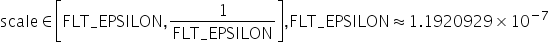

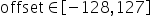

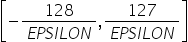

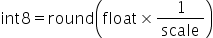

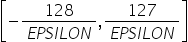

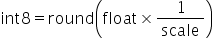

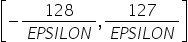

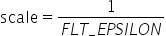

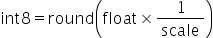

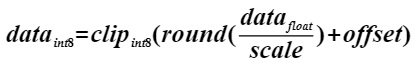

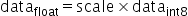

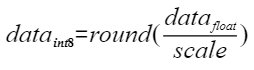

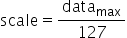

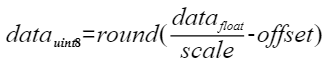

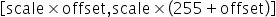

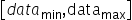

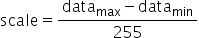

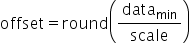

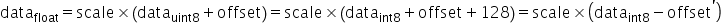

将浮点数量化为整数的参数,包括缩放因子(scale),偏移量(offset)。 将浮点数量化为整数(以INT8为例)的公式如下:

|

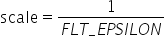

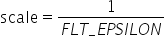

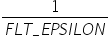

scale |

量化因子,浮点数的缩放因子,该参数又分为:

|

offset |

量化因子,偏移量,该参数又分为:

|

量化敏感度 |

模型在不同数据精度下,计算结果是有差异的,正常情况下,数据精度越高计算越准确,网络模型的推理结果越准确,而使用量化方法降低网络模型或者某层的数据精度后,会影响模型推理的精度。为了评估这种影响,引入量化敏感度的概念。 量化敏感度用于评价网络模型或者可量化层受量化影响大小。通过比较网络的输出或者某层的输出在量化前后的差异来计算量化敏感度,常见的指标有MSE(Mean Square Error,均方误差),余弦相似度等。 |

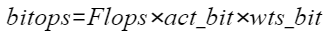

比特复杂度 |

对模型中的某层来说,浮点计算量为Flops。而比特复杂度(bitops)则综合了浮点计算量和数据精度,描述在不同的数据精度下(比如,float32/float16/INT8/INT4),计算资源存在的差异。 具体计算方法如下,其中Flops为浮点计算量,act_bit为数据的数据精度,wts_bit为权重的数据精度。

|

训练后量化¶

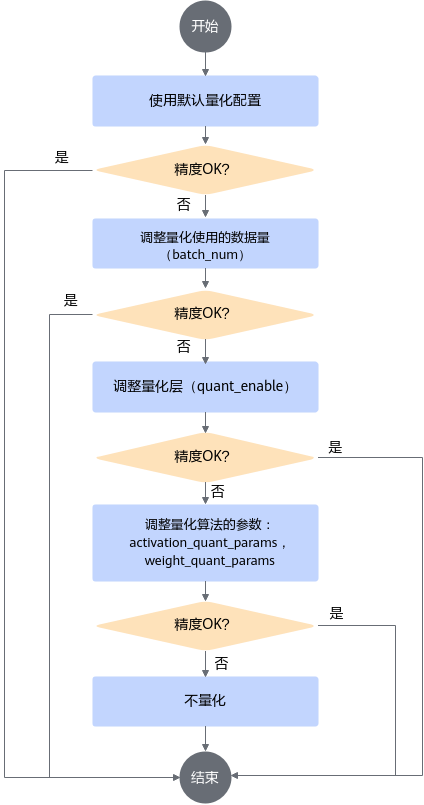

基于精度的自动量化是为了方便用户在对量化精度有一定要求时所使用的功能。该方法能够在保证用户所需的模型精度前提下,自动搜索模型的量化配置并执行训练后量化的流程,最终生成满足精度要求的量化模型。

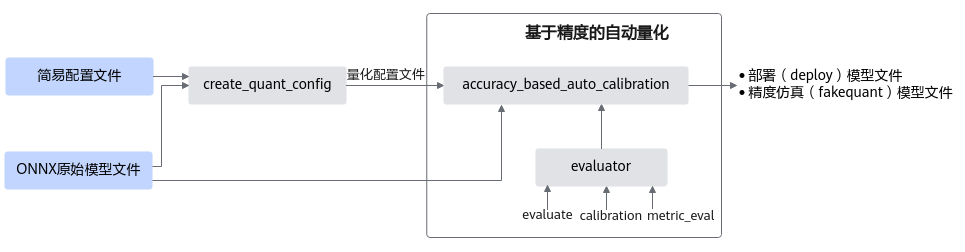

基于精度的自动量化¶

基于精度的自动量化是为了方便用户在对量化精度有一定要求时所使用的功能。该方法能够在保证用户所需的模型精度前提下,自动搜索模型的量化配置并执行训练后量化的流程,最终生成满足精度要求的量化模型。

基于精度的自动量化基本原理与手工量化相同,但是用户无需手动调整量化配置文件,大大简化了优化流程,提高量化效率。量化支持的层以及约束请参见均匀量化,量化示例请参见样例列表。

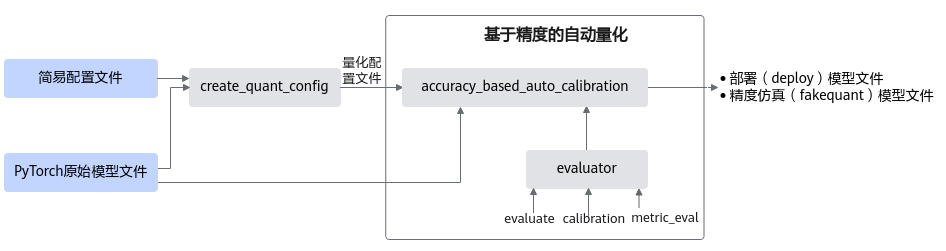

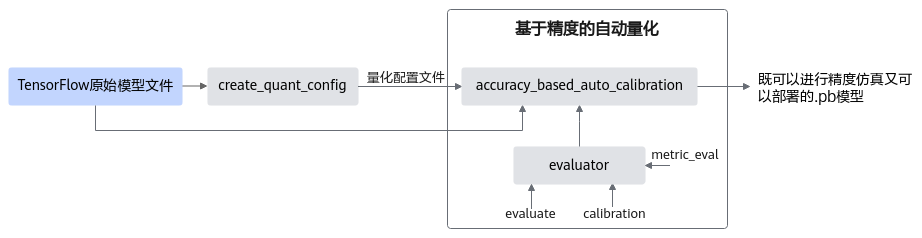

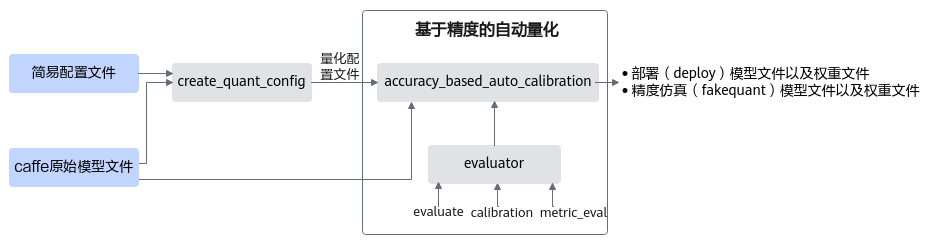

接口调用流程

接口调用流程如图1所示。

图 1 接口调用流程

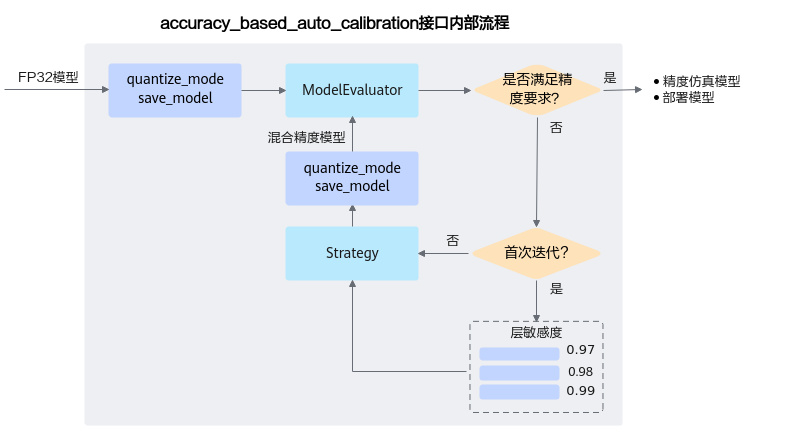

主要流程如下:

调用create_quant_config生成量化配置文件,然后调用accuracy_based_auto_calibration进行基于精度的自动量化。

调用accuracy_based_auto_calibration中由用户传入的evaluator实例进行精度测试,得到原始模型精度。

该过程还会调用accuracy_based_auto_calibration中的量化策略strategy模块,输出初始化的quant config量化配置文件,该文件记录所有层都可以进行量化。

使用用户传入的初始量化配置文件(1中调用create_quant_config生成的)对模型进行训练后量化,得到量化后fake quant模型的精度。

原始模型精度与量化后fake quant模型精度进行比较,如果精度达标,则输出量化后的部署模型和fake quant模型,如果不达标,则进行基于精度的自动量化流程:

进行原始PyTorch网络的推理, dump出每一层的输入activation数据,缓存起来;

利用训练后量化的量化因子构造量化层的单算子网络,利用缓存的activation数据计算量化后fake quant单算子网络的输出数据和原始PyTorch单算子网络输出的余弦相似度。

将余弦相似度的列表传给accuracy_based_auto_calibration中的量化策略strategy模块,strategy模块基于2中生成的初始化的量化配置文件,输出回退某些层后的新的quant config量化配置文件。

根据quant config量化配置文件重新进行训练后量化,得到回退后的fake quant模型。

调用accuracy_based_auto_calibration中的evaluator模块进行回退后的fake quant模型精度测试,查看精度是否达标:

如果达标,则输出回退后的fake quant模型以及部署模型。

如果不达标,则将余弦相似度排序最差的层回退,再次进行4.c,输出新的量化配置。

如果回退所有层后精度仍不达标,则不生成量化模型。

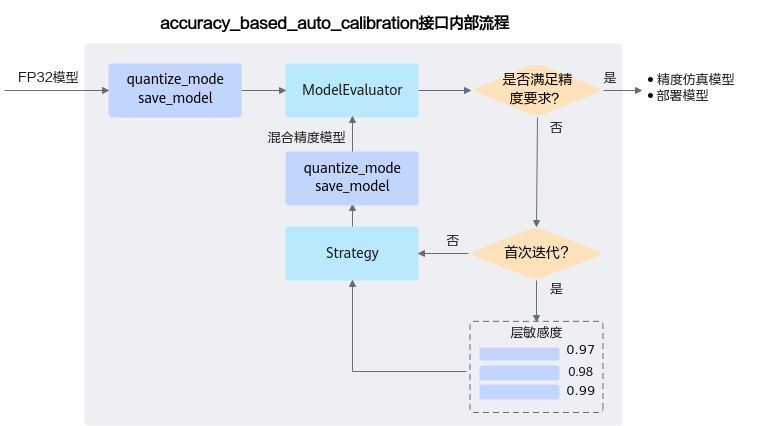

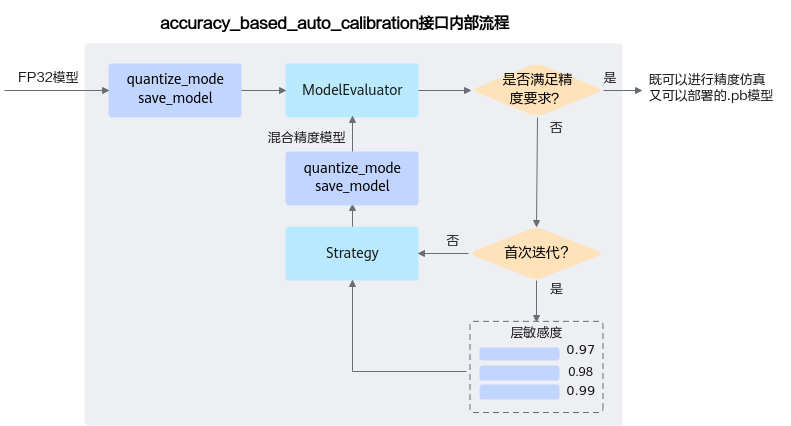

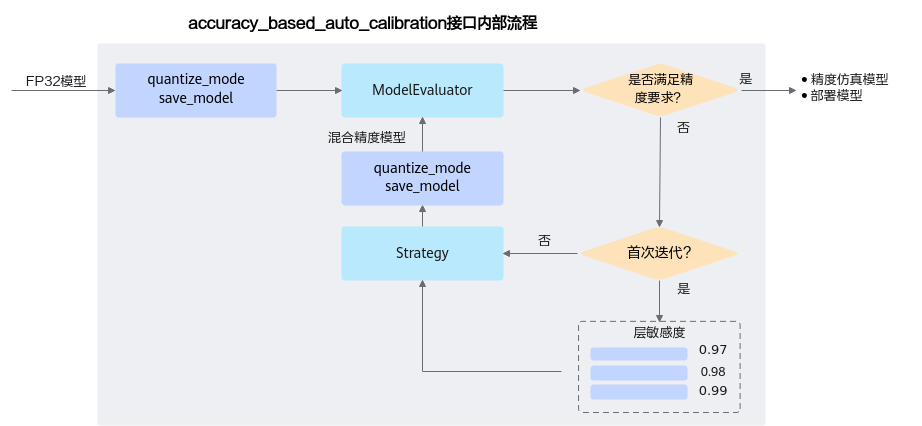

accuracy_based_auto_calibration接口内部基于精度的自动量化流程如图2所示。

图 2 自动量化流程

调用示例

本示例演示使用AMCT进行基于精度的自动量化流程。该过程需要用户实现一个模型推理得到精度的回调函数,由于AMCT需要基于回调函数返回的精度数据进行量化层的筛选,因此回调函数的返回数值应尽可能反映模型的精度。

说明:

如下示例标有“由用户补充处理”的步骤,需要用户根据自己的模型和数据集进行补充处理,示例中仅为示例代码。

如下示例调用AMCT的部分,函数入参请根据实际情况进行调整。

导入AMCT包。

import os import amct_pytorch as amct from amct_pytorch.common.auto_calibration import AutoCalibrationEvaluatorBase

(由用户补充处理)使用原始待量化的模型和测试集,实现回调函数calibration()、evaluate()、metric_eval()。

上述回调函数的入参要和基类AutoCalibrationEvaluatorBase保持一致。其中:

calibration()完成校准的推理。

evaluate()完成模型的精度测试过程。

metric_eval()完成原始模型和量化fake quant模型的精度损失评估,当精度损失小于预期值时返回True,否则返回False。

class ModelEvaluator(AutoCalibrationEvaluatorBase): # The evaluator for model def __init__(self, *args, **kwargs): # 成员变量初始化 # 设置预期精度损失,此处请替换为具体的数值 self.diff = expected_acc_loss pass def calibration(self, model_file, weights_file): # 进行模型的校准推理,推理的batch数要和量化配置的batch_num一致 pass def evaluate(self, model_file, weights_file): # evaluate the input models, get the eval metric of model pass def metric_eval(self, original_metric, new_metric): # 评估原始模型精度和量化模型精度的精度损失是否满足预期,满足返回True, 精度损失数据;否则返回False, 精度损失数据 loss = original_metric - new_metric if loss < self.diff: return True, loss return False, loss

(由用户补充处理)实例化pytorch模型,得到模型的对象。

model = MyNet()调用AMCT,进行基于精度的自动量化。

生成量化配置。

config_json_file = './config.json' skip_layers = [] batch_num = 1 amct.create_quant_config(config_json_file, model, input_data, skip_layers, batch_num) scale_offset_record_file = os.path.join(TMP, 'scale_offset_record.txt') result_path = os.path.join(RESULT, 'model')

初始化Evaluator。

evaluator = AutoCalibrationEvaluator()进行基于精度的量化配置自动搜索。

amct.accuracy_based_auto_calibration( model=model, model_evaluator=evaluator, config_file=config_json_file, record_file=record_file, save_dir=result_path, input_data=input_data, input_names=['input'], output_names=['output'], dynamic_axes={ 'input': {0: 'batch_size'}, 'output': {0: 'batch_size'} }, strategy='BinarySearch', sensitivity='CosineSimilarity' )

手工量化¶

均匀量化是指量化后的数据比较均匀地分布在某个数值空间中,例如INT8量化就是用只有8比特的INT8数据来表示32比特的float32数据或16比特的float16数据,将float32/float16的卷积运算过程(乘加运算)转换为INT8的卷积运算,加速运算和实现模型压缩;均匀的INT8量化则是量化后数据比较均匀地分布在INT8的数值空间[-128, 127]中。 非均匀量化是指量化后的数据在某个数值空间中的分布是不均匀的。非均匀量化过程中,会根据待量化数据的概率分布来对均匀量化后的数据分布进一步进行根据目标压缩率(保留数值量/原始量化数值量)的聚类操作。相较于均匀量化,非均匀量化在进一步压缩数据信息量的基础上尽可能的保留高概率分布的数据信息,从而减小压缩后的数据信息丢失。 执行训练后量化特性的精度如果不满足要求,可以尝试手动调整config.json文件中的参数,本节给出调整的原则,以及参数解释。

均匀量化¶

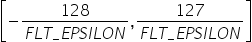

均匀量化是指量化后的数据比较均匀地分布在某个数值空间中,例如INT8量化就是用只有8比特的INT8数据来表示32比特的float32数据或16比特的float16数据,将float32/float16的卷积运算过程(乘加运算)转换为INT8的卷积运算,加速运算和实现模型压缩;均匀的INT8量化则是量化后数据比较均匀地分布在INT8的数值空间[-128, 127]中。

如果均匀量化后的模型精度无法满足要求,则需要进行基于精度的自动量化或量化感知训练或手工调优。均匀量化支持量化的层以及约束如下,量化示例请参见样例列表。

表 1 均匀量化支持的层以及约束

支持的层类型 |

约束 |

备注 |

|---|---|---|

torch.nn.Linear |

- |

复用层(共用weight和bias参数)不支持量化。 |

torch.nn.Conv2d |

|

|

torch.nn.ConvTranspose2d |

|

|

torch.nn.ConvTranspose1d |

padding_mode为zeros |

|

torch.nn.Conv1d |

|

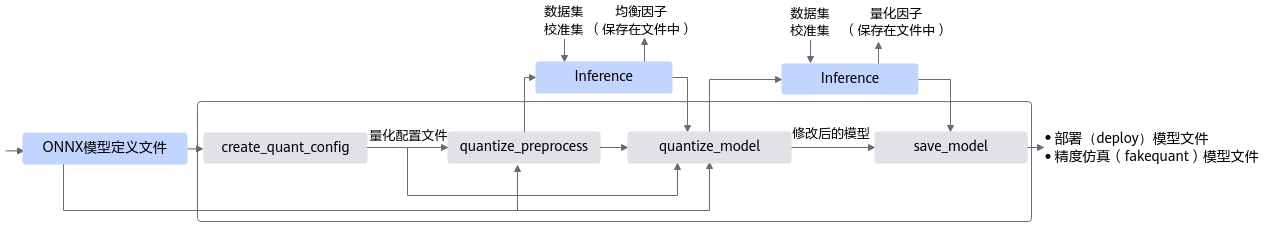

接口调用流程

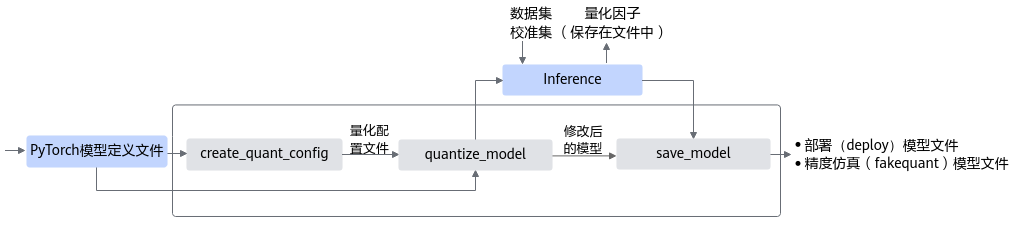

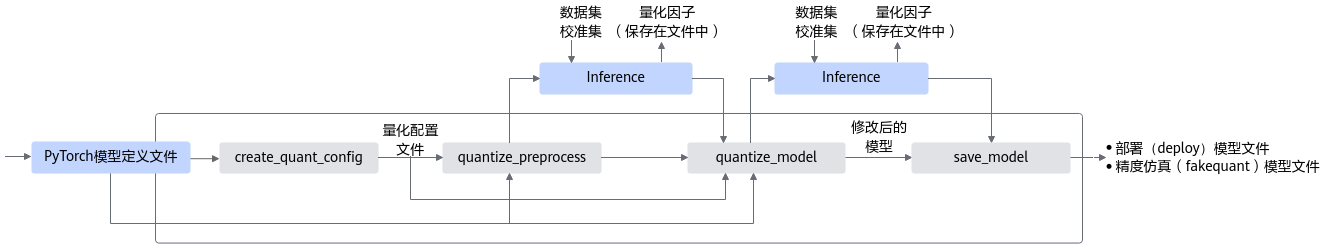

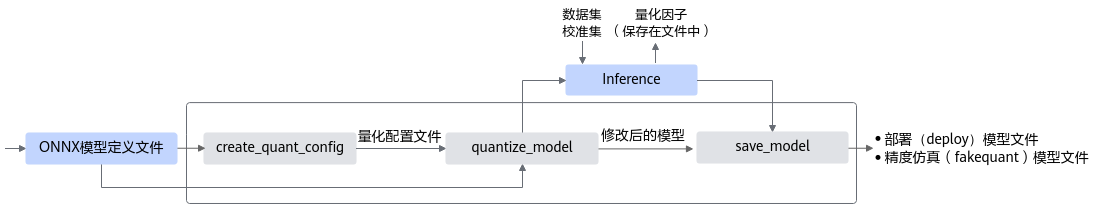

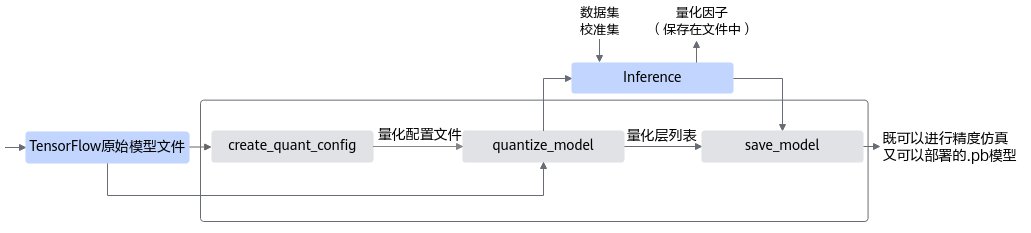

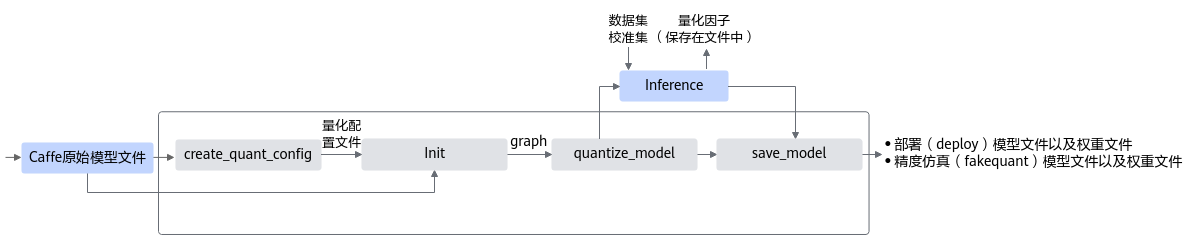

均匀量化接口调用流程如图1所示。

图 1 均匀量化接口调用流程

蓝色部分为用户实现,灰色部分为用户调用AMCT提供的API实现,工具使用分为如下场景:

用户首先构造PyTorch的原始模型,然后使用create_quant_config生成量化配置文件。

根据PyTorch模型和量化配置文件,即可调用quantize_model接口对原始PyTorch模型进行优化,优化后的PyTorch模型中包含了量化算法。

使用校准集在PyTorch环境下执行前向推理,产生量化因子,并将量化因子输出到文件中。

最后用户可以调用save_model接口保存量化后的模型,包括可在ONNX执行框架ONNX Runtime环境中进行精度仿真的模型文件和可部署在NPU IP加速器的模型文件。

精度仿真模型文件:ONNX格式的模型文件,模型名中包含fake_quant,可以在ONNX Runtime环境进行精度仿真。

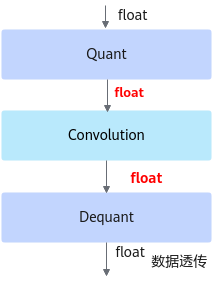

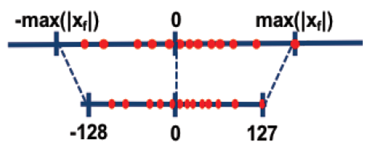

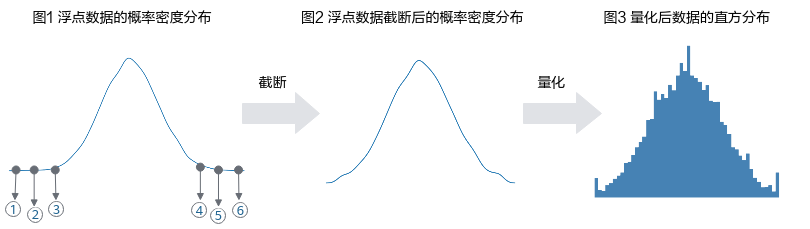

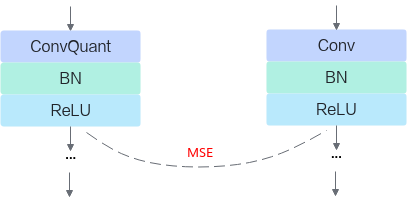

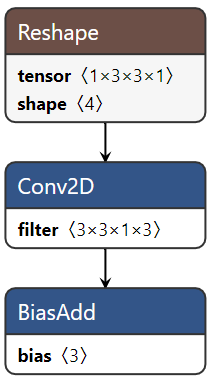

fake_quant模型主要用于验证量化后模型的精度,可以在ONNX Runtime环境下运行。进行前向推理的计算过程中,在fake_quant模型中对卷积层等的输入数据和权重进行了量化反量化的操作,来模拟量化后的计算结果,从而快速验证量化后模型的精度。如下图所示,以INT8量化为例,Quant层、Conv2d卷积层和DeQuant层之间的数据都是float32数据类型的,其中Quant层将数据量化到INT8又反量化为float32,权重也是量化到INT8又反量化为float32,实际卷积层的计算是基于float32数据类型的,该模型用于在ONNX Runtime环境验证量化后模型的精度,不能够用于ATC工具转换成om模型。

图 2 fake_quant模型

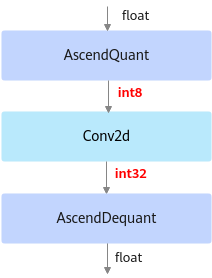

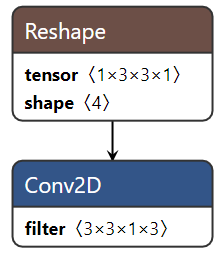

部署模型文件:ONNX格式的模型文件,模型名中包含deploy,经过ATC转换工具转换后可部署到NPU IP加速器。

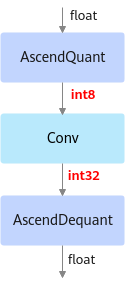

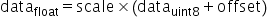

以INT8量化为例,deploy模型由于已经将权重等转换为INT8,INT32类型,因此不能在ONNX Runtime环境上执行推理计算。如下图所示,deploy模型的AscendQuant层将float32的输入数据量化为INT8,作为卷积层的输入,权重也是使用INT8数据类型作为计算,在deploy模型中的卷积层的计算是基于INT8,INT32数据类型的,输出为INT32数据类型经过AscendDeQuant层转换成float32数据类型传输给下一个网络层。

图 3 deploy模型

调用示例

训练后量化主要包括如下几个步骤:

准备训练好的模型和数据集。

在原始PyTorch环境中验证模型精度以及环境是否正常。

编写训练后量化脚本调用AMCT API。

执行训练后量化脚本。

在ONNX Runtime环境中验证量化后仿真模型精度。

说明:

由于软件约束(动态shape场景下暂不支持输入数据为DT_INT8),量化后的部署模型使用ATC工具进行模型转换时,不能使用动态shape相关参数,例如--dynamic_batch_size和--dynamic_image_size等,否则模型转换会失败。

使用AMCT工具量化后的部署模型,使用ATC工具进行模型转换时,不能再使用高精度特性,比如不能再通过--precision_mode参数配置force_fp32或must_keep_origin_dtype(原图fp32输入);不能再通过--precision_mode_v2参数配置origin;不能通过--op_precision_mode配置high_precision参数等。在高精度模式下设置量化参数,既拿不到量化的性能收益,也拿不到高精度模式的精度收益。

如下示例标有“由用户补充处理”的步骤,需要用户根据自己的模型和数据集进行补充处理,示例中仅为示例代码。

如下示例调用AMCT的部分,函数入参请根据实际情况进行调整。

导入AMCT包,并通过安装后处理>AMCT(PyTorch)中的环境变量设置日志级别。

import amct_pytorch as amct(可选,由用户补充处理)在PyTorch原始环境中验证推理脚本及环境。

建议使用原始待量化的模型和测试集,在PyTorch环境下推理,验证环境、推理脚本是否正常。

推荐执行该步骤,请确保原始模型可以完成推理且精度正常;执行该步骤时,可以使用部分测试集,减少运行时间。

user_do_inference_torch(ori_model, test_data, test_iterations)调用AMCT,量化模型。

生成量化配置。

config_file = './tmp/config.json' skip_layers = [] batch_num = 1 amct.create_quant_config(config_file=config_file, model=ori_model, input_data=ori_model_input_data, skip_layers=skip_layers, batch_num=batch_num)

修改图,在图中插入数据量化,权重量化等相关的算子,用于计算量化相关参数。

record_file = './tmp/record.txt' modified_onnx_model = './tmp/modified_model.onnx' calibration_model = amct.quantize_model(config_file=config_file, modified_onnx_model=modified_onnx_model, record_file=record_file, model=ori_model, input_data=ori_model_input_data)

(由用户补充处理)基于PyTorch环境,使用修改后的模型(calibration_model)在校准集(calibration_data)上做模型推理,生成量化因子。

该步骤执行时,需要注意如下两点:

校准集及其预处理过程数据要与模型匹配,以保证量化的精度。

前向推理次数为batch_num,如果次数不足,由于校准算子没有将量化因子输出到record文件中,会导致后续读取record校验失败。

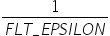

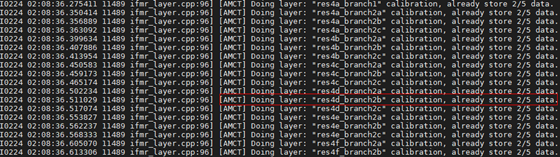

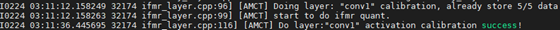

校准过程中如果提示[IFMR]: Do layer xxx data calibration failed!错误信息,则请参见校准执行过程中提示“[IFMR]: Do layer xxx data calibration failed!”解决。

user_do_inference_torch(calibration_model, calibration_data, batch_num)保存模型。

根据量化因子,调用save_model接口,插入AscendQuant、AscendDequant等算子,保存为量化模型。

quant_model_path = './results/user_model' amct.save_model(modified_onnx_file=modified_onnx_file, record_file=record_file, save_path=quant_model_path)

(可选,由用户补充处理)基于ONNX Runtime的环境,使用量化后模型(quant_model)在测试集(test_data)上做推理,测试量化后仿真模型的精度。

使用量化后仿真模型精度与2中的原始精度做对比,可以观察量化对精度的影响。

quant_model = './results/user_model_fake_quant_model.onnx' user_do_inference_onnx(quant_model, test_data, test_iterations)

非均匀量化(不支持)¶

非均匀量化是指量化后的数据在某个数值空间中的分布是不均匀的。非均匀量化过程中,会根据待量化数据的概率分布来对均匀量化后的数据分布进一步进行根据目标压缩率(保留数值量/原始量化数值量)的聚类操作。相较于均匀量化,非均匀量化在进一步压缩数据信息量的基础上尽可能的保留高概率分布的数据信息,从而减小压缩后的数据信息丢失。

说明: 由于硬件约束,该版本不建议使用非均匀量化的功能,获取不到性能收益。

模型在NPU IP加速器上推理时,可通过非均匀量化提高权重压缩率(需要与ATC工具配合,通过编译时使能权重压缩),降低权重传输开销,进一步提升推理性能。非均匀量化后,如果精度仿真模型在原始PyTorch环境中推理精度不满足要求,可通过调整非均匀量化配置文件config.json中的参数来恢复模型精度,调整方法请参见手工调优。量化示例请参见样例列表。

非均匀量化支持量化的层以及约束如下:

表 1 非均匀量化支持的层以及约束

支持的层类型 |

约束 |

|---|---|

torch.nn.Conv2d |

|

torch.nn.Linear |

仅支持带bias规格的非均匀量化,且Shape必须为两维 |

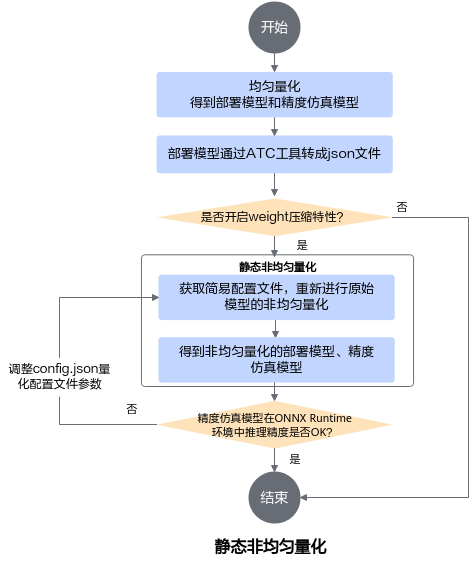

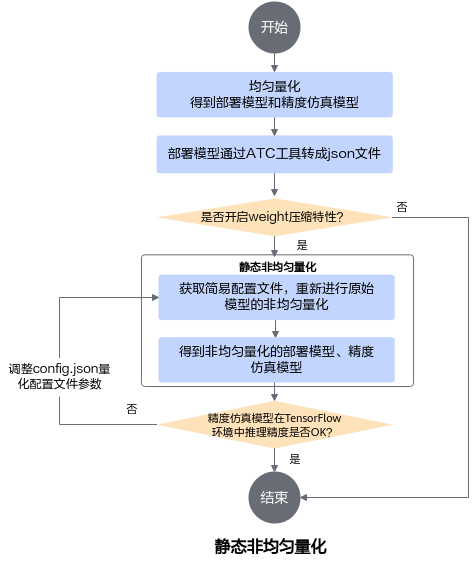

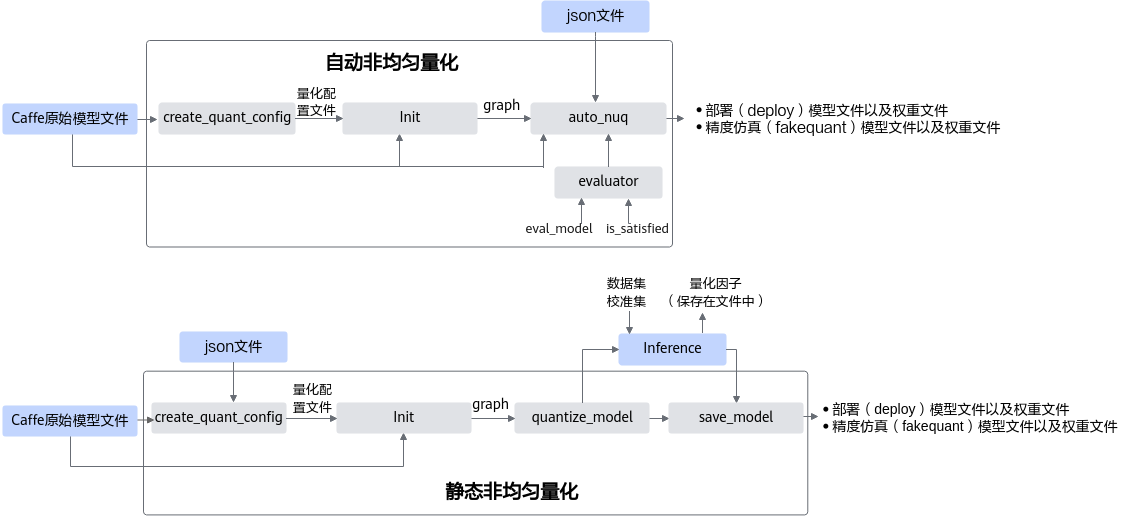

实现流程

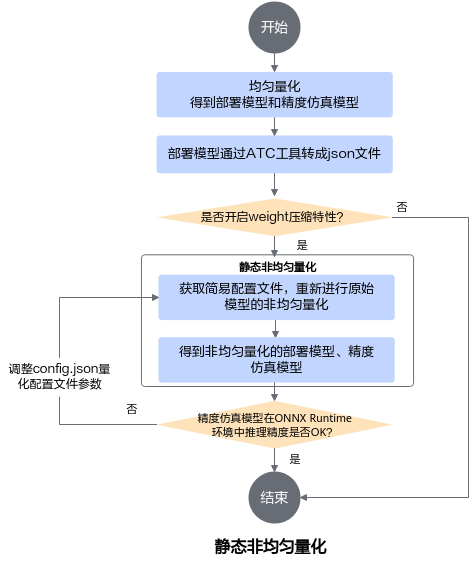

静态非均匀量化实现原理同均匀量化,简要流程如图1所示。

图 1 非均匀量化流程图

详细流程说明如下:

参见均匀量化章节获取均匀量化的部署模型和精度仿真模型。

参见《ATC离线模型编译工具用户指南》将1中生成的部署模型转换成JSON文件,该JSON文件记录了量化后模型的融合信息,同时也携带了支持weight压缩特性层的信息(通过fe_weight_compress字段识别)。

如果要进行weight压缩,则参见训练后量化简易配置文件章节获取非均匀量化简易配置文件,然后获取2生成的量化后模型的融合JSON文件进行非均匀量化。

非均匀量化过程中,会根据融合JSON文件,获取原始模型中哪些层支持weight压缩,然后重新生成非均匀量化的部署模型和量化配置文件。

查看非均匀量化后,精度仿真模型在原始ONNX Runtime环境中推理精度是否满足要求,如果不满足要求,则需要调整非均匀量化配置文件config.json中的参数,然后重新进行非均匀量化,直至满足精度要求。调整方法请参见手工调优。

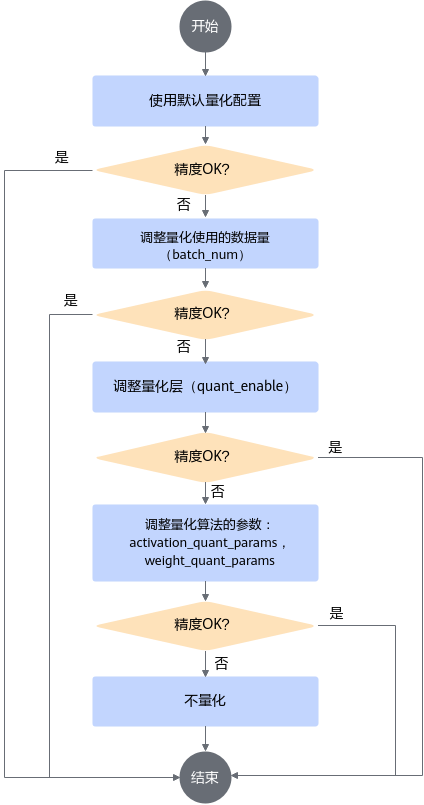

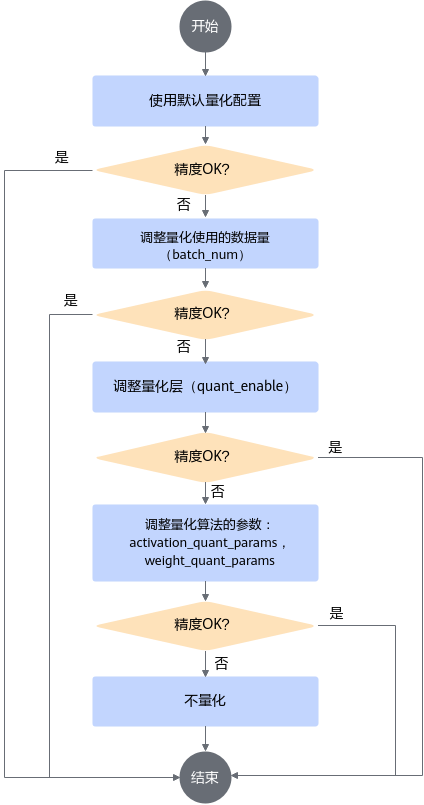

手工调优¶

执行训练后量化特性的精度如果不满足要求,可以尝试手动调整config.json文件中的参数,本节给出调整的原则,以及参数解释。

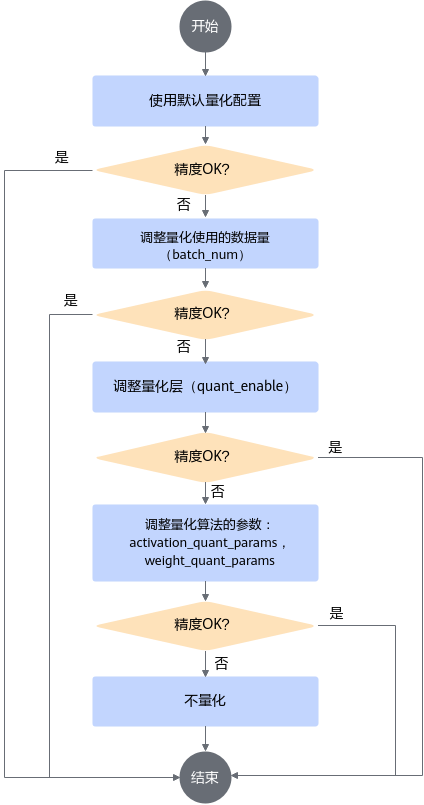

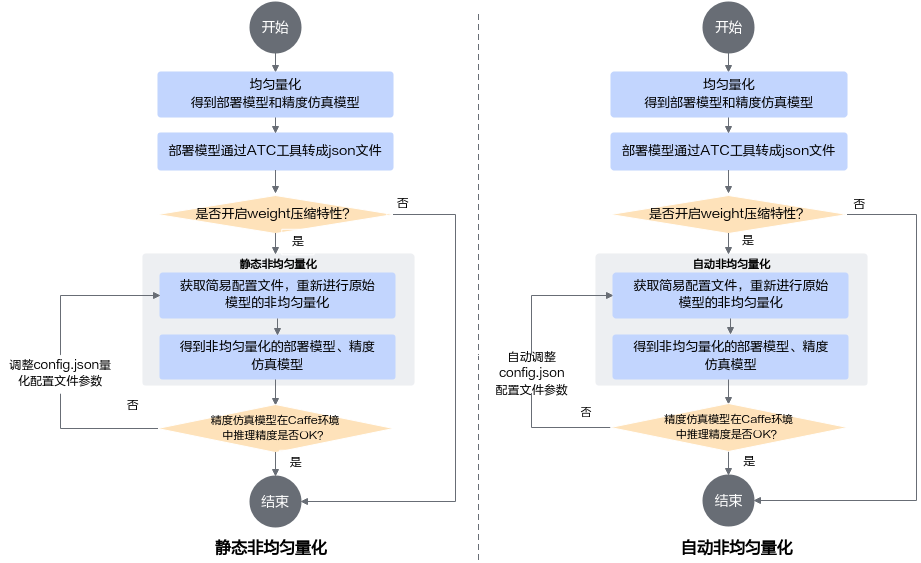

调优流程

通过create_quant_config接口生成的config.json文件中的默认配置进行量化,若量化后的推理精度不满足要求,则可调整量化配置重复量化,直至精度满足要求。本节详细介绍手动调优流程,调整对象是训练后量化配置文件config.json中的参数,主要涉及3个阶段:

调整校准使用的数据量。

跳过量化某些层。

调整量化算法及参数。

具体步骤如下:

根据create_quant_config接口生成的默认配置进行量化。若精度满足要求,则调参结束,否则进行2。

手动修改batch_num,调整校准使用的数据量。

batch_num控制量化使用数据的batch数目,可根据batch大小以及量化需要使用的图片数量调整。通常情况下:

batch_num越大,量化过程中使用的数据样本越多,量化后精度损失越小;但过多的数据并不会带来精度的提升,反而会占用较多的内存,降低量化的速度,并可能引起内存、显存、线程资源不足等情况;因此,建议batch_num*batch_size为16或32(batch_size表示每个batch使用的图片数量)。

手动修改quant_enable,跳过量化某些层。

quant_enable可以指定该层是否量化,取值为true时量化该层,取值为false时不量化该层,将该层的配置删除也可跳过该层量化。

在整网精度不达标的时候需要识别出网络中的量化敏感层(量化后误差显著增大),然后取消对量化敏感层的量化动作,识别量化敏感层有两种方法:

依据网络模型结构,一般网络中首层、尾层以及参数量偏少的层,量化后精度会有较大的下降。

通过精度比对工具,逐层比对原始模型和量化后模型输出误差(例如以余弦相似度作为标准,需要相似度达到0.99以上),找到误差较大的层,优先对其进行回退。

手动修改activation_quant_params和weight_quant_params,调整量化算法及参数:

算法参数意义请参见量化配置文件中的参数说明部分,算法说明请参见训练后量化算法。

若按照6中的量化配置进行量化后,精度满足要求,则调参结束,否则表明量化对精度影响很大,不能进行量化,去除量化配置。

图 1 调参流程

量化配置文件

如果通过create_quant_config接口生成的config.json量化配置文件,推理精度不满足要求,则需要参见该章节不断调整config.json文件中的内容(用户修改JSON文件时,请确保层名唯一),直至精度满足要求,json量化配置文件样例请参见接口中的调用示例部分。

配置文件中参数说明如下:

表 1 version参数说明

作用 |

控制量化配置文件版本号。 |

|---|---|

类型 |

int |

取值范围 |

1 |

参数说明 |

目前仅有一个版本号1。 |

推荐配置 |

1 |

可选或者必选 |

可选 |

表 2 batch_num参数说明

作用 |

控制量化使用多少个batch的数据。 |

|---|---|

类型 |

int |

取值范围 |

大于0 |

参数说明 |

如果不配置,则使用默认值1,建议校准集图片数量不超过50张,根据batch的大小batch_size计算相应的batch_num数值。 batch_num*batch_size为量化使用的校准集图片数量。 其中batch_size为每个batch所用的图片数量。 |

推荐配置 |

1 |

必选或可选 |

可选 |

表 3 activation_offset参数说明

作用 |

控制数据量化是对称量化还是非对称量化。全局配置参数。 若配置文件中同时存在activation_offset和asymmetric参数,asymmetric参数优先级>activation_offset参数。 |

|---|---|

类型 |

bool |

取值范围 |

true或false |

参数说明 |

|

推荐配置 |

true |

必选或可选 |

可选 |

表 4 do_fusion参数说明

作用 |

是否开启融合功能。 |

|---|---|

类型 |

bool |

取值范围 |

true或false |

参数说明 |

当前仅支持Conv+BN融合。 |

推荐配置 |

true |

可选或必选 |

可选 |

表 5 skip_fusion_layers参数说明

作用 |

跳过可融合的层。 |

|---|---|

类型 |

string |

取值范围 |

可融合层的层名。当前仅支持Conv+BN融合。 |

参数说明 |

不需要做融合的层。 |

推荐配置 |

- |

可选或必选 |

可选 |

表 6 layer_config参数说明

作用 |

指定某个网络层的量化配置。 |

|---|---|

类型 |

object |

取值范围 |

- |

参数说明 |

参数内部包含如下参数:

|

推荐配置 |

- |

必选或可选 |

可选 |

表 7 quant_enable参数说明

作用 |

该层是否做量化。 |

|---|---|

类型 |

bool |

取值范围 |

true或false |

参数说明 |

|

推荐配置 |

true |

必选或可选 |

可选 |

表 8 dmq_balancer_param参数说明

作用 |

DMQ均衡算法中的迁移强度。 |

|---|---|

类型 |

float |

取值范围 |

[0.2, 0.8] |

参数说明 |

代表将activation数据上的量化难度迁移至weight权重的程度,数据分布的离群值越大迁移强度应设置较小。 |

推荐配置 |

0.5 |

必选或可选 |

可选 |

表 9 activation_quant_params参数说明

作用 |

该层数据量化的参数。 |

|---|---|

类型 |

object |

取值范围 |

- |

参数说明 |

activation_quant_params内部包含如下参数,IFMR算法相关参数与HFMG算法相关参数在同一层中不能同时出现:

|

推荐配置 |

- |

必选或可选 |

可选 |

表 10 weight_quant_params参数说明

作用 |

该层权重量化的参数。 |

|---|---|

类型 |

object |

取值范围 |

- |

参数说明 |

|

推荐配置 |

- |

必选或可选 |

可选 |

表 11 num_bits参数说明

作用 |

量化位宽。 |

|---|---|

类型 |

int |

取值范围 |

8或16 |

参数说明 |

当前仅支持配置为8,表示采用INT8量化位宽。 |

推荐配置 |

- |

必选或可选 |

必选 |

表 12 act_algo参数说明

作用 |

数据量化算法。 |

|---|---|

类型 |

string |

取值范围 |

ifmr或者hfmg |

参数说明 |

IFMR数据量化算法:ifmr HFMG数据量化算法:hfmg |

推荐配置 |

- |

必选或可选 |

可选 |

表 13 asymmetric参数说明

作用 |

控制数据量化是对称量化还是非对称量化。用于控制逐层量化算法的选择。 若配置文件中同时存在activation_offset和asymmetric参数,asymmetric参数优先级>activation_offset参数。 |

|---|---|

类型 |

bool |

取值范围 |

true或false |

参数说明 |

|

推荐配置 |

true |

必选或可选 |

可选 |

表 14 max_percentile参数说明

作用 |

IFMR数据量化算法中,最大值搜索位置参数。 |

|---|---|

类型 |

float |

取值范围 |

(0.5,1] |

参数说明 |

在从大到小排序的一组数中,决定取第多少大的数,比如有100个数,1.0表示取第100-100*1.0=0,对应的就是第一个大的数。 对待量化的数据做截断处理时,该值越大,说明截断的上边界越接近待量化数据的最大值。 |

推荐配置 |

0.999999 |

必选或可选 |

可选 |

表 15 min_percentile参数说明

作用 |

IFMR数据量化算法中,最小值搜索位置参数。 |

|---|---|

类型 |

float |

取值范围 |

(0.5,1] |

参数说明 |

在从小到大排序的一组数中,决定取第多少小的数,比如有100个数,1.0表示取第100-100*1.0=0,对应的就是第一个小的数。 对待量化的数据做截断处理时,该值越大,说明截断的下边界越接近待量化数据的最小值。 |

推荐配置 |

0.999999 |

必选或可选 |

可选 |

表 16 search_range参数说明

作用 |

IFMR数据量化算法中,控制量化因子的搜索范围[search_range_start, search_range_end]。 |

|---|---|

类型 |

list,列表中两个元素类型为float。 |

取值范围 |

0<search_range_start<search_range_end |

参数说明 |

控制截断的上边界的浮动范围。

|

推荐配置 |

[0.7,1.3] |

必选或可选 |

可选 |

表 17 search_step参数说明

作用 |

IFMR数据量化算法中,控制量化因子的搜索步长。 |

|---|---|

类型 |

float |

取值范围 |

(0, (search_range_end-search_range_start)] |

参数说明 |

控制截断的上边界的浮动范围步长,值越小,浮动步长越小。 搜索次数search_iteration=(search_range_end-search_range_start)/search_step,如果搜索次数过大,搜索时间会很长,该场景下将会导致类似进程卡死的问题。 |

推荐配置 |

0.01 |

必选或可选 |

可选 |

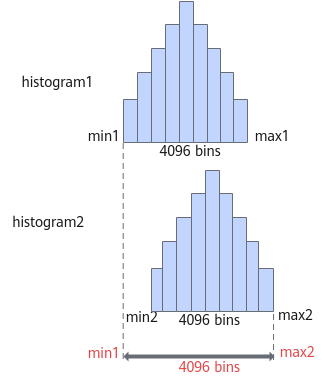

表 18 num_of_bins参数说明

作用 |

HFMG数据量化算法用于调整直方图的bin(直方图中的一个最小单位直方图形)数目。 |

|---|---|

类型 |

unsigned int |

取值范围 |

{1024, 2048, 4096, 8192} |

参数说明 |

num_of_bins数值越大,直方图拟合原始数据分布的能力越强,可能获得更佳的量化效果,但训练后量化过程的耗时也会更长。 |

推荐配置 |

4096 |

必选或可选 |

HFMG算法量化场景下,该参数可选。 |

表 19 wts_algo参数说明

作用 |

权重量化算法 |

|---|---|

类型 |

string |

取值范围 |

arq_quantize |

参数说明 |

ARQ权重量化算法:arq_quantize |

推荐配置 |

- |

必选或可选 |

可选 |

表 20 channel_wise搜索相关参数说明

作用 |

ARQ权重量化算法中,是否对每个channel采用不同的量化因子。 |

|---|---|

类型 |

bool |

取值范围 |

true或false |

参数说明 |

|

推荐配置 |

true |

必选或可选 |

可选 |

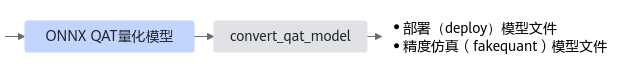

量化感知训练¶

本节详细介绍量化感知训练支持的量化层,接口调用流程和示例。 执行量化感知训练特性后的精度如果不满足要求,可以尝试手动调整config.json文件中的参数,本节给出调整的原则,以及参数解释。

量化流程¶

本节详细介绍量化感知训练支持的量化层,接口调用流程和示例。

量化感知训练当前仅支持对float32数据类型的网络模型进行量化。量化感知训练支持量化的层以及约束如下,量化示例请参见样例列表。

表 1 量化感知训练支持的层以及约束

支持的层类型 |

约束 |

备注 |

|---|---|---|

torch.nn.Linear |

- |

|

torch.nn.Conv1d |

|

|

torch.nn.Conv2d |

|

|

torch.nn.ConvTranspose2d |

|

|

torch.nn.ConvTranspose1d |

|

|

torch.nn.LSTM |

|

|

torch.nn.GRU |

|

接口调用流程

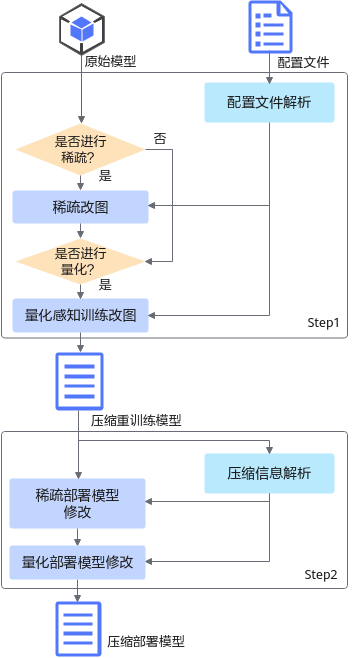

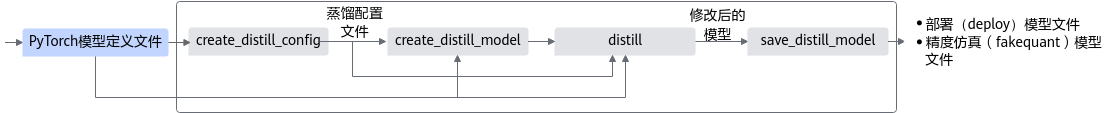

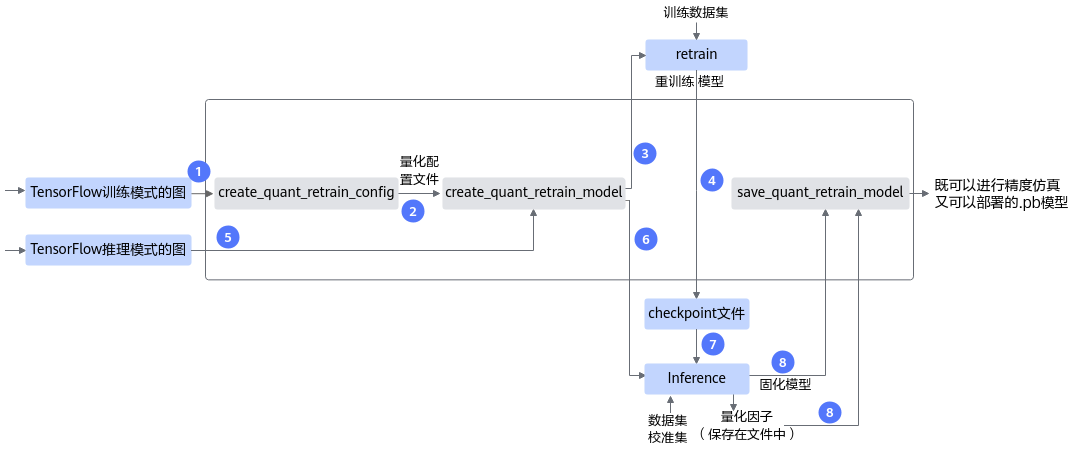

量化感知训练接口调用流程如图1所示,如下流程中的训练环境借助PyTorch框架的CPU/GPU环境,在该开源框架的推理脚本基础上,调用AMCT API完成模型压缩,压缩后的部署模型需要使用ATC工具转换成适配NPU IP加速器的离线模型后,然后才能在NPU IP加速器上实现推理:

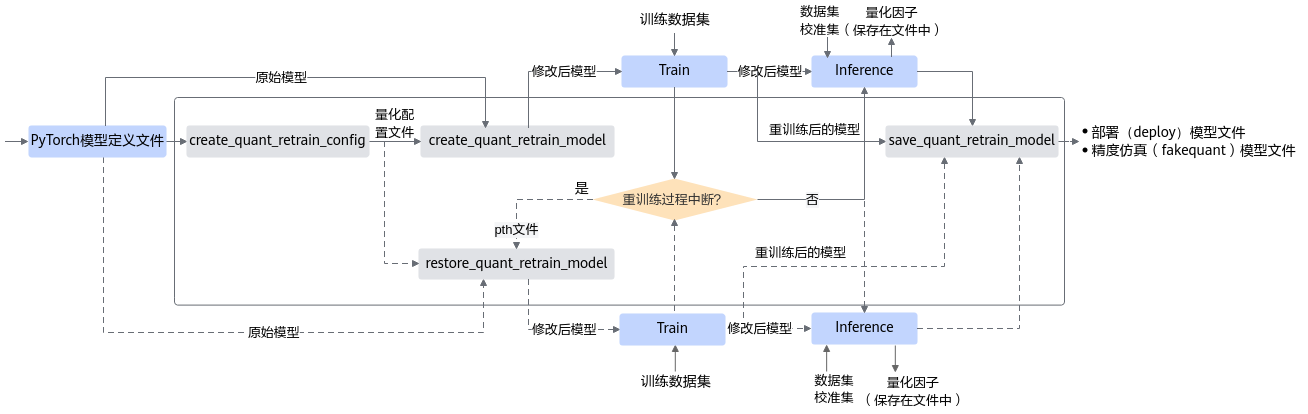

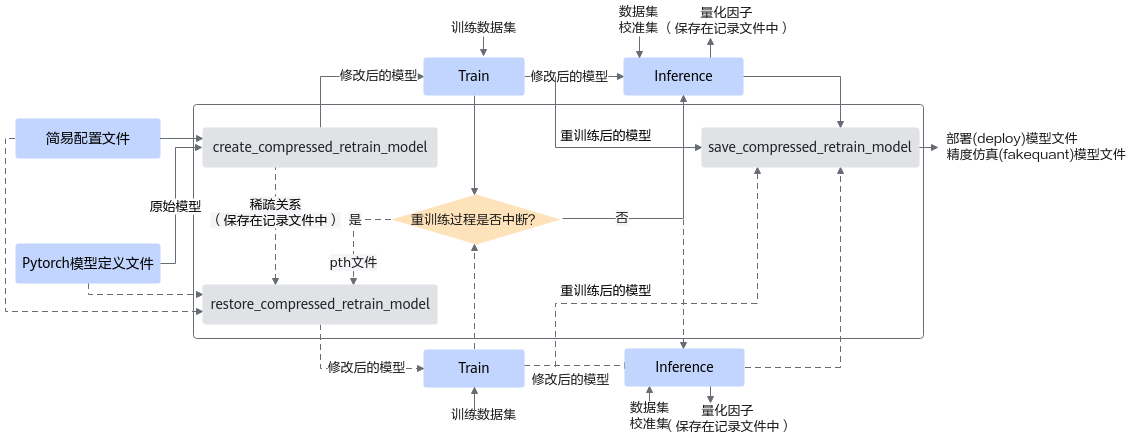

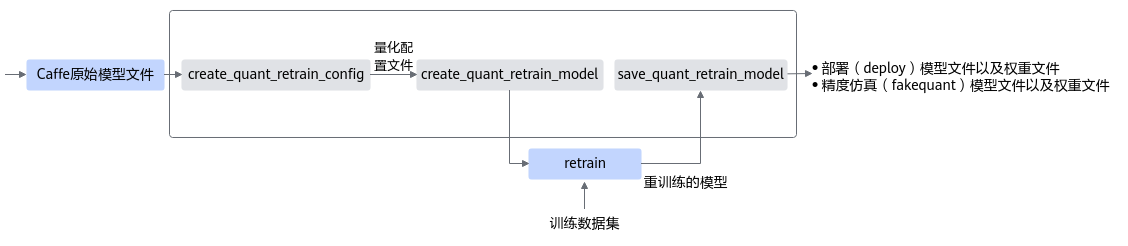

图 1 接口调用流程

蓝色部分为用户实现,灰色部分为用户调用AMCT提供的API实现:

用户首先构造PyTorch的原始模型,调用create_quant_retrain_config接口生成量化配置文件。

调用create_quant_retrain_model接口对原始模型进行修改,修改后的模型中插入了数据量化、权重量化等相关算子,用于计算量化相关参数。

对修改后的模型进行训练,如果训练未中断,将训练后的模型进行推理,进行推理的过程中,会将量化因子写出到record文件中。

如果训练过程中断,则可基于保存的pth模型参数和量化配置文件,重新调用restore_quant_retrain_model接口,输出修改后的retrain network,继续进行量化感知的训练,然后进行推理。

调用save_quant_retrain_model接口,插入AscendQuant、AscendDequant等量化算子,保存量化模型。

调用示例

说明:

基于PyTorch环境进行训练,当前仅支持distributed模式(即DistributedDataParallel模式)的多卡训练,不支持DataParallel模式的多卡训练,使用DP模式训练会报错。

调用AMCT的部分,函数入参可以根据实际情况进行调整。量化感知训练基于用户的训练过程,请确保已经有基于PyTorch环境进行训练的脚本,并且训练后的精度正常。

使用AMCT的量化感知训练特性时,如果训练过程卡死,请检查当前服务器是否有其他ONNX Runtime程序在运行(可以用top命令查看服务器所有进程),如果有,请先暂停其他ONNX Runtime程序,重新执行量化感知训练。

参考本章节进行量化,模型中存在PyTorch自定义算子时,可能存在无法导出生成ONNX模型,从而导致量化失败的问题。具体报错信息如下:'Model cannot be quantized for it cannot be export to onnx!' 。此时,您可以参考单算子模式的量化感知训练章节,进行单算子模式的量化。

如下示例标有“由用户补充处理”的步骤,需要用户根据自己的模型和数据集进行补充处理,示例中仅为示例代码。

导入AMCT包,并通过安装后处理>AMCT(PyTorch)中的环境变量设置日志级别。

import amct_pytorch as amct(可选,由用户补充处理)建议使用原始待量化的模型和测试集,在PyTorch环境下推理,验证环境、推理脚本是否正常。

推荐执行该步骤,请确保原始模型可以完成推理且精度正常;执行该步骤时,可以使用部分测试集,减少运行时间。

ori_model.load() # 测试模型 user_test_model(ori_model, test_data, test_iterations)

调用AMCT,执行量化流程。

生成量化配置。

实现该步骤前,应先恢复训练好的参数,如2中的ori_model.load()。

config_file = './tmp/config.json' simple_cfg = './retrain.cfg' amct.create_quant_retrain_config(config_file=config_file, model=ori_model, input_data=ori_model_input_data, config_defination=simple_cfg)

修改模型。

在模型ori_model插入数据量化、权重量化等相关算子,用于计算量化相关参数,然后保存为新的训练模型retrain_model。

record_file = './tmp/record.txt' quant_retrain_model = amct.create_quant_retrain_model(config_file=config_file, model=ori_model, record_file=record_file, input_data=ori_model_input_data)

(由用户补充处理)使用修改后的图,创建反向梯度,在训练集上做训练,训练量化因子。

使用修改后的图,创建反向梯度。该步骤需要在3.b后执行。

optimizer = user_create_optimizer(quant_retrain_model)从训练好的checkpoint恢复模型,并训练模型。

注意:从训练好的checkpoint恢复模型参数后再训练;训练中保存的参数应该包括量化因子:前batch_num次训练后会生成量化因子,如果训练次数少于batch_num会导致失败。

quant_pth = './ckpt/user_model' user_train_model(optimizer, quant_retrain_model, train_data)

训练完成后,执行推理,计算量化因子并保存。

user_infer_graph(quant_retrain_model)

保存量化模型。

根据量化因子以及用户重训练好的模型,调用save_quant_retrain_model接口,插入AscendQuant、AscendDequant等算子,保存为量化模型。

quant_model_path = './result/user_model' amct.save_quant_retrain_model(config_file=config_file, model=quant_retrain_model, record_file=record_file, save_path=quant_model_path, input_data=ori_model_input_data)

说明:如果重训练过程每一轮都调用该接口保存模型,可能会导致重训异常,建议重训练完毕后调用该接口保存模型。

(可选,由用户补充处理)基于ONNX Runtime的环境,使用量化后模型(quant_model)在测试集(test_data)上做推理,测试量化后仿真模型的精度。

使用量化后仿真模型精度与2中的原始精度做对比,可以观察量化对精度的影响。

quant_model = './results/user_model_fake_quant_model.onnx' user_do_inference_onnx(quant_model, test_data, test_iterations)

如果训练过程中断,需要从ckpt中恢复数据,继续训练,则调用流程为:

导入AMCT包,并通过安装后处理>AMCT(PyTorch)中的环境变量设置日志级别。

import amct_pytorch as amct准备原始模型。

ori_model= user_create_model()调用AMCT,恢复量化训练流程。

修改模型,在模型ori_model插入量化相关的算子,保存为新的训练模型retrain_model。

config_file = './tmp/config.json' simple_cfg = './retrain.cfg' record_file = './tmp/record.txt' quant_pth_file = './ckpt/user_model_newest.ckpt' quant_retrain_model = amct.restore_quant_retrain_model(config_file=config_file, model=ori_model, record_file=record_file, input_data=ori_model_input_data, pth_file=quant_pth_file)

(由用户补充处理)使用修改后的图,创建反向梯度,在训练集上做训练,训练量化因子。

使用修改后的图,创建反向梯度。该步骤需要在3.a后执行。

optimizer = user_create_optimizer(retrain_model)从训练好的checkpoint恢复模型,并训练模型。

注意:从训练好的checkpoint恢复模型参数后再训练;训练中保存的参数应该包括量化因子:前batch_num次训练后会生成量化因子,如果训练次数少于batch_num会导致失败。

user_train_model(optimizer, retrain_model, train_data)训练完成后,执行推理,计算量化因子并保存。

user_infer_graph(train_graph, retrain_ops[-1].output_tensor)

保存模型。

quant_model_path = './result/user_model' amct.save_quant_retrain_model(config_file=config_file, model=ori_model, record_file=record_file, save_path=quant_model_path, input_data=ori_model_input_data)

(可选,由用户补充处理)基于ONNX Runtime的环境,使用量化后模型(quant_model)在测试集(test_data)上做推理,测试量化后仿真模型的精度。

使用量化后仿真模型精度与2中的原始精度做对比,可以观察量化对精度的影响。

quant_model = './results/user_model_fake_quant_model.onnx' user_do_inference_onnx(quant_model, test_data, test_iterations)

手工调优¶

执行量化感知训练特性后的精度如果不满足要求,可以尝试手动调整config.json文件中的参数,本节给出调整的原则,以及参数解释。

调优流程

通过create_quant_retrain_config接口生成的config.json文件中的默认配置进行量化,若量化后的推理精度不满足要求,则按照如下步骤调整量化配置文件中的参数。

根据create_quant_retrain_config接口生成的默认配置进行量化。若精度满足要求,则调参结束,否则进行下一步。

INT8量化场景下,可以将部分量化层取消量化,即将其"retrain_enable"参数修改为"false",通常模型首尾层对推理结果影响较大,故建议优先取消首尾层的量化;如果用户有推荐的clip_max和clip_min的参数取值,则可以按照如下方式修改量化配置文件:

{ "version":1, "batch_num":1, "layername1":{ "retrain_enable":true, "retrain_data_config":{ "algo":"ulq_quantize", "clip_max":3.0, "clip_min":-3.0 }, "retrain_weight_config":{ "algo":"arq_retrain", "channel_wise":true } }, "layername2":{ "retrain_enable":true, "retrain_data_config":{ "algo":"ulq_quantize", "clip_max":3.0, "clip_min":-3.0 }, "retrain_weight_config":{ "algo":"arq_retrain", "channel_wise":true } } }

完成配置后,精度满足要求则调参结束;否则表明量化感知训练对精度影响很大,不能进行量化感知训练,去除量化感知训练配置。

量化配置文件

如果通过create_quant_retrain_config接口生成的config.json量化感知训练配置文件,推理精度不满足要求,则需要参见该章节不断调整config.json文件中的内容,直至精度满足要求,该文件部分内容样例请参见接口中的调用示例部分(用户修改json文件时,请确保层名唯一)。

配置文件中参数说明如下,其中表8~表10的参数说明在手动调整量化配置文件时才会使用。

表 1 version参数说明

作用 |

控制量化配置文件版本号。 |

|---|---|

类型 |

int |

取值范围 |

1 |

参数说明 |

目前仅有一个版本号1。 |

推荐配置 |

1 |

必选或可选 |

可选 |

表 2 batch_num参数说明

作用 |

控制量化感知训练推理阶段使用多少个batch的数据。 |

|---|---|

类型 |

int |

取值范围 |

大于0 |

参数说明 |

如果不配置,则使用默认值1,建议校准集图片数量不超过50张,根据batch的大小batch_size计算相应的batch_num数值。 batch_num*batch_size为量化使用的校准集图片数量。 其中batch_size为每个batch所用的图片数量。 |

推荐配置 |

1 |

必选或可选 |

可选 |

表 3 retrain_enable参数说明

作用 |

该层是否进行量化感知训练。 |

|---|---|

类型 |

bool |

取值范围 |

true或false |

参数说明 |

|

推荐配置 |

true |

必选或可选 |

可选 |

表 4 retrain_data_config参数说明

作用 |

该层数据量化配置。 |

|---|---|

类型 |

object |

取值范围 |

- |

参数说明 |

包含如下参数:

|

推荐配置 |

- |

必选或可选 |

可选 |

表 5 retrain_weight_config参数说明

作用 |

该层权重量化配置。 |

|---|---|

类型 |

object |

取值范围 |

- |

参数说明 |

包含如下参数:

|

推荐配置 |

- |

必选或可选 |

可选 |

表 6 algo参数说明

作用 |

该层选择使用的量化算法。 |

|---|---|

类型 |

object |

取值范围 |

- |

参数说明 |

|

推荐配置 |

数据量化使用ulq_quantize,权重量化使用arq_retrain。 |

必选或可选 |

可选 |

表 7 channel_wise参数说明

作用 |

是否对每个channel采用不同的量化因子。 |

|---|---|

类型 |

bool |

取值范围 |

true或false |

参数说明 |

|

推荐配置 |

true |

必选或可选 |

可选 |

表 8 fixed_min参数说明

作用 |

设置数据量化算法下限的开关。 |

|---|---|

类型 |

bool |

取值范围 |

true或false |

参数说明 |

如果不选此项,AMCT根据图的结构自动设置。 如果选择此项,并且网络模型量化层的前一层是relu层,则该参数需要手动设置为true,如果为非relu层,则要手动设置为false。 |

推荐配置 |

不选此项 |

必选或可选 |

可选 |

表 9 clip_max参数说明

作用 |

数据量化算法上限。 |

|---|---|

类型 |

float |

取值范围 |

clip_max>0 根据不同层activation的数据分布找到最大值max,推荐取值范围为:0.3*max~1.7*max |

参数说明 |

截断上下限数据量化算法,如果选择此项则固定算法截断上限。如果不选此项,通过ifmr算法学习获取上限。 |

推荐配置 |

不选此项 |

必选或可选 |

可选 |

表 10 clip_min参数说明

作用 |

数据量化算法下限。 |

|---|---|

类型 |

float |

取值范围 |

clip_min<0 根据不同层activation的数据分布找到最小值min,推荐取值范围为:0.3*min~1.7*min |

参数说明 |

截断上下限数据量化算法,如果选择此项则固定算法截断下限。如果不选此项,通过ifmr算法学习获取下限。 |

推荐配置 |

不选此项 |

必选或可选 |

可选 |

表 11 dst_type参数说明

作用 |

量化位宽的类型。 |

|---|---|

类型 |

string |

取值范围 |

INT8或INT4,默认为INT8。当前版本仅支持INT8量化。 |

参数说明 |

量化时用于选择是INT8量化还是INT4量化。 |

推荐配置 |

- |

必选或可选 |

可选 |

稀疏(不支持)¶

通道稀疏¶

自动通道稀疏搜索¶

当前通道稀疏支持对不同的层做不同稀疏率的稀疏处理,但逐层设置稀疏率对用户的使用门槛较高,对于某一层,如何选择稀疏率(即配置中的prune_ratio)是比较困难的,手工尝试的配置需要进行重训练,耗费时间多。针对上述问题,引入自动通道稀疏搜索特性,根据用户模型来计算各通道的稀疏敏感度(影响精度)以及稀疏收益(影响性能),然后搜索策略依据稀疏敏感度和稀疏收益来搜索最优的逐层通道稀疏率,以平衡精度和性能。 介绍自动通道稀疏搜索特性的接口调用流程和调用示例。

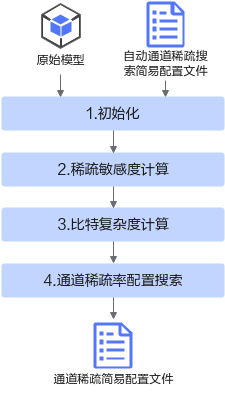

简介¶

当前通道稀疏支持对不同的层做不同稀疏率的稀疏处理,但逐层设置稀疏率对用户的使用门槛较高,对于某一层,如何选择稀疏率(即配置中的prune_ratio)是比较困难的,手工尝试的配置需要进行重训练,耗费时间多。针对上述问题,引入自动通道稀疏搜索特性,根据用户模型来计算各通道的稀疏敏感度(影响精度)以及稀疏收益(影响性能),然后搜索策略依据稀疏敏感度和稀疏收益来搜索最优的逐层通道稀疏率,以平衡精度和性能。

说明: 说明:当前版本该特性为试用特性,不支持应用于商用产品中。

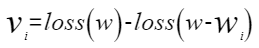

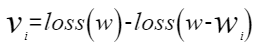

稀疏敏感度:稀疏敏感度定义为当前通道稀疏后对整网精度的影响估计,稀疏敏感度越大代表当前通道稀疏后整网精度损失越大,默认算法根据loss(w - wi)的泰勒展开计算通道稀疏敏感度。支持用户自定义计算方式。裁剪第i个通道后,稀疏敏感度计算公式如下:

采用近似估计的方法对loss(w - wi)进行泰勒展开,目前考虑到计算量只算一阶。

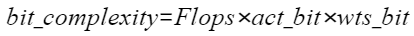

稀疏收益:当前通道的稀疏收益用比特复杂度表示,为计算量化Flops与计算比特位宽之积:

其中,Flops为浮点计算量,act_bit为数据的数据精度,wts_bit为权重的数据精度。

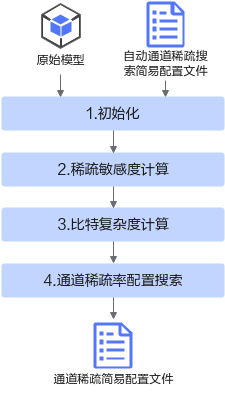

自动通道稀疏搜索流程如图1所示,支持稀疏的层以及规格请参见表1。

图 1 自动通道稀疏搜索流程

各流程简要说明如下:

初始化:初始化动作首先需要解析用户模型以及稀疏配置(可选),分析网络中可通道稀疏层及其对应的通道稀疏配置(是否有用户指定配置稀疏率),生成通道稀疏配置生成的搜索空间:解析用户目标压缩率配置。

搜索空间:为支持通道稀疏的层,但是没有通过override_layer_configs或者override_layer_types配置稀疏率。

压缩率:定义为原模型比特复杂度与稀疏后模型比特复杂度之比。

敏感度计算:计算每个通道的稀疏敏感度,内置基于损失估计的敏感度计算方法,使用泰勒展开的一次项估计裁剪该通道后网络loss的变化;支持用户自定义敏感度计算方法。

比特复杂度计算:计算每个通道的比特复杂度,视为通道的稀疏收益。

通道稀疏率配置搜索:默认采用自动通道稀疏搜索算法,搜索满足用户指定压缩率的最优通道稀疏率配置;支持用户自定义求解器。

说明:

自动通道稀疏搜索特性只是生成通道稀疏的简易配置文件,若想得到最终稀疏后模型,还需要进行手工稀疏,将上述生成的简易配置文件作为入参传入通道稀疏。

说明:

自动通道稀疏搜索特性只是生成通道稀疏的简易配置文件,若想得到最终稀疏后模型,还需要进行手工稀疏,将上述生成的简易配置文件作为入参传入通道稀疏。

搜索流程¶

介绍自动通道稀疏搜索特性的接口调用流程和调用示例。

接口调用流程

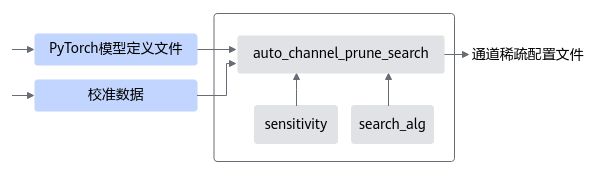

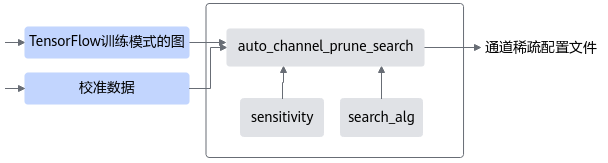

接口调用流程如图1所示,蓝色部分为用户实现,灰色部分为用户调用AMCT提供的API实现。稀疏示例请参见样例列表。

用户准备好PyTorch的模型、自动通道稀疏搜索配置文件,调用auto_channel_prune_search,根据压缩率、各通道的稀疏敏感度以及稀疏收益,执行自动通道稀疏搜索,得到可用作通道稀疏的简易配置文件。其中,sensitivity模块与search_alg模块用户可以自定义或者使用接口内部默认方法。

sensitivity模块实现计算各通道的稀疏敏感度。

search_alg模块实现了基于通道敏感度与通道稀疏收益进行稀疏通道搜索的过程。

图 1 调用流程

调用示例

本示例演示了使用AMCT进行自动通道稀疏搜索的流程,该过程需要用户传入PyTorch模型与校准数据,用户可选择自定义实现sensitivity模块与search_alg模块。

说明:

如下示例标有“由用户补充处理”的步骤,需要用户根据自己的模型和数据集进行补充处理,示例中仅为示例代码。

如下示例调用AMCT的部分,函数入参请根据实际情况进行调整。

导入AMCT包,并通过安装后处理>AMCT(PyTorch)中的环境变量设置日志级别。

import amct_pytorch as amct(可选,由用户补充处理)实现sensitivity模块,获取各个layer各通道的敏感度,为后续的搜索算法提供数据。可参考系统默认sensitivity模块:AMCT安装目录

amct_pytorch/auto_channel_prune_search.py下的TaylorLossSensitivity方法,简要流程如下:

from amct.common.auto_channel_prune.sensitivity_base import SensitivityBase class Sensitivity(SensitivityBase) def __init__(self) pass def setup_initialization(self, graph_tuple, input_data, test_iteration): # 必要的初始化 # graph_tuple (graph, graph_info) pass def get_sensitivity(self, search_records): # 获取敏感度方法,计算后写到record中 pass

(可选,由用户补充处理)实现搜索算法search_alg模块,需要用户实现channel_prune_search回调接口,根据通道敏感度与通道稀疏收益进行稀疏通道搜索。可参考系统默认search_alg模块:AMCT安装目录/amct_pytorch/common/auto_prune/search_channel_base.py文件中GreedySearch方法。

from amct.common.auto_prune.search_channel_base import SearchChannelBase class Search(SearchChannelBase) def __init__(self) # 初始化 pass def channel_prune_search(self, graph_info, search_records, prune_config): """ 输入: graph_info: dict,包含图中各算子的通道数量与比特复杂度信息,可用于计算压缩率 search_records: protobuf对象,包含待搜索的可稀疏层 prune_config: 三元组-目标压缩率(float)、昇腾亲和优化开关(bool)、单层最大稀疏率(float) 输出: dict,key为待搜索的可稀疏层层名,value为01组成的list,对应该通道是否应稀疏 """ pass

(可选,由用户补充处理)获取PyTorch模型,在环境下推理,验证环境、推理脚本是否正常。执行该步骤时,可以使用部分测试集,减少运行时间。

ori_model.load() # 测试模型 user_test_model(ori_model, test_data, test_iterations)

(由用户补充处理)构造校准数据。

input_data = [] for _ in range(test_iteration): input_data.append(user_load_feed_dict())

调用AMCT,进行自动通道稀疏搜索。

output_prune_cfg = './prune.cfg' amct.auto_channel_prune_search( model=model, config=cfg_file, input_data=input_data, output_cfg=output_prune_cfg, sensitivity='TaylorLossSensitivity', search_alg='GreedySearch')

手工稀疏¶

本节介绍手工稀疏特性支持的稀疏层,接口调用流程和调用示例。 稀疏后,如果精度不满足要求,可以参见本节提供的方法进行调优。

稀疏流程¶

本节介绍手工稀疏特性支持的稀疏层,接口调用流程和调用示例。

AMCT目前主要支持基于重训练的通道稀疏模型压缩特性,稀疏示例请参见样例列表>通道稀疏,支持通道稀疏的层以及约束如下:

表 1 通道稀疏支持的层以及约束

优化方式 |

支持的层类型 |

约束 |

|---|---|---|

通道稀疏 |

torch.nn.Linear:全连接层 |

复用层(共用weight和bias参数)不支持稀疏。 |

torch.nn.Conv2d:卷积层 |

|

接口调用流程

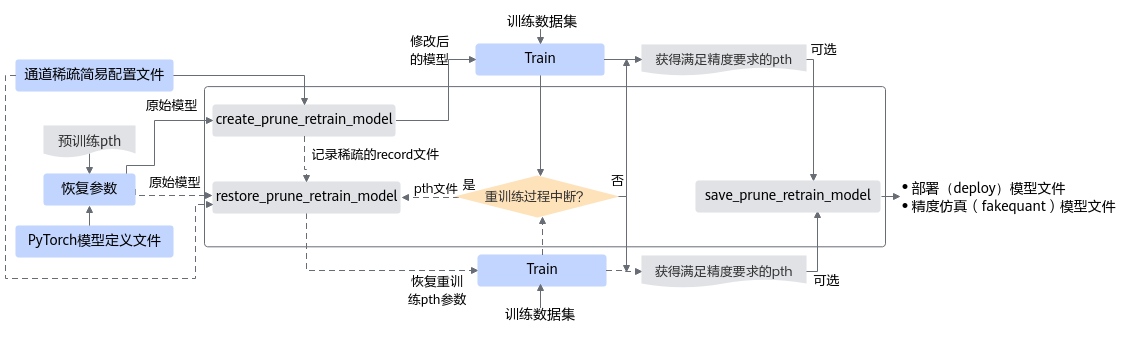

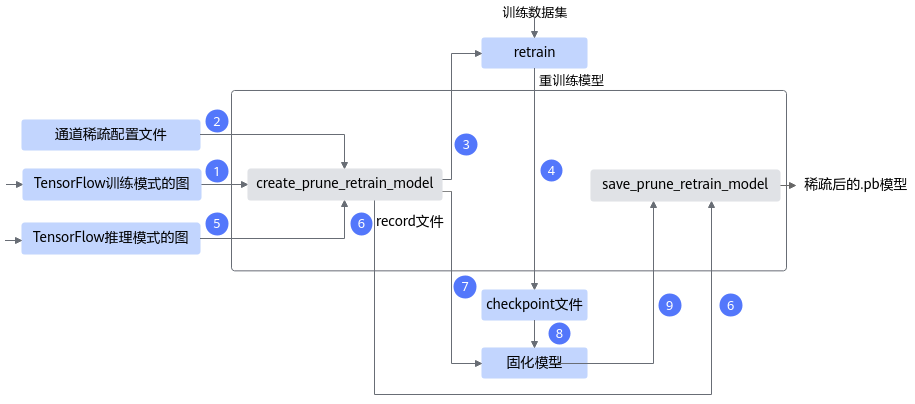

通道稀疏功能接口调用流程如下图所示,如下流程中的训练环境借助PyTorch框架的CPU/GPU环境,在该开源框架的推理脚本基础上,调用AMCT API完成模型压缩,压缩后的部署模型需要使用ATC工具转换成适配NPU IP加速器的离线模型后,然后才能在NPU IP加速器上实现推理:

图 1 通道稀疏接口调用流程

蓝色部分为用户实现,灰色部分为用户调用AMCT提供的API实现:

用户首先构造PyTorch的原始模型,调用create_prune_retrain_model接口对原始模型进行修改,在图结构中插入通道稀疏mask算子,修改后的模型参数量被裁剪。

对修改后的模型进行训练,直至精度满足要求;如果训练过程中断,则可基于原始模型和记录稀疏信息的文件,重新调用restore_prune_retrain_model接口稀疏模型,继续进行量化感知的训练,直至精度满足要求。

根据最终的重训练好的通道稀疏模型,生成满足精度要求的pth文件;或者调用save_prune_retrain_model接口,生成最终ONNX仿真模型以及部署模型。

调用示例

说明:

如下示例标有“由用户补充处理”的步骤,需要用户根据自己的模型和数据集进行补充处理,示例中仅为示例代码。

调用AMCT的部分,函数入参可以根据实际情况进行调整。稀疏基于用户的训练过程,请确保已经有基于PyTorch环境进行训练的脚本,并且训练后的精度正常。

导入AMCT包,并通过安装后处理>AMCT(PyTorch)中的环境变量设置日志级别。

import amct_pytorch as amct(可选,由用户补充处理)建议使用原始待稀疏的模型和测试集,在PyTorch环境下推理,验证环境、推理脚本是否正常。

推荐执行该步骤,请确保原始模型可以完成推理且精度正常;执行该步骤时,可以使用部分测试集,减少运行时间。

ori_model.load() # 测试模型 user_test_model(ori_model, test_data, test_iterations)

调用AMCT,执行带稀疏算子的训练流程。

对原始模型进行修改,在图结构中插入通道稀疏mask算子。

实现该步骤前,应先恢复训练好的参数,如2中的ori_model.load()。

simple_cfg = './retrain.cfg' record_file = './tmp/record.txt' prune_retrain_model = amct.create_prune_retrain_model(model=ori_model, input_data=ori_model_input_data, config_defination=simple_cfg, record_file=record_file)

(由用户补充处理)使用修改后的图,创建反向梯度,在训练集上做训练。

使用修改后的图,创建反向梯度。

该步骤需要在稀疏模型后执行。

optimizer = user_create_optimizer(prune_retrain_model)从训练好的checkpoint恢复模型,并训练模型。

注意:从训练好的checkpoint恢复模型参数后再训练。

quant_pth = './ckpt/user_model' user_train_model(optimizer, prune_retrain_model, train_data)

(可选)如果调用save_prune_retrain_model接口,则需要参考该步骤,如果保存为pth文件则不需要。

保存模型,实现通道稀疏。

prune_retrain_model = amct.save_prune_retrain_model( model=pruned_retrain_model, save_path=save_path, input_data=input_data)

(由用户补充处理)基于ONNX Runtime的环境,使用通道稀疏后模型(prune_retrain_model)在测试集(test_data)上做推理,测试量化后仿真模型的精度。

使用稀疏后仿真模型精度与2中的原始精度做对比,可以观察通道稀疏对精度的影响。

prune_retrain_model = './results/user_model_fake_prune_model.onnx' user_do_inference_onnx(prune_retrain_model, test_data, test_iterations)

如果训练过程中断,需要从ckpt中恢复数据,继续训练,则调用流程为:

导入AMCT包,并通过安装后处理>AMCT(PyTorch)中的环境变量设置日志级别。

import amct_pytorch as amct准备原始模型。

ori_model= user_create_model()调用AMCT,恢复量化训练流程。

修改模型,在图结构中插入通道稀疏mask算子,保存为新的prune_model。

model = ori_model input_data = ori_model_input_data record_file = './tmp/record.txt' config_defination = './prune_cfg.cfg' save_pth_path = /your/path/to/save/tmp.pth model.load_state_dict(torch.load(state_dict_path)) prune_retrain_model = amct.restore_prune_retrain_model(model=ori_model, input_data=ori_model_input_data, record_file=record_file, config_defination='./prune_cfg.cfg', save_pth_path=/your/path/to/save/tmp.pth, 'state_dict')

(由用户补充处理)使用修改后的模型,恢复断点,创建反向梯度,在训练集上做训练。

从稀疏后训练中断的checkpoint恢复模型参数。

quant_pth = './ckpt/user_prune_model' user_train_model(optimizer, prune_retrain_model, train_data)

使用修改后的图,创建反向梯度。

该步骤需要在恢复模型参数后执行。

optimizer = user_create_optimizer(prune_retrain_model)从训练好的checkpoint恢复模型,并训练模型。

注意:从训练好的checkpoint恢复模型参数后再训练。

user_train_model(optimizer, prune_retrain_model, train_data)

(可选)如果调用save_prune_retrain_model接口,则需要参考该步骤,如果保存为pth文件则不需要。

保存模型,实现通道稀疏。

prune_retrain_model = amct.save_prune_retrain_model( model=pruned_retrain_model, save_path=save_path, input_data=input_data)

(由用户补充处理)基于ONNX Runtime的环境,使用通道稀疏后模型(prune_retrain_model)在测试集(test_data)上做推理,测试量化后仿真模型的精度。

使用稀疏后仿真模型精度与2中的原始精度做对比,可以观察通道稀疏对精度的影响。

prune_retrain_model = './results/user_model_fake_prune_model.onnx' user_do_inference_onnx(prune_retrain_model, test_data, test_iterations)

后续处理

如果稀疏后输出的模型为pth格式,则需要参考该章节,如果调用save_prune_retrain_model接口,则不需要。

由于输出的pth模型无法直接用于推理,需要用户自行将pth模型转成ONNX网络模型,或者调用save_prune_retrain_model接口保存为最终ONNX仿真模型以及部署模型,然后才能使用ATC工具进行模型转换。调用save_prune_retrain_model接口的调用示例如下:

prune_retrain_model = amct.10.6.3-save_prune_retrain_model(

model=pruned_retrain_model,

save_path=save_path,

input_data=input_data)

手工调优¶

稀疏后,如果精度不满足要求,可以参见本节提供的方法进行调优。

如果按照某组配置稀疏模型后,经过重训练精度未满足要求,则可以修改简易配置文件(文件配置请参见量化感知训练简易配置文件)重新稀疏模型并重训练。常用的方法包括:

调整稀疏率,由简易配置文件中的prune_ratio参数控制,用户可尝试减小稀疏率并重新进行稀疏来进行调试。

某些层不做稀疏,由简易配置文件中的regular_prune_skip_layers参数控制,通过该参数配置不需要稀疏的层。

4选2结构化稀疏¶

本节介绍4选2结构化稀疏支持的层,接口调用流程和调用示例。 稀疏后,如果精度不满足要求,可以参见本节提供的方法进行调优。

稀疏流程¶

本节介绍4选2结构化稀疏支持的层,接口调用流程和调用示例。

由于硬件约束,该芯片不支持4选2结构化稀疏特性:使能后获取不到性能收益。

AMCT支持基于重训练的4选2结构化稀疏特性。该特性支持的层以及约束如下,稀疏示例请参见样例列表。

表 1 支持的层以及约束

优化方式 |

支持的层类型 |

约束 |

|---|---|---|

4选2结构化稀疏 |

torch.nn.Linear:全连接层 |

复用层(共用weight)不支持稀疏。 |

torch.nn.Conv2d:卷积层 |

|

|

torch.nn.ConvTranspose2d:反卷积层 |

|

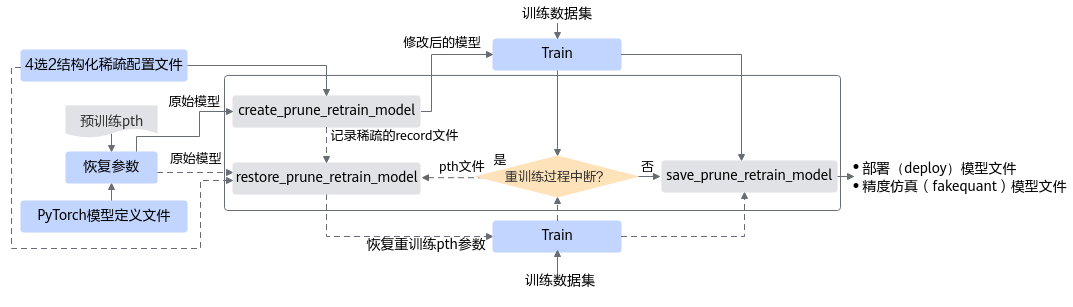

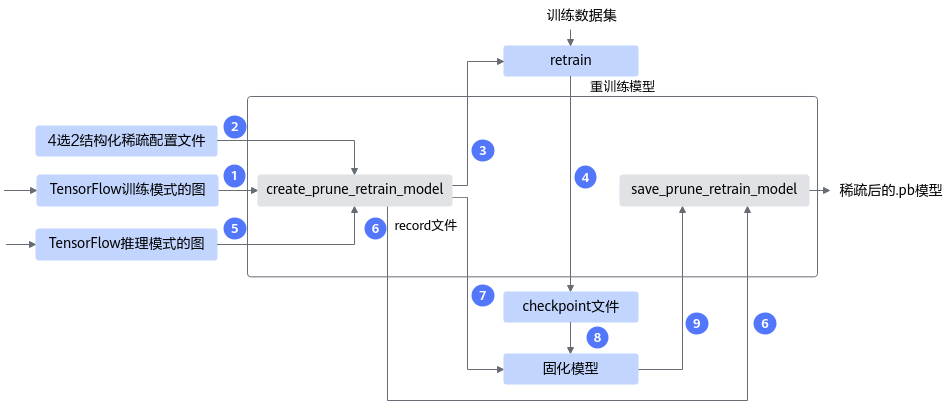

接口调用流程

4选2结构化稀疏功能接口调用流程如下图所示,如下流程中的训练环境借助PyTorch框架的CPU/GPU环境,在该开源框架的推理脚本基础上,调用AMCT API完成模型压缩,压缩后的部署模型需要使用ATC工具转换成适配NPU IP加速器的离线模型后,然后才能在NPU IP加速器上实现推理:

图 1 4选2结构化稀疏接口调用流程

蓝色部分为用户实现,灰色部分为用户调用AMCT提供的API实现:

用户首先构造PyTorch的原始模型,调用create_prune_retrain_model接口对原始模型进行修改,把待稀疏的算子替换成插入了4选2结构化稀疏的算子。

对修改后的模型进行训练,直至精度满足要求;如果训练过程中断,则可基于原始模型和记录稀疏信息的文件,重新调用restore_prune_retrain_model接口稀疏模型,继续进行量化感知的训练,直至精度满足要求。

根据用户最终的重训练好的4选2结构化稀疏模型,调用save_prune_retrain_model接口,还原替换的算子并对weight进行稀疏,生成最终ONNX仿真模型以及部署模型。

调用示例

说明:

如下示例标有“由用户补充处理”的步骤,需要用户根据自己的模型和数据集进行补充处理,示例中仅为示例代码。

调用AMCT的部分,函数入参可以根据实际情况进行调整。稀疏基于用户的训练过程,请确保已经有基于PyTorch环境进行训练的脚本,并且训练后的精度正常。

(可选,由用户补充处理)建议使用原始待量化的模型和测试集,在PyTorch环境下推理,验证环境、推理脚本是否正常。

推荐执行该步骤,请确保原始模型可以完成推理且精度正常;执行该步骤时,可以使用部分测试集,减少运行时间。

ori_model.load() # 测试模型 user_test_model(ori_model, test_data, test_iterations)

调用AMCT,执行4选2结构化稀疏流程。

对原始模型进行修改,把待稀疏的算子替换成插入了4选2结构化稀疏的算子。

实现该步骤前,应先恢复训练好的参数,如1中的ori_model.load()。

simple_cfg = './retrain.cfg' record_file = './tmp/record.txt' prune_retrain_model = amct.create_prune_retrain_model(model=ori_model, input_data=ori_model_input_data, config_defination=simple_cfg, record_file=record_file)

(由用户补充处理)使用修改后的图,创建反向梯度,在训练集上做训练。

使用修改后的图,创建反向梯度。

该步骤需要在稀疏模型后执行。

optimizer = user_create_optimizer(prune_retrain_model)从训练好的checkpoint恢复模型,并训练模型。

注意:从训练好的checkpoint恢复模型参数后再训练。

quant_pth = './ckpt/user_model' user_train_model(optimizer, prune_retrain_model, train_data)

调用save_prune_retrain_model接口,保存模型,还原替换的算子并对weight进行结构化稀疏,生成最终ONNX仿真模型以及部署模型。

prune_retrain_model = amct.save_prune_retrain_model( model=pruned_retrain_model, save_path=save_path, input_data=input_data)

(可选,由用户补充处理)基于ONNX Runtime的环境,使用稀疏后模型(prune_retrain_model)在测试集(test_data)上做推理,测试量化后仿真模型的精度。

使用稀疏后仿真模型精度与1中的原始精度做对比,可以观察4选2结构化稀疏对精度的影响。

prune_retrain_model = './results/user_model_fake_prune_model.onnx' user_do_inference_onnx(prune_retrain_model, test_data, test_iterations)

如果训练过程中断,需要从ckpt中恢复数据,继续训练,则调用流程为:

准备原始模型。

ori_model= user_create_model()调用AMCT,恢复量化训练流程。

修改模型,把待稀疏的算子替换成插入了4选2结构化稀疏的算子,保存为新的prune_model。

model = ori_model input_data = ori_model_input_data record_file = './tmp/record.txt' config_defination = './prune_cfg.cfg' save_pth_path = /your/path/to/save/tmp.pth model.load_state_dict(torch.load(state_dict_path)) prune_retrain_model = amct.restore_prune_retrain_model(model=ori_model, input_data=ori_model_input_data, record_file=record_file, config_defination='./prune_cfg.cfg', save_pth_path=/your/path/to/save/tmp.pth, 'state_dict')

(由用户补充处理)使用修改后的模型,恢复断点,创建反向梯度,在训练集上做训练。

从稀疏后训练中断的checkpoint恢复模型参数。

quant_pth = './ckpt/user_prune_model' user_train_model(optimizer, prune_retrain_model, train_data)

使用修改后的图,创建反向梯度。

该步骤需要在恢复模型参数后执行。

optimizer = user_create_optimizer(prune_retrain_model)从训练好的checkpoint恢复模型,并训练模型。

注意:从训练好的checkpoint恢复模型参数后再训练。

user_train_model(optimizer, prune_retrain_model, train_data)

调用save_prune_retrain_model接口,保存模型,还原替换的算子并对weight进行结构化稀疏,生成最终ONNX仿真模型以及部署模型。

prune_retrain_model = amct.save_prune_retrain_model( model=pruned_retrain_model, save_path=save_path, input_data=input_data)

(可选,由用户补充处理)基于ONNX Runtime的环境,使用稀疏后模型(prune_retrain_model)在测试集(test_data)上做推理,测试量化后仿真模型的精度。

使用稀疏后仿真模型精度与1中的原始精度做对比,可以观察4选2结构化稀疏对精度的影响。

prune_retrain_model = './results/user_model_fake_prune_model.onnx' user_do_inference_onnx(prune_retrain_model, test_data, test_iterations)

手工调优¶

稀疏后,如果精度不满足要求,可以参见本节提供的方法进行调优。

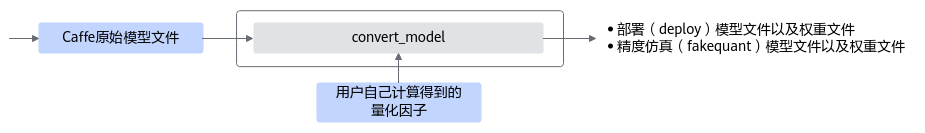

如果按照某组配置稀疏模型后,经过重训练精度未满足要求,则可以修改简易配置文件(文件配置请参见量化感知训练简易配置文件)重新稀疏模型并重训练。常用的方法包括: