学习向导¶

本文档用于指导开发者如何使用ATC(Ascend Tensor Compiler,简称ATC)工具进行模型转换,得到适配NPU IP加速器的离线模型。通过本文档您可以达成以下目标:

了解不同框架原始网络模型转成NPU IP加速器离线模型的方法。

能够基于本文档中的参数,转成满足不同定制要求的离线模型。

熟悉Linux基本命令,对机器学习、深度学习有一定了解的人员,可以更好地理解本文档。

针对新手

快速入门 |

ATC简介 |

初级功能 |

|---|---|---|

本章节以ATC工具支持的所有框架网络模型为例,简单介绍如何进行基础功能的模型转换。 |

介绍ATC工具功能架构、运行流程以及关键概念。 |

介绍ATC工具的初级功能,比如将模型转成JSON文件查看参数信息,离线模型支持动态BatchSize、动态分辨率,以及如何组合各种ATC参数转换成满足要求的离线模型等。 |

适合专家

AIPP使能(该版本不支持AIPP特性) |

单算子模型转换(该版本不支持单算子特性) |

专题 |

|---|---|---|

介绍什么是AIPP、模型转换时如何使能AIPP、根据配置文件模板如何构造AIPP配置文件,以及根据色域转换功能如何输出满足要求的图片数据等功能,并给出典型场景下的配置示例。IPV350不支持该特性。 |

介绍什么是单算子描述文件、如何构造单算子描述文件,以及如何将该文件转成适配NPU IP加速器的离线模型,用于验证单算子功能。IPV350不支持该特性。 |

介绍Caffe、TensorFlow等模型在某些无法直接使用ATC工具的场景,如何通过定制修改模型,来实现顺利使用ATC工具的功能。IPV350不支持该特性。 |

ATC简介¶

介绍ATC工具的功能架构以及使用ATC工具过程中遇到的一些术语或者缩略语。 ATC工具运行前需要准备环境和模型,本节给出ATC工具的运行流程以及和各组件的交互流程。

ATC工具介绍¶

介绍ATC工具的功能架构以及使用ATC工具过程中遇到的一些术语或者缩略语。

ATC简介

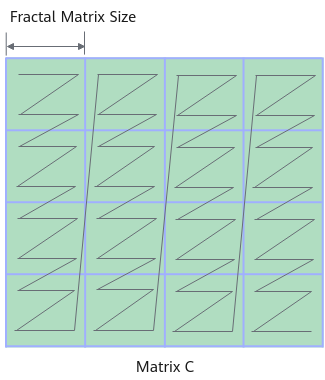

昇腾张量编译器(Ascend Tensor Compiler,简称ATC)是异构计算架构CANN体系下的模型转换工具,它可以将开源框架的网络模型以及Ascend IR定义的单算子描述文件(JSON格式)转换为NPU IP加速器支持的.om/exeom(IPV350)格式离线模型。其功能架构如图1所示。

模型转换过程中,ATC会进行算子调度优化、权重数据重排、内存使用优化等具体操作,对原始的深度学习模型进行进一步的调优,从而满足部署场景下的高性能需求,使其能够高效执行在NPU IP加速器上。

图 1 ATC工具功能架构

其中:

开源框架网络模型场景:

开源框架网络模型经过Parser解析后,转换为中间态IR Graph。

中间态IR经过图准备、图拆分、图优化、图编译等一系列操作后,转成适配NPU IP加速器的离线模型(此处图指网络模型拓扑图)。

转换后的离线模型上传到板端环境,通过AscendCL接口加载模型文件实现推理过程,详细流程请参见《AscendCL应用开发指南 (C&C++)》中的“模型管理”章节。

单算子描述文件场景:(该版本不支持单算子特性)

Ascend IR定义的单算子描述文件(JSON格式)通过ATC工具进行单算子编译后,转成适配NPU IP加速器的单算子离线模型,然后上传到板端环境,通过AscendCL接口加载单算子模型文件用于验证单算子功能,详细流程请参见《AscendCL应用开发指南 (C&C++)》中的“单算子调用 > 单算子模型执行”章节。

关于单算子描述文件的详细配置说明请参见单算子模型转换(该版本不支持单算子特性)章节。

关键概念

表 1 概念介绍

概念 |

描述 |

|---|---|

GE |

Graph Engine,图引擎,是计算图编译和运行的控制中心,提供图优化、图编译管理以及图执行控制等功能。GE通过统一的图开发接口提供多种AI框架的支持,不同AI框架的计算图可以实现到Ascend图的转换。原图优化时,GE内部会进行整图优化。 |

YUV420SP |

有损图像颜色编码格式,常用为YUV420SP_UV、YUV420SP_VU两种格式。 |

数据排布格式(Format) |

Format为数据的物理排布格式,定义了解读数据的维度,比如1D、2D、3D、4D、5D等。 |

NCHW和NHWC |

在深度学习框架中,多维数据通过多维数组存储,比如卷积神经网络的特征图(Feature Map)通常用四维数组保存,即4D,4D格式解释如下:

由于数据只能线性存储,因此这四个维度有对应的顺序。不同深度学习框架会按照不同的顺序存储特征图数据,比如TensorFlow中,排列顺序为[Batch, Height, Width, Channels],即NHWC。 如图2所示,以一张格式为RGB的图片为例,NCHW中,C排列在外层,每个通道内,像素紧挨在一起,实际存储的是“RRRRRRGGGGGGBBBBBB”,即同一通道的所有像素值顺序存储在一起;而NHWC中C排列在最内层,每个通道内,像素间隔挨在一起,实际存储的则是“RGBRGBRGBRGBRGBRGB”,即多个通道的同一位置的像素值顺序存储在一起。 图1 NCHW和NHWC

|

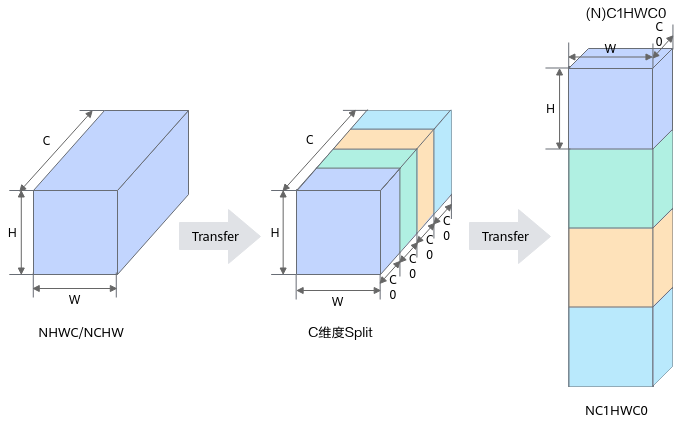

NC1HWC0 |

NPU IP加速器中,为了提高通用矩阵乘法(GEMM)运算数据块的访问效率,所有张量数据统一采用NC1HWC0的五维数据格式。 其中C0与微架构强相关,是一个矩阵单元处理单边数据量,一个矩阵单元处理32B*32B的数据,单边是32B;例如数据类型为float16(2字节)时,C0=32/2=16,数据类型为float32(4字节)时,C0=32/4=8。 C1=(C+C0-1)/C0,如果结果不整除,向下取整。 NHWC/NCHW -> NC1HWC0的转换过程为:将数据在C维度进行分割,变成C1份NHWC0/NC0HW,再将C1份NHWC0/NC0HW在内存中连续排列成NC1HWC0,其格式转换示意图如下图所示。 图2 NC1HWC0

|

FRACTAL_Z |

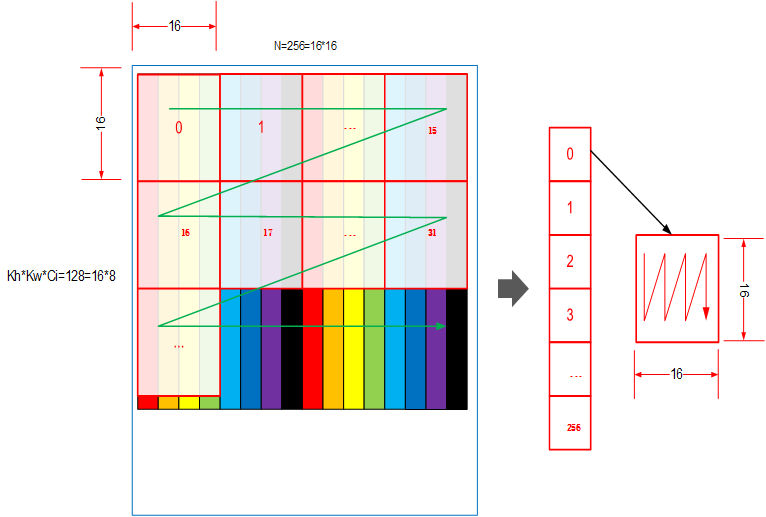

FRACTAL_Z是用于定义卷积权重的数据格式,由FT Matrix(FT:Filter,卷积核)变换得到。FRACTAL_Z是送往Cube的最终数据格式,采用“C1HW,N1,N0,C0”的4维数据排布。 数据有两层Tiling,如下图所示:

第一层与Cube的Size相关,数据按照列的方向连续(小n);第二层与矩阵的Size相关,数据按照行的方向连续(大Z)。 例如:HWCN = (2, 2, 32, 32),将其变成FRACTAL_Z( C1HW, N1, N0, C0 ) = (8, 2, 16, 16)。 HWCN变换FRACTAL_Z的过程为: Tensor.padding([ [0,0], [0,0], [0,(C0–C%C0)%C0], [0,(N0–N%N0)%N0] ]).reshape( [H, W, C1, C0, N1, N0]).transpose( [2, 0, 1, 4, 5, 3] ).reshape( [C1*H*W, N1, N0, C0]) NCHW变换FRACTAL_Z的过程为: Tensor.padding([ [0,(N0–N%N0)%N0], [0,(C0–C%C0)%C0], [0,0], [0,0] ]).reshape( [N1, N0, C1, C0, H, W,]).transpose( [2, 4, 5, 0, 1, 3] ).reshape( [C1*H*W, N1, N0, C0]) |

FRACTAL_NZ |

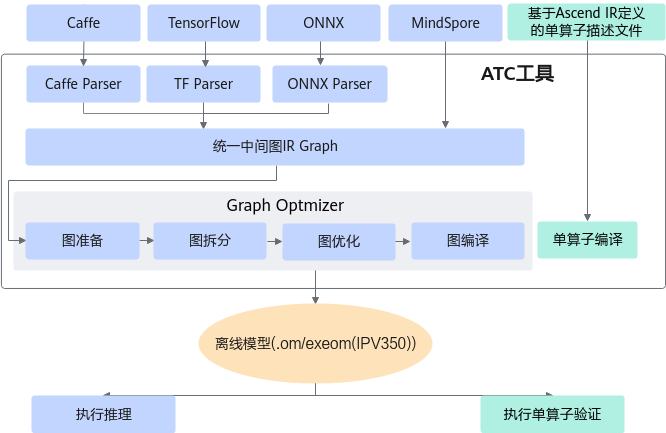

FRACTAL_NZ是分形格式,如Feature Map的数据存储,在cube单元计算时,输出矩阵的数据格式为NW1H1H0W0。整个矩阵被分为(H1*W1)个分形,按照column major排布,形状如N字形;每个分形内部有(H0*W0)个元素,按照row major排布,形状如z字形。考虑到数据排布格式,将NW1H1H0W0数据格式称为Nz(大N小z)格式。其中,H0,W0表示一个分形的大小,示意图如下所示:

ND –> FRACTAL_NZ的变换过程为: (..., N, H, W )->pad->(..., N, H1*H0, W1*W0)->reshape->(..., N, H1, H0, W1, W0)->transpose->(..., N, W1, H1, H0, W0) |

知识库 |

知识库是算子调优时,经过上板验证,获得算子真实性能后,存储的调优后的策略,方便后续算子编译中直接使用。 |

调用流程¶

ATC工具运行前需要准备环境和模型,本节给出ATC工具的运行流程以及和各组件的交互流程。

运行流程

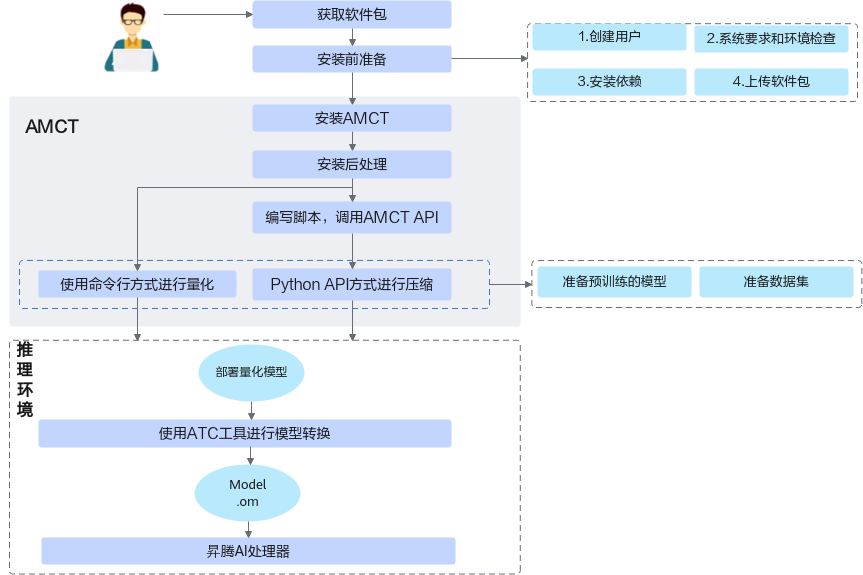

运行流程如图1所示。

图 1 运行流程

使用ATC工具之前,请先在开发环境安装CANN软件包,获取相关路径下的ATC工具,然后设置环境变量,详细说明请参见准备环境。

准备要进行转换的模型,并上传到开发环境。

使用ATC工具进行模型转换,模型转换过程中使用的参数请参见参数说明。

模型转换交互流程

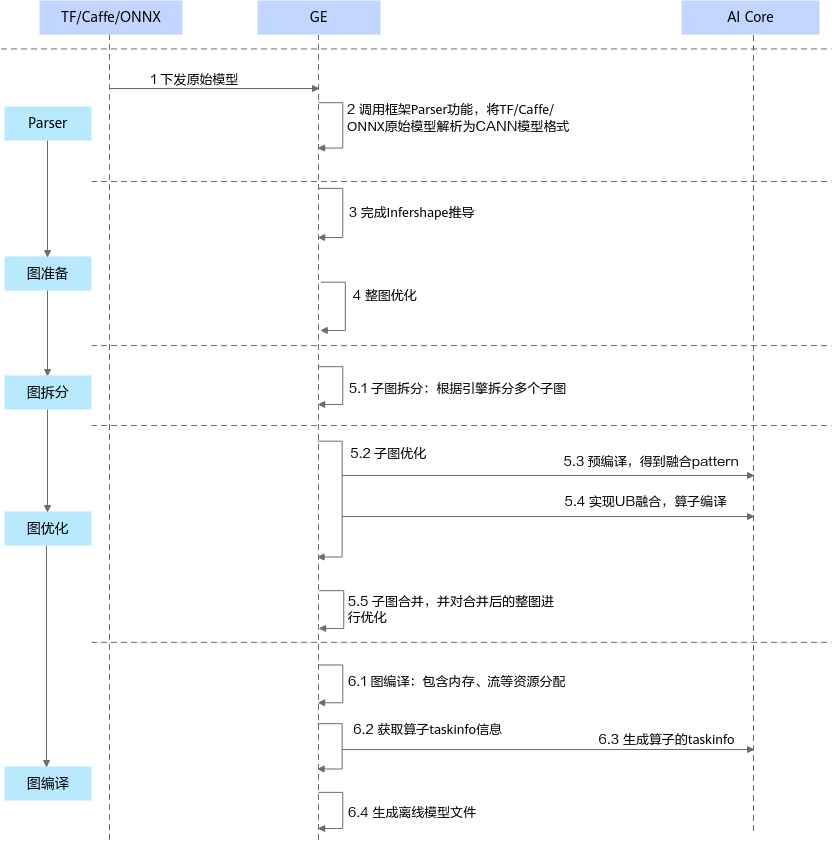

下面以开源框架网络模型转换为om离线模型为例,详细介绍模型转换过程中与周边模块的交互流程。

根据网络模型中算子计算单元的不同,分为AI Core算子和AI CPU算子:AI Core算子是指在NPU IP加速器的核心计算单元上执行的算子,而AI CPU算子则是在AI CPU计算单元上执行的算子。(该版本不支持AI CPU相关特性)

在AI Core算子、AI CPU算子的模型转换交互流程中,虽然都涉及图准备、图拆分、图优化、图编译等节点,但由于两者的计算单元不同,因此涉及交互的内部模块也有所不同,请参见下图。

关于算子类型、基本概念等详细介绍请参见《TBE&AI CPU算子开发指南》。如果用户使用的网络模型中有自定义算子,也请优先参见上述手册开发部署好自定义算子,模型转换时会优先去查找自定义算子库匹配模型文件中的算子;若匹配失败,则会去查找内置算子库。

AI Core算子模型转换交互流程

图 2 AI Core算子模型转换交互流程

调用框架Parser功能,将主流框架的模型格式转换成CANN模型格式。

图准备阶段:该阶段会完成原图优化以及Infershape推导(设置算子输出的shape和dtype)等功能。

图拆分阶段:GE(Graph Engine,图引擎)根据引擎拆分多个子图。

图优化阶段:GE将拆分后的子图进行优化,优化时按照当前子图流程对AI Core算子进行预编译和UB(Unified Buffer)融合,然后根据算子信息库中算子信息找到算子实现将其编译成算子kernel(算子的*.o与*.json),最后将优化后子图返回给GE。

优化后的子图合并为整图,再进行整图优化。

图编译阶段:GE进行图编译,包含内存分配、流资源分配等,图编译完成之后生成适配NPU IP加速器的离线模型文件(*.om/exeom(IPV350))。

准备环境¶

获取ATC工具

进行模型转换前,请先在开发环境安装CANN软件包,详情可参见《安装指南》,安装完成后,ATC工具安装在“${INSTALL_DIR}/bin”目录。其中,${INSTALL_DIR}请替换为CANN软件安装后文件存储路径。以root安装举例,安装后文件默认存储路径为:/usr/local/Ascend/latest。

设置环境变量

须知:

使用export方式设置环境变量后,环境变量只在当前窗口有效。

使用ATC工具进行模型转换的过程中,会自动将ATC工具所在位置“../python/site-packages”目录下算子编译依赖的Python库写入PYTHONPATH环境变量。 若算子实现时用户引入了上述依赖外的其他Python依赖,请自行添加PYTHONPATH的环境变量,配置引入的Python依赖所在路径,如下所示: export PYTHONPATH=xxxx:$PYTHONPATH

必选环境变量

设置公共环境变量

安装CANN软件后,使用CANN运行用户进行编译、运行时,需要以CANN运行用户登录环境,执行如下环境变量:

source ${INSTALL_DIR}/bin/setenv.bash其中,${INSTALL_DIR}请替换为CANN软件安装后文件存储路径。以root安装举例,安装后文件默认存储路径为:/usr/local/Ascend/latest。

设置Python相关环境变量

模型编译依赖Python,以Python3.7.5为例,请以CANN软件包运行用户执行如下命令设置Python3.7.5相关环境变量。

#如果用户环境存在多个python3版本,则指定使用python3.7.5版本 export PATH=/usr/local/python3.7.5/bin:$PATH #设置python3.7.5库文件路径 export LD_LIBRARY_PATH=/usr/local/python3.7.5/lib:$LD_LIBRARY_PATH

上述环境变量只在当前窗口生效,用户可以将上述命令写入~/.bashrc文件,使其永久生效,方法如下:

以安装用户在任意目录下执行vi ~/.bashrc,在该文件最后添加上述内容。

保存文件中,执行source ~/.bashrc使环境变量生效。

可选环境变量

日志落盘、打屏与重定向。

日志重定向:

如果不想日志落盘,而是重定向到文件,则模型转换前需要设置上述的日志打屏环境变量,并且atc命令需要设置--log参数(不能设置为null),样例如下:

atc xxx --log=debug >log.txt

开启算子并行编译功能。

若网络模型较大,模型转换过程中,可设置如下环境变量,开启算子的并行编译功能。

export TE_PARALLEL_COMPILER=xxTE_PARALLEL_COMPILER的值代表算子编译进程数(配置为整数),取值范围为1~32,默认值为8,当取值大于1时开启算子的并行编译功能。建议不超过:CPU核数*80%/NPU IP加速器个数(IPV350无NPU加速器,加速器个数默认值为1)。其中NPU IP加速器个数查询方法如下(IPV350不支持):

在安装NPU IP加速器的环境中执行“npu-smi info -l”命令,回显信息中的Total Count即为对应的个数。

打印模型转换过程中各阶段的图描述信息。

export DUMP_GE_GRAPH=1上述环境变量控制dump图的内容多少,取值如下:

1:包含连边关系和数据信息的全量dump。

2:不含有权重等数据的基本版dump。

3:只显示节点关系的精简版dump。

设置上述环境变量后,还可以设置如下环境变量,控制dump图的个数。

export DUMP_GRAPH_LEVEL=2此环境变量只有在DUMP_GE_GRAPH开启时才生效,并且默认为2;支持如下两种配置方式,两种方式均是控制图落盘的个数,用户可以按需使用,注意两种配置方式不支持混合使用:

配置数值,取值如下:

1:dump所有图。

2:dump除子图外的所有图。

3:dump最后的生成图,即经过GE(Graph Engine,图引擎)优化、编译后的图。

4:dump最早的生成图,即经过GE解析映射算子后,给到软件栈的编译入口图,此时图结构尚未经过GE的编译优化。

配置按照|分隔的字符串,配置如下:

例如配置为"aa|bb",则表示dump出名称包含aa和bb的图,aa和bb需要指定为图编译流程中的合法字符串,合法字符串的获取可以从全量的dump图得到。

设置上述环境变量后,在执行atc命令的当前路径会生成如下文件:

ge_onnx*.pbtxt:基于ONNX的模型描述结构,可以使用Netron等可视化软件打开。

ge_proto*.txt:protobuf格式存储的文本文件,该文件可以转成JSON格式文件方便用户定位问题。该文件与ge_onnx*.pbtxt一般成对出现,但是ge_proto*.txt比ge_onnx*.pbtxt文件会多string类型的属性信息,因此ge_proto*.txt显示的更完整,用户选择其中一种文件打开即可。

由于ge_proto*.txt文件结构相比ge_onnx*.pbtxt已经做了文件大小的优化,因此DUMP_GE_GRAPH环境变量设置为2或3,对ge_proto*.txt文件效果相同,都显示为不含有权重等数据的基本版dump。

上述每个文件对应模型编译过程中的一个步骤,每个文件中包括完成该步骤所涉及的所有算子,关于dump图的详细信息请参见dump图详细信息。

更多可选环境变量请参见《环境变量参考》。

快速入门¶

本章节以各框架下模型转换为例,演示如何快速转换一个离线模型。

须知:

版本兼容性说明:

低版本的CANN软件包环境上转换出的离线模型,支持在高版本的CANN软件包环境上运行,兼容4个版本周期。

动态shape场景(IPV350不支持):若用户使用6.0.1之前的CANN版本进行的模型转换,无法在6.0.1及之后CANN版本进行推理,需要使用6.0.1及之后匹配的CANN版本重新进行模型转换。如果用户想查看已有离线模型使用的ATC工具等基础版本信息,则请参见借助离线模型查看软件基础版本号(IPV350不支持)。

如果模型转换时,用户使用了设置网络模型精度参数--precision_mode或--precision_mode_v2:

上述两个参数默认都为性能优先,后续推理时可能会导致精度溢出问题。如果推理时出现精度问题,可以参见《AscendCL应用开发指南 (C&C++)》手册的“精度/性能优化 > 模型推理精度提升建议”进行定位。

如果用户聚焦精度问题,可以修改为其他取值,比如--precision_mode设置为must_keep_origin_dtype或--precision_mode_v2设置为origin。

开源框架的TensorFlow网络模型转换成离线模型(IPV350不支持)

获取TensorFlow网络模型。

单击Link,根据页面提示获取ResNet50网络的模型文件(*.pb),并以CANN软件包运行用户将获取的文件上传至开发环境任意目录,例如上传到$HOME_/module__/_目录下。

执行如下命令生成离线模型。(如下命令中使用的目录以及文件均为样例,请以实际为准)

atc --model=$HOME/module/resnet50_tensorflow*.pb --framework=3 --output=$HOME/module/out/tf_resnet50 --soc_version=<soc_version>--model:ResNet50网络模型文件所在路径。

--framework:原始框架类型,3表示TensorFlow。

--output:生成的离线模型路径。

--soc_version:NPU IP加速器的型号。

关于参数的详细解释请参见参数说明,请使用与芯片名相对应的_<soc_version>_取值进行模型转换,然后再进行推理,具体使用芯片查询方法请参见--soc_version。

若提示如下信息,则说明模型转换成功。

ATC run success, welcome to the next use.成功执行命令后,在--output参数指定的路径下,可查看离线模型(如:tf_resnet50.om)。

ONNX网络模型转换成离线模型

获取ONNX网络模型。

单击Link进入ModelZoo页面,查看README.md中“快速上手>模型推理”章节获取*.onnx模型文件,再以CANN软件包运行用户将获取的文件上传至开发环境任意目录,例如上传到$HOME_/module__/_目录下。

执行如下命令生成离线模型。(如下命令中使用的目录以及文件均为样例,请以实际为准)

atc --model=$HOME/module/resnet50*.onnx --framework=5 --output=$HOME/module/out/onnx_resnet50 --soc_version=<soc_version>--model:Resnet50网络模型文件所在路径。

--framework:原始框架类型,5表示ONNX。

--output:生成的离线模型路径。

--soc_version:NPU IP加速器的型号。

关于参数的详细解释请参见参数说明,请使用与芯片名相对应的_<soc_version>_取值进行模型转换,然后再进行推理,具体使用芯片查询方法请参见--soc_version。

若提示如下信息,则说明模型转换成功。

ATC run success, welcome to the next use.成功执行命令后,在--output参数指定的路径下,可查看离线模型(如:onnx_resnet50.om)。

开源框架的Caffe网络模型转换成离线模型(IPV350不支持)

获取Caffe网络模型。

您可以从以下链接中获取ResNet-50网络的模型文件(*.prototxt)、权重文件(*.caffemodel),并以CANN软件包运行用户将获取的文件上传至开发环境任意目录,例如上传到$HOME_/module__/_目录下。

执行如下命令生成离线模型。(如下命令中使用的目录以及文件均为样例,请以实际为准)

atc --model=$HOME/module/resnet50.prototxt --weight=$HOME/module/resnet50.caffemodel --framework=0 --output=$HOME/module/out/caffe_resnet50 --soc_version=<soc_version>--model:ResNet-50网络模型文件所在路径。

--weight:ResNet-50网络权重文件所在路径。

--framework:原始框架类型,0表示Caffe。

--output:生成的离线模型路径。

--soc_version:NPU IP加速器的型号。

关于参数的详细解释请参见参数说明,请使用与芯片名相对应的_<soc_version>_取值进行模型转换,然后再进行推理,具体使用芯片查询方法请参见--soc_version。

若提示如下信息,则说明模型转换成功。

ATC run success, welcome to the next use.成功执行命令后,在--output参数指定的路径下,可查看离线模型(如:caffe_resnet50.om)。

初级功能¶

原始模型文件或离线模型转成JSON文件¶

场景介绍

如果用户不方便查看原始模型或离线模型的参数信息时,可以将原始模型或离线模型转成JSON文件进行查看。

转换方法

本章节以TensorFlow框架ResNet50网络模型为例进行演示,单击Link,根据页面提示获取ResNet50网络模型文件(*.pb)。

原始模型文件转JSON文件

命令示例如下:

atc --mode=1 --om=$HOME/module/resnet50_tensorflow*.pb --json=$HOME/module/out/tf_resnet50.json --framework=3--mode:运行模式,1表示原始模型文件或离线模型转JSON,此处特指原始模型文件转JSON。

--om:指定ResNet50网络模型文件所在路径。

--json:转换为JSON格式的文件路径和文件名。

--framework:原始框架类型,3表示TensorFlow。

离线模型转JSON文件(IPV350不支持)

该场景的前提是用户根据开源框架的TensorFlow网络模型转换成离线模型(IPV350不支持)已经得到了om离线模型文件,命令示例如下:

atc --mode=1 --om=$HOME/module/out/tf_resnet50.om --json=$HOME/module/out/tf_resnet50.json--mode:运行模式,1表示原始模型文件或离线模型转JSON,此处特指离线模型文件转JSON。

--om:指定离线模型文件所在路径。

关于参数的详细解释请参见参数说明。若提示如下信息,则说明转换成功,。

ATC run success, welcome to the next use.

成功执行命令后,在--json参数指定的路径下,可查看转换后的JSON文件信息,如下为部分JSON片段:

{

"node": [

{

"attr": [

{

"key": "shape",

"value": {

"shape": {

"dim": [

{

"size": 1

},

{

"size": 224

},

{

"size": 224

},

{

"size": 3

}

]

}

}

},

{

"key": "dtype",

"value": {

"type": "DT_FLOAT"

}

}

],

"name": "Placeholder",

"op": "Placeholder"

},

离线模型支持动态BatchSize/动态分辨率¶

该版本不支持动态BatchSize和动态分辨率特性。

场景介绍

某些推理场景,如检测出目标后再执行目标识别网络,由于目标个数不固定导致目标识别网络输入BatchSize不固定。如果每次推理都按照最大的BatchSize或最大分辨率进行计算,会造成计算资源浪费。

为此,ATC工具提供了--dynamic_batch_size参数设置BatchSize档位;提供了--dynamic_image_size参数设置分辨率档位。

转换方法

如下转换示例以TensorFlow框架ResNet50网络模型为例进行演示,单击Link,根据页面提示获取ResNet50网络的模型文件(*.pb)。

以CANN软件包运行用户登录开发环境,将模型文件(*.pb)上传到开发环境任意路径,例如上传到$HOME_/module__/_目录下。

执行如下命令生成离线模型。(如下命令中使用的目录以及文件均为样例,请以实际为准)

动态BatchSize

atc --model=$HOME/module/resnet50_tensorflow*.pb --framework=3 --output=$HOME/module/out/tf_resnet50 --soc_version=<soc_version> --input_shape="Placeholder:-1,224,224,3" --dynamic_batch_size="1,2,4,8"动态分辨率

atc --model=$HOME/module/resnet50_tensorflow*.pb --framework=3 --output=$HOME/module/out/tf_resnet50 --soc_version=<soc_version> --input_shape="Placeholder:1,-1,-1,3" --dynamic_image_size="224,224;448,448"

关键参数解释如下:

--dynamic_batch_size:设置动态BatchSize参数。

--dynamic_image_size:设置输入图片的动态分辨率参数。

--input_shape:指定模型输入数据的shape,配合--dynamic_batch_size或--dynamic_image_size参数使用。

--model:ResNet50网络模型文件所在路径。

--framework:原始框架类型,3表示TensorFlow。

关于参数的详细解释请参见参数说明。若提示如下信息,则说明模型转换成功,。

ATC run success, welcome to the next use.成功执行命令后,在--output参数指定的路径下,可查看离线模型(如:tf_resnet50.om)。

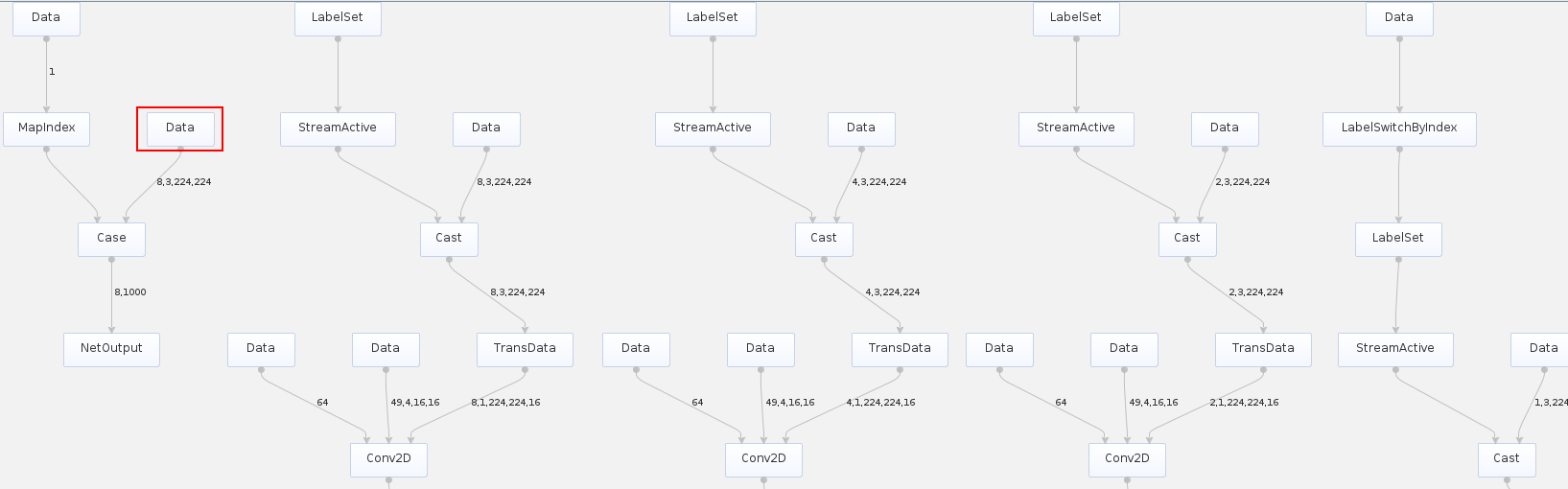

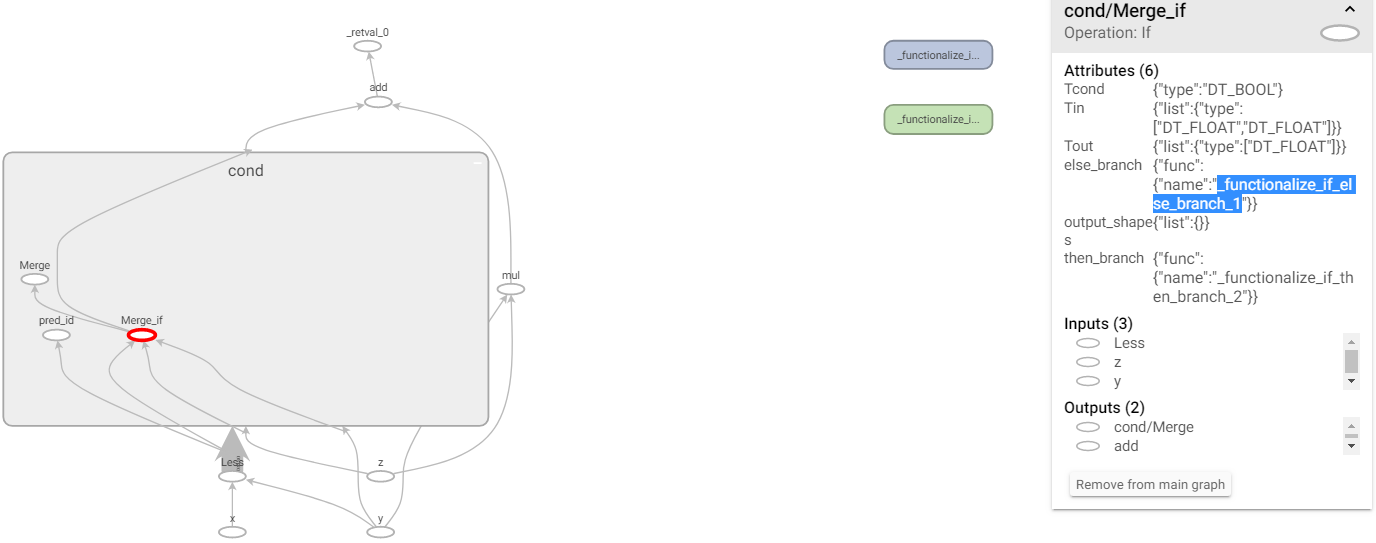

模型转换完成后,在生成的om/exeom(IPV350)离线模型中,会新增一个输入(如图1中红框中的Data输入),在模型推理时通过该新增的输入提供具体的Batch值(或分辨率值)。例如,a输入的BatchSize是动态的(或分辨率是动态的),在om离线模型中,会有与a对应的b输入来描述a的BatchSize(或分辨率取值)。

图 1 包含动态BatchSize功能的离线模型

离线模型支持动态维度¶

该版本不支持动态维度特性。

场景介绍

为支持Transformer等网络模型在输入Tensor维度不确定的场景,ATC工具提供了--dynamic_dims参数实现ND格式下任意维度的档位设置。ND表示支持任意格式。

转换方法

本章节以TensorFlow框架ResNet50网络模型为例进行演示,单击Link,根据页面提示获取ResNet50网络模型文件(*.pb)。

以CANN软件包运行用户登录开发环境,将模型文件上传到开发环境任意路径,例如上传到$HOME_/module__/_目录下。

执行如下命令生成离线模型。(如下命令中使用的目录以及文件均为样例,请以实际为准)

atc --model=$HOME/module/resnet50_tensorflow*.pb --framework=3 --output=$HOME/module/out/tf_resnet50 --soc_version=<soc_version> --input_shape="Placeholder:-1,-1,-1,3" --dynamic_dims="1,224,224;8,448,448" --input_format=ND关键参数解释如下:

--dynamic_dims:设置ND格式下动态维度档位。

--input_shape:指定模型输入数据的shape,配合--dynamic_dims参数使用。

--input_format:指定Format为ND格式。

--model:ResNet50网络模型文件所在路径。

--framework:原始框架类型,3表示TensorFlow。

关于参数的详细解释请参见参数说明。若提示如下信息,则说明模型转换成功,。

ATC run success, welcome to the next use.成功执行命令后,在--output参数指定的路径下,可查看离线模型。

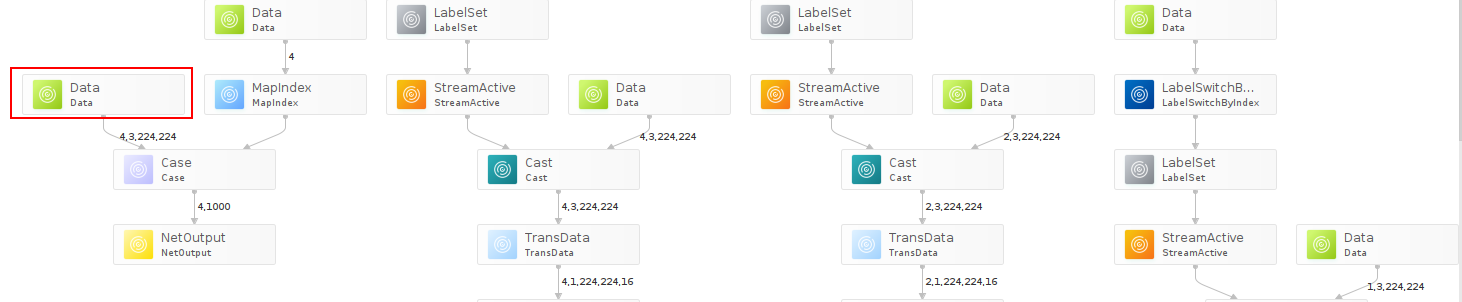

模型转换完成后,在生成的om离线模型中,会新增一个输入(如图1中红框中的Data输入),在模型推理时通过该新增的输入提供具体的维度值。例如,a输入的维度为动态的,在om离线模型中,会有与a对应的b输入来描述a的维度值。

图 1 包含动态维度的离线模型

自定义离线模型的输入输出数据类型¶

场景介绍

模型转换时支持指定网络的输入节点、输出节点的DataType、Format、模型转换支持精度选择等关键参数。

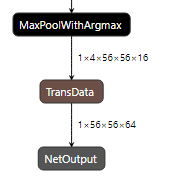

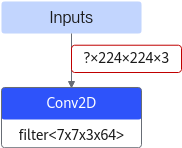

假如,针对TensorFlow框架ResNet-50网络模型,要求转换后离线模型的输入数据为Float16类型,指定_MaxPoolWithArgmax_算子作为输出算子(对应的节点名称为fp32_vars/MaxPoolWithArgmax),并且指定该输出节点的数据类型为FP16。该场景下就需要分别使用--input_fp16_nodes、--out_nodes、--output_type等参数来实现上述功能。

转换方法

本章节以TensorFlow框架ResNet50网络模型为例进行演示,单击Link,根据页面提示获取ResNet50网络模型文件(*.pb)。

以CANN软件包运行用户登录开发环境,将模型文件(*.pb)上传到开发环境任意路径,例如上传到$HOME_/module__/_目录下。

执行如下命令生成离线模型。(如下命令中使用的目录以及文件均为样例,请以实际为准)

atc --model=$HOME/module/resnet50_tensorflow_1.7.pb --framework=3 --output=$HOME/module/out/tf_resnet50 --soc_version=<soc_version> --input_fp16_nodes="Placeholder" --out_nodes="fp32_vars/MaxPoolWithArgmax:0" --output_type="fp32_vars/MaxPoolWithArgmax:0:FP16"关键参数解释如下:

--input_fp16_nodes:指定输入数据类型为Float16。

--out_nodes:指定MaxPoolWithArgmax算子作为模型的输出。

--output_type:指定输出节点的数据类型为Float16。

--model:ResNet50网络模型文件所在路径。

--framework:原始框架类型,3表示TensorFlow。

关于参数的详细解释请参见参数说明。若提示如下信息,则说明模型转换成功,。

ATC run success, welcome to the next use.成功执行命令后,在output参数指定的路径下,可查看离线模型(如:tf_resnet50.om/exeom(IPV350))。图1为_MaxPoolWithArgmax_算子作为模型输出算子的示意图(下图使用Netron可视化软件打开)。

图 1 指定某个算子为离线模型输出

借助离线模型查看软件基础版本号(IPV350不支持)¶

场景介绍

不同CANN软件包版本,由于软件功能差异,所转换出的离线模型功能也有差异,该场景下建议用户使用匹配CANN软件版本的ATC工具重新进行模型转换。假如用户已有转换好的离线模型,想查看使用的CANN软件包基础版本号,则可以参见本章节完成。

查看方法

获取已经转换好的离线模型,例如_tf_resnet50.om_,并以CANN软件包运行用户将其上传至开发环境任意目录,例如上传到$HOME_/module__/_目录下。

将离线模型转成JSON文件:

atc --mode=1 --om=$HOME/module/tf_resnet50.om --json=$HOME/module/out/tf_resnet50.json--om:指定离线模型文件_tf_resnet50.om_所在路径。

--json:转换为JSON格式的文件路径和文件名。

在转换后的JSON文件中,可以查看原始模型转换为离线模型时,使用的基础版本号,示例如下(如下为部分JSON片段),_<version>_即为展示的版本号信息:

{ "key": "opp_version", "value": { "s": "<version>" } }, ... ... { "key": "atc_version", "value": { "s": "<version>" } }, ... ... { "key": "atc_cmdline", "value": { "s": "xxx/atc.bin --model ./resnet50_tensorflow*.pb --framework 3 --output ./out/tf_resnet50 --soc_version <soc_version>" } }, ... ... { "key": "soc_version", "value": { "s": "<soc_version>" } },

高级功能¶

AIPP使能**(该版本不支持AIPP特性)**¶

本节介绍什么是AIPP,AIPP分类以及包括的特性。

通过在模型转换过程中开启AIPP功能,可以在推理之前就完成所有的数据处理;由于用的是专门的加速模块实现并保证性能,从而可以不让图像处理成为推理阶段的瓶颈,图像处理方式比较灵活。本章节给出如何在模型转换阶段开启AIPP功能。 AIPP提供了更为方便的图像格式转换方式:色域转换,用于将输入的图片格式,转换为模型需要的图片格式,一旦确认了AIPP处理前与AIPP处理后的图片格式,即可确定色域转换相关的参数值(matrix_r*c*配置项的值是固定的,不需要调整)。 归一化就是要把需要处理的数据经过处理后限制在一定范围内,方便后面数据的处理。AIPP支持的归一化设置,通过减均值和乘系数的操作完成,这样的能力不仅能用于常规的归一化,还能用于不同数据格式的转化。

如果有配置AIPP,无论静态AIPP还是动态AIPP,最终生成离线模型的输入大小(即input_size)均会被Crop、Padding等操作影响。本节给出对模型输入大小的约束说明。 AIPP配置文件通过本章节给出的模板进行配置,内容需要满足prototxt格式,用户根据场景决定配置哪些参数,修改为合适的取值另存后供模型转换使用;使用配置模板之前需要先查看相关约束。

什么是AIPP¶

本节介绍什么是AIPP,AIPP分类以及包括的特性。

该版本不支持AIPP特性。

AIPP(Artificial Intelligence Pre-Processing)人工智能预处理,用于在AI Core上完成数据预处理,包括改变图像尺寸、色域转换(转换图像格式)、减均值/乘系数(改变图像像素),数据预处理之后再进行真正的模型推理。

AIPP根据配置方式不同,分为静态AIPP和动态AIPP;如果要将原始图片输出为满足推理要求的图片格式,则需要使用色域转换功能;如果要输出固定大小的图片,则需要使用AIPP提供的Crop(抠图)、Padding(补边)功能。

静态AIPP和动态AIPP

在使能AIPP功能时,您只能选择静态AIPP或动态AIPP方式来处理图片,不能同时配置静态AIPP和动态AIPP两种方式,使能AIPP时可以通过aipp_mode参数控制。具体配置示例请参见AIPP配置示例,关于参数解释请参见配置文件模板。

静态AIPP:模型转换时设置AIPP模式为静态,同时设置AIPP参数,模型生成后,AIPP参数值被保存在离线模型中,每次模型推理过程采用固定的AIPP预处理参数进行处理,而且在之后的推理过程中无法通过业务代码进行直接的修改。

如果使用静态AIPP方式,多batch情况下共用同一份AIPP参数。

动态AIPP:模型转换时设置AIPP模式为动态,每次在执行推理前,根据需求动态修改AIPP参数值,然后在模型执行时可使用不同的AIPP参数。动态AIPP参数值会根据需求在不同的业务场景下选用合适的参数(如不同摄像头采用不同的归一化参数,输入图片格式需要兼容YUV420和RGB等)。

如果模型转换时设置了动态AIPP,则使用应用工程进行模型推理时,需要在AscendCL提供的aclmdlExecute接口之前,调用aclmdlSetInputAIPP接口,设置模型推理的动态AIPP数据。接口详细说明请参见《AscendCL应用开发指南 (C&C++)》手册中的“acl API参考 > 模型管理 > 模型执行”。

如果使用动态AIPP方式,多batch使用不同的参数,体现在动态参数结构体中,每个batch可以配置不同的crop等参数。关于动态参数结构体,请参见动态AIPP的参数输入结构。

色域转换

色域转换,用于将输入的图片格式,转换为模型需要的图片格式,在使能AIPP功能时,通过csc_switch参数控制色域转换功能是否开启,参数解释请参见配置文件模板。

一旦确认了AIPP处理前与AIPP处理后的图片格式,即可确定色域转换其他相关的参数值,本文提供相关模板可以供用户使用,无需再次修改,配置示例请参见色域转换配置说明。

改变图像尺寸

AIPP功能中的改变图像尺寸操作由Crop(抠图)、Padding(补边)完成,分别对应配置模板中的crop、padding参数。参数解释请参见配置文件模板。

关于该功能的详细说明以及AIPP参数配置示例请参见Crop/Padding配置说明。

AIPP配置示例¶

AIPP配置文件支持定义多组AIPP配置,对不同的模型输入进行不同的AIPP处理,配置多组AIPP参数时,将一组AIPP配置放到一个aipp_op配置项里;如果模型只有一个输入,则只需要配置第一组aipp_op即可。 AIPP配置文件支持定义多组AIPP配置,对不同的模型输入进行不同的AIPP处理,配置多组AIPP参数时,将一组AIPP配置放到一个aipp_op配置项里;如果模型只有一个输入,则只需要配置第一组aipp_op即可。

静态AIPP配置示例¶

AIPP配置文件支持定义多组AIPP配置,对不同的模型输入进行不同的AIPP处理,配置多组AIPP参数时,将一组AIPP配置放到一个aipp_op配置项里;如果模型只有一个输入,则只需要配置第一组aipp_op即可。

如下示例以网络模型为多输入时进行说明:

须知:

静态AIPP+动态shape场景:模型转换时,通过--insert_op_conf参数设置了静态AIPP,又通过--input_shape设置了动态shape,则: 如果模型只有一个输入,该场景不支持;如果模型有多个输入,则必须对不同的输入节点进行设置,比如一个输入节点设置静态AIPP,另外一个节点设置动态shape。

如果模型转换时,用户设置了--dynamic_image_size动态分辨率参数,即输入图片的宽和高不确定,同时又通过--insert_op_conf参数设置了静态AIPP功能:该场景下,AIPP配置文件中不能开启Crop和Padding功能,并且需要将配置文件中的src_image_size_w和src_image_size_h取值设置为0。

使用related_input_rank参数标识,对模型第几个输入进行AIPP处理,如下配置定义了两组AIPP参数,分别对模型第一个和第二个输入进行AIPP处理:

aipp_op { aipp_mode : static related_input_rank : 0 # 标识对第1个输入进行AIPP处理 src_image_size_w : 608 src_image_size_h : 608 crop : false input_format : YUV420SP_U8 csc_switch : true rbuv_swap_switch : false matrix_r0c0 : 298 matrix_r0c1 : 0 matrix_r0c2 : 409 matrix_r1c0 : 298 matrix_r1c1 : -100 matrix_r1c2 : -208 matrix_r2c0 : 298 matrix_r2c1 : 516 matrix_r2c2 : 0 input_bias_0 : 16 input_bias_1 : 128 input_bias_2 : 128 mean_chn_0 : 104 mean_chn_1 : 117 mean_chn_2 : 123 } aipp_op { aipp_mode : static related_input_rank : 1 # 标识对第2个输入进行AIPP处理 src_image_size_w : 608 src_image_size_h : 608 crop : false input_format : YUV420SP_U8 csc_switch : true rbuv_swap_switch : false matrix_r0c0 : 298 matrix_r0c1 : 0 matrix_r0c2 : 409 matrix_r1c0 : 298 matrix_r1c1 : -100 matrix_r1c2 : -208 matrix_r2c0 : 298 matrix_r2c1 : 516 matrix_r2c2 : 0 input_bias_0 : 16 input_bias_1 : 128 input_bias_2 : 128 mean_chn_0 : 104 mean_chn_1 : 117 mean_chn_2 : 123 }

动态AIPP配置示例¶

AIPP配置文件支持定义多组AIPP配置,对不同的模型输入进行不同的AIPP处理,配置多组AIPP参数时,将一组AIPP配置放到一个aipp_op配置项里;如果模型只有一个输入,则只需要配置第一组aipp_op即可。

如下示例以网络模型为多输入时进行说明。

配置示例

须知:

如果模型转换时,用户设置了--dynamic_batch_size动态Batch档位参数,同时又通过--insert_op_conf参数配置了动态AIPP功能: 实际推理时,调用aclmdlSetInputAIPP接口,设置动态AIPP相关参数值时,需确保batchSize要设置为最大Batch数。接口详细说明请参见《AscendCL应用开发指南 (C&C++)》手册中的“acl API参考 > 模型管理 > 模型执行 > aclmdlSetInputAIPP”。

如果模型转换时,用户设置了--dynamic_image_size动态分辨率参数,同时又通过--insert_op_conf参数配置了动态AIPP功能: 实际推理时,调用aclmdlSetInputAIPP接口,设置动态AIPP相关参数值时,不能开启Crop和Padding功能。该场景下,还需要确保通过aclmdlSetInputAIPP接口设置的宽和高与aclmdlSetDynamicHWSize接口设置的宽、高相等,都必须设置成动态分辨率最大档位的宽、高。接口详细说明请参见《AscendCL应用开发指南 (C&C++)》手册中的“acl API参考 > 模型管理 > 模型执行”章节。

如果模型转换时,用户设置了--input_shape动态shape范围参数,同时又通过--insert_op_conf参数配置了AIPP功能,则AIPP输出的宽和高要在--input_shape所设置的范围内。

动态AIPP场景下,用户无需手动配置csc_switch、rbuv_swap_switch等参数,根据如下配置文件配置好相关参数后,模型转换时,ATC会为动态AIPP新增一个模型输入(以下简称AippData)。

实际推理时,需要调用aclmdlSetInputAIPP接口,设置动态AIPP相关参数值,然后传给上述新增的AippData,AippData根据传入的参数值构造的结构体为动态AIPP的参数输入结构,该结构体无需用户手动处理。接口详细说明请参见《AscendCL应用开发指南 (C&C++)》手册中的“acl API参考 > 模型管理 > 模型执行 > aclmdlSetInputAIPP”。

aipp_op

{

aipp_mode: dynamic

related_input_rank: 0 # 标识对第1个输入进行AIPP处理

max_src_image_size: 752640 # 输入图像最大的size,参数必填

}

aipp_op

{

aipp_mode: dynamic

related_input_rank: 1 # 标识对第2个输入进行AIPP处理

max_src_image_size: 752640 # 输入图像最大的size,参数必填

}

动态AIPP的参数输入结构

根据配置示例配置好动态AIPP文件后,模型推理时为动态AIPP新增模型输入(AippData)传入参数值后,自动形成的结构体如下,该结构体无需用户手动处理:

typedef struct tagAippDynamicBatchPara

{

int8_t cropSwitch; //crop switch

int8_t scfSwitch; //resize switch

int8_t paddingSwitch; // 0: unable padding,

// 1: padding config value,sfr_filling_hblank_ch0 ~ sfr_filling_hblank_ch2

// 2: padding source picture data, single row/collumn copy

// 3: padding source picture data, block copy

// 4: padding source picture data, mirror copy

int8_t rotateSwitch; //rotate switch,0: non-rotate,1: rotate 90°clockwise,2: rotate 180°clockwise,3: rotate 270° clockwise

int8_t reserve[4];

int32_t cropStartPosW; //the start horizontal position of cropping

int32_t cropStartPosH; //the start vertical position of cropping

int32_t cropSizeW; //crop width

int32_t cropSizeH; //crop height

int32_t scfInputSizeW; //input width of scf

int32_t scfInputSizeH; //input height of scf

int32_t scfOutputSizeW; //output width of scf

int32_t scfOutputSizeH; //output height of scf

int32_t paddingSizeTop; //top padding size

int32_t paddingSizeBottom; //bottom padding size

int32_t paddingSizeLeft; //left padding size

int32_t paddingSizeRight; //right padding size

int16_t dtcPixelMeanChn0; //mean value of channel 0

int16_t dtcPixelMeanChn1; //mean value of channel 1

int16_t dtcPixelMeanChn2; //mean value of channel 2

int16_t dtcPixelMeanChn3; //mean value of channel 3

uint16_t dtcPixelMinChn0; //min value of channel 0

uint16_t dtcPixelMinChn1; //min value of channel 1

uint16_t dtcPixelMinChn2; //min value of channel 2

uint16_t dtcPixelMinChn3; //min value of channel 3

uint16_t dtcPixelVarReciChn0; //sfr_dtc_pixel_variance_reci_ch0

uint16_t dtcPixelVarReciChn1; //sfr_dtc_pixel_variance_reci_ch1

uint16_t dtcPixelVarReciChn2; //sfr_dtc_pixel_variance_reci_ch2

uint16_t dtcPixelVarReciChn3; //sfr_dtc_pixel_variance_reci_ch3

int8_t reserve1[16]; //32B assign, for ub copy

}kAippDynamicBatchPara;

typedef struct tagAippDynamicPara

{

uint8_t inputFormat; //input format:YUV420SP_U8/XRGB8888_U8/RGB888_U8

//uint8_t outDataType; //output data type: CC_DATA_HALF,CC_DATA_INT8, CC_DATA_UINT8

int8_t cscSwitch; //csc switch

int8_t rbuvSwapSwitch; //rb/ub swap switch

int8_t axSwapSwitch; //RGBA->ARGB, YUVA->AYUV swap switch

int8_t batchNum; //batch parameter number

int8_t reserve1[3];

int32_t srcImageSizeW; //source image width

int32_t srcImageSizeH; //source image height

int16_t cscMatrixR0C0; //csc_matrix_r0_c0

int16_t cscMatrixR0C1; //csc_matrix_r0_c1

int16_t cscMatrixR0C2; //csc_matrix_r0_c2

int16_t cscMatrixR1C0; //csc_matrix_r1_c0

int16_t cscMatrixR1C1; //csc_matrix_r1_c1

int16_t cscMatrixR1C2; //csc_matrix_r1_c2

int16_t cscMatrixR2C0; //csc_matrix_r2_c0

int16_t cscMatrixR2C1; //csc_matrix_r2_c1

int16_t cscMatrixR2C2; //csc_matrix_r2_c2

int16_t reserve2[3];

uint8_t cscOutputBiasR0; //output bias for RGB to YUV, element of row 0, unsigned number

uint8_t cscOutputBiasR1; //output bias for RGB to YUV, element of row 1, unsigned number

uint8_t cscOutputBiasR2; //output bias for RGB to YUV, element of row 2, unsigned number

uint8_t cscInputBiasR0; //input bias for YUV to RGB, element of row 0, unsigned number

uint8_t cscInputBiasR1; //input bias for YUV to RGB, element of row 1, unsigned number

uint8_t cscInputBiasR2; //input bias for YUV to RGB, element of row 2, unsigned number

uint8_t reserve3[2];

int8_t reserve4[16]; //32B assign, for ub copy

kAippDynamicBatchPara aippBatchPara; //allow transfer several batch para.

} kAippDynamicPara;

如何使能AIPP¶

通过在模型转换过程中开启AIPP功能,可以在推理之前就完成所有的数据处理;由于用的是专门的加速模块实现并保证性能,从而可以不让图像处理成为推理阶段的瓶颈,图像处理方式比较灵活。本章节给出如何在模型转换阶段开启AIPP功能。

本章节以TensorFlow框架ResNet50网络模型为例,演示如何通过模型转换使能静态AIPP功能,使能AIPP功能后,若实际提供给模型推理的测试图片不满足要求(包括图片格式,图片尺寸等),经过模型转换后,会输出满足模型要求的图片,并将该信息固化到转换后的离线模型中(模型转换后AIPP功能会以Aipp算子形式插入离线模型中)。

ResNet50网络模型要求的图片格式为RGB,图片尺寸为224*224,另外,假设提供给模型推理的测试图片尺寸为250*250,图片格式为YUV420SP,有效数据区域从左上角(0, 0)像素开始,使能AIPP过程中所需操作如表1分析所示。

表 1 场景分析

分类 |

ResNet50网络模型要求 |

实际提供给模型推理的测试图片 |

所需操作 |

|---|---|---|---|

图片格式 |

RGB |

YUV420SP |

该场景下需要开启AIPP的色域转换功能,将YUV420SP格式转成模型要求的RGB格式,关于色域转换功能详细说明请参见色域转换配置说明。 |

图片尺寸 |

224*224 |

250*250 |

提供的测试图片尺寸250*250大于224*224,该场景下需要开启AIPP抠图功能,并且抠图起始位置水平、垂直方向坐标load_start_pos_h、load_start_pos_w为0,执行推理时,将从(0, 0)点开始选取224*224区域的数据。 |

详细实现步骤如下:

获取TensorFlow网络模型。

单击Link,根据页面提示获取ResNet50网络的模型文件(*.pb),并以CANN软件包运行用户将获取的文件上传至开发环境任意目录,例如上传到$HOME_/module__/_目录下。

构造AIPP配置文件_insert_op.cfg_。

静态AIPP配置模板主要由如下几部分组成:AIPP配置模式(静态AIPP或者动态AIPP),原始图片信息(包括图片格式,以及图片尺寸),改变图片尺寸(抠图,补边)、色域转换功能等,如下分别介绍如何进行配置。

AIPP配置模式由aipp_mode参数决定,静态场景下的配置示例如下:

aipp_mode : static #static表示配置为静态AIPP配置原始图片信息。

input_format : YUV420SP_U8 #输入给AIPP的原始图片格式 src_image_size_w : 250 #输入给AIPP的原始图片宽高 src_image_size_h : 250

改变图片尺寸。

改变图片尺寸由抠图和补边等功能完成,本示例需要配置抠图起始位置,抠图后的图片大小等信息,若抠图后图片尺寸仍旧不满足模型要求,还需要配置补边功能。

而AIPP提供了更为方便的配置方式,就是若开启抠图功能,并且不配置补边功能,抠图大小可以取值为0或者不配置,此时抠图大小的宽和高来自模型--input_shape中的宽和高。本示例中我们不配置抠图大小,配置示例如下:

crop: true #抠图开关,用于改变图片尺寸 load_start_pos_h: 0 #抠图起始位置水平、垂直方向坐标 load_start_pos_w: 0

色域转换功能。

色域转换功能由csc_switch参数控制,并通过色域转换系数matrix_r*c*、通道交换rbuv_swap_switch等参数配合使用。AIPP提供了一个比较方便的功能,就是一旦确认了AIPP处理前与AIPP处理后的图片格式,即可确定色域转换相关的参数值,用户无需修改,即上述参数都可以直接从模板中进行复制,模板示例以及更多配置模板请参见色域转换配置说明。如下为该场景下的配置示例:

csc_switch : true #色域转换开关,true表示开启色域转换 rbuv_swap_switch : false #通道交换开关(R通道与B通道交换开关/U通道与V通道交换),本例中不涉及两个通道的交换,故设置为false,默认为false matrix_r0c0 : 256 #色域转换系数 matrix_r0c1 : 0 matrix_r0c2 : 359 matrix_r1c0 : 256 matrix_r1c1 : -88 matrix_r1c2 : -183 matrix_r2c0 : 256 matrix_r2c1 : 454 matrix_r2c2 : 0 input_bias_0 : 0 input_bias_1 : 128 input_bias_2 : 128

将上述所有的参数组合到_insert_op.cfg_文件中,即为我们需要构造的AIPP配置文件,完整示例如下:

aipp_op { aipp_mode : static #AIPP配置模式 input_format : YUV420SP_U8 #输入给AIPP的原始图片格式 src_image_size_w : 250 #输入给AIPP的原始图片宽高 src_image_size_h : 250 crop: true #抠图开关,用于改变图片尺寸 load_start_pos_h: 0 #抠图起始位置水平、垂直方向坐标 load_start_pos_w: 0 csc_switch : true #色域转换开关,true表示开启色域转换 rbuv_swap_switch : false #通道交换开关 matrix_r0c0 : 256 #色域转换系数,用户无需修改 matrix_r0c1 : 0 matrix_r0c2 : 359 matrix_r1c0 : 256 matrix_r1c1 : -88 matrix_r1c2 : -183 matrix_r2c0 : 256 matrix_r2c1 : 454 matrix_r2c2 : 0 input_bias_0 : 0 input_bias_1 : 128 input_bias_2 : 128 }

您可以根据AIPP配置示例或典型场景样例参考章节获取更多场景AIPP配置示例,如果上述示例仍旧无法满足要求,则需要参见配置文件模板自行构造配置文件。将上述_insert_op.cfg_文件上传到ATC工具所在Linux服务器。

atc命令中加入--insert_op_conf参数,用于插入aipp预处理算子,执行如下命令生成离线模型。(如下命令中使用的目录以及文件均为样例,请以实际为准)

atc --model=$HOME/module/resnet50_tensorflow*.pb --framework=3 --output=$HOME/module/out/tf_resnet50 --soc_version=<soc_version> --insert_op_conf=$HOME/module/insert_op.cfg关于参数的详细解释以及使用方法请参见参数说明。若提示如下信息,则说明模型转换成功。

ATC run success, welcome to the next use.成功执行命令后,在--output参数指定的路径下,可查看离线模型(如:tf_resnet50.om)。

(可选)如果用户想查看转换后离线模型中Aipp算子的相关信息,则可以将上述离线模型转成JSON文件查看,命令如下:

atc --mode=1 --om=$HOME/module/out/tf_resnet50.om --json=$HOME/module/out/tf_resnet50.json如下为JSON文件中带有aipp信息的样例(如下样例中所有aipp属性值都为样例,请以用户实际构造的配置文件为准):

{ "key": "aipp", "value": { "func": { "attr": [ { "key": "mean_chn_0", "value": { "i": 0 } }, { "key": "mean_chn_1", "value": { "i": 0 } }, { "key": "mean_chn_2", "value": { "i": 0 } }, { "key": "mean_chn_3", "value": { "i": 0 } }, { "key": "csc_switch", "value": { "b": true } }, { "key": "input_format", "value": { "i": 1 } }, { "key": "input_bias_0", "value": { "i": 0 } }, { "key": "input_bias_1", "value": { "i": 128 } }, { "key": "input_bias_2", "value": { "i": 128 } }, { "key": "aipp_mode", "value": { "i": 1 } }, { "key": "src_image_size_h", "value": { "i": 250 } }, { "key": "crop_size_h", "value": { "i": 0 } }, { "key": "matrix_r0c0", "value": { "i": 256 } }, { "key": "matrix_r0c1", "value": { "i": 0 } }, { "key": "matrix_r0c2", "value": { "i": 359 } }, { "key": "src_image_size_w", "value": { "i": 250 } }, { "key": "crop_size_w", "value": { "i": 0 } }, { "key": "rbuv_swap_switch", "value": { "b": false } }, { "key": "padding", "value": { "b": false } }, { "key": "ax_swap_switch", "value": { "b": false } }, { "key": "top_padding_size", "value": { "i": 0 } }, { "key": "matrix_r1c0", "value": { "i": 256 } }, { "key": "matrix_r1c1", "value": { "i": -88 } }, { "key": "matrix_r1c2", "value": { "i": -183 } }, { "key": "resize", "value": { "b": false } }, { "key": "resize_output_h", "value": { "i": 0 } }, { "key": "related_input_rank", "value": { "i": 0 } }, { "key": "load_start_pos_h", "value": { "i": 0 } }, { "key": "matrix_r2c0", "value": { "i": 256 } }, { "key": "matrix_r2c1", "value": { "i": 454 } }, { "key": "matrix_r2c2", "value": { "i": 0 } }, { "key": "resize_output_w", "value": { "i": 0 } }, { "key": "var_reci_chn_0", "value": { "f": "1" } }, { "key": "var_reci_chn_1", "value": { "f": "1" } }, { "key": "var_reci_chn_2", "value": { "f": "1" } }, { "key": "load_start_pos_w", "value": { "i": 0 } }, { "key": "var_reci_chn_3", "value": { "f": "1" } }, { "key": "single_line_mode", "value": { "b": false } }, { "key": "output_bias_0", "value": { "i": 16 } }, { "key": "output_bias_1", "value": { "i": 128 } }, { "key": "output_bias_2", "value": { "i": 128 } }, { "key": "right_padding_size", "value": { "i": 0 } }, { "key": "bottom_padding_size", "value": { "i": 0 } }, { "key": "min_chn_0", "value": { "f": "0" } }, { "key": "min_chn_1", "value": { "f": "0" } }, { "key": "min_chn_2", "value": { "f": "0" } }, { "key": "min_chn_3", "value": { "f": "0" } }, { "key": "crop", "value": { "b": false } }, { "key": "cpadding_value", "value": { "f": "0" } }, { "key": "left_padding_size", "value": { "i": 0 } } ] } } }

色域转换配置说明¶

AIPP提供了更为方便的图像格式转换方式:色域转换,用于将输入的图片格式,转换为模型需要的图片格式,一旦确认了AIPP处理前与AIPP处理后的图片格式,即可确定色域转换相关的参数值(matrix_r*c*配置项的值是固定的,不需要调整)。

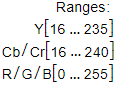

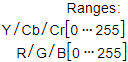

例如:将视频解码后的YUV格式数据转为RGB格式。而根据不同的彩色视频数字化标准又可以将视频格式分为BT-601标准清晰度视频格式(定义于SDTV标准中)和BT-709高清晰度视频格式(定义于HDTV标准中)。两种视频格式又分为NARROW和WIDE,其中:

NARROW取值范围为: ,WIDE取值范围为:

,WIDE取值范围为:

关于如何判断输入数据的标准,请参见使用AIPP色域转换模型时如何判断视频流的格式标准。

YUV格式的数据转为RGB格式可以视作如下公式展示的矩阵乘法,这其中的转换矩阵就是待配置的参数和偏移量。

# YUV转BGR:

| B | | matrix_r0c0 matrix_r0c1 matrix_r0c2 | | Y - input_bias_0 |

| G | = | matrix_r1c0 matrix_r1c1 matrix_r1c2 | | U - input_bias_1 | >> 8

| R | | matrix_r2c0 matrix_r2c1 matrix_r2c2 | | V - input_bias_2 |

在AIPP处理前,针对模型输入的图片或视频(各颜色编码方式,如YUV420SP_U8、RGB888_U8等),当前给出BT-601NARROW、BT-601WIDE、BT-709NARROW、BT-709WIDE几种典型场景下的色域转换配置。

色域转换概览

支持的色域转换配置如表1所示。

表 1 色域转换概览表

支持的色域转换列表 |

支持的色域转换列表 |

支持的色域转换列表 |

支持的色域转换列表 |

|---|---|---|---|

- |

|||

- |

|||

- |

|||

- |

|||

- |

|||

- |

|||

- |

YUV420SP_U8转YUV444

aipp_op {

aipp_mode: static

input_format : YUV420SP_U8

csc_switch : false

rbuv_swap_switch : false

}

YUV420SP_U8转YVU444

aipp_op {

aipp_mode: static

input_format : YUV420SP_U8

csc_switch : false

rbuv_swap_switch : true

}

YUV420SP_U8转RGB

输入数据为BT-601NARROW视频

BT-601NARROW

aipp_op { aipp_mode: static input_format : YUV420SP_U8 csc_switch : true rbuv_swap_switch : false matrix_r0c0 : 298 matrix_r0c1 : 0 matrix_r0c2 : 409 matrix_r1c0 : 298 matrix_r1c1 : -100 matrix_r1c2 : -208 matrix_r2c0 : 298 matrix_r2c1 : 516 matrix_r2c2 : 0 input_bias_0 : 16 input_bias_1 : 128 input_bias_2 : 128 }输入数据为BT-601WIDE视频

BT-601WIDE

aipp_op { aipp_mode: static input_format : YUV420SP_U8 csc_switch : true rbuv_swap_switch : false matrix_r0c0 : 256 matrix_r0c1 : 0 matrix_r0c2 : 359 matrix_r1c0 : 256 matrix_r1c1 : -88 matrix_r1c2 : -183 matrix_r2c0 : 256 matrix_r2c1 : 454 matrix_r2c2 : 0 input_bias_0 : 0 input_bias_1 : 128 input_bias_2 : 128 }输入数据为BT-709NARROW视频

BT-709NARROW

aipp_op { aipp_mode: static input_format : YUV420SP_U8 csc_switch : true rbuv_swap_switch : false matrix_r0c0 : 298 matrix_r0c1 : 0 matrix_r0c2 : 459 matrix_r1c0 : 298 matrix_r1c1 : -55 matrix_r1c2 : -136 matrix_r2c0 : 298 matrix_r2c1 : 541 matrix_r2c2 : 0 input_bias_0 : 16 input_bias_1 : 128 input_bias_2 : 128 }输入数据为BT-709WIDE视频

BT-709WIDE

aipp_op { aipp_mode: static input_format : YUV420SP_U8 csc_switch : true rbuv_swap_switch : false matrix_r0c0 : 256 matrix_r0c1 : 0 matrix_r0c2 : 403 matrix_r1c0 : 256 matrix_r1c1 : -48 matrix_r1c2 : -120 matrix_r2c0 : 256 matrix_r2c1 : 475 matrix_r2c2 : 0 input_bias_0 : 0 input_bias_1 : 128 input_bias_2 : 128 }

YUV420SP_U8转BGR

输入数据为BT-601NARROW视频

BT-601NARROW

aipp_op { aipp_mode: static input_format : YUV420SP_U8 csc_switch : true rbuv_swap_switch : false matrix_r0c0 : 298 matrix_r0c1 : 516 matrix_r0c2 : 0 matrix_r1c0 : 298 matrix_r1c1 : -100 matrix_r1c2 : -208 matrix_r2c0 : 298 matrix_r2c1 : 0 matrix_r2c2 : 409 input_bias_0 : 16 input_bias_1 : 128 input_bias_2 : 128 }输入数据为BT-601WIDE视频

BT-601WIDE

aipp_op { aipp_mode: static input_format : YUV420SP_U8 csc_switch : true rbuv_swap_switch : false matrix_r0c0 : 256 matrix_r0c1 : 454 matrix_r0c2 : 0 matrix_r1c0 : 256 matrix_r1c1 : -88 matrix_r1c2 : -183 matrix_r2c0 : 256 matrix_r2c1 : 0 matrix_r2c2 : 359 input_bias_0 : 0 input_bias_1 : 128 input_bias_2 : 128 }输入数据为BT-709NARROW视频

BT-709NARROW

aipp_op { aipp_mode: static input_format : YUV420SP_U8 csc_switch : true rbuv_swap_switch : false matrix_r0c0 : 298 matrix_r0c1 : 541 matrix_r0c2 : 0 matrix_r1c0 : 298 matrix_r1c1 : -55 matrix_r1c2 : -136 matrix_r2c0 : 298 matrix_r2c1 : 0 matrix_r2c2 : 459 input_bias_0 : 16 input_bias_1 : 128 input_bias_2 : 128 }输入数据为BT-709WIDE视频

BT-709WIDE

aipp_op { aipp_mode: static input_format : YUV420SP_U8 csc_switch : true rbuv_swap_switch : false matrix_r0c0 : 256 matrix_r0c1 : 475 matrix_r0c2 : 0 matrix_r1c0 : 256 matrix_r1c1 : -48 matrix_r1c2 : -120 matrix_r2c0 : 256 matrix_r2c1 : 0 matrix_r2c2 : 403 input_bias_0 : 0 input_bias_1 : 128 input_bias_2 : 128 }

YUV420SP_U8转GRAY

aipp_op {

aipp_mode: static

input_format : YUV420SP_U8

csc_switch : true

rbuv_swap_switch : false

matrix_r0c0 : 256

matrix_r0c1 : 0

matrix_r0c2 : 0

matrix_r1c0 : 0

matrix_r1c1 : 0

matrix_r1c2 : 0

matrix_r2c0 : 0

matrix_r2c1 : 0

matrix_r2c2 : 0

input_bias_0 : 0

input_bias_1 : 0

input_bias_2 : 0

}

YVU420SP_U8转RGB

输入数据为BT-601NARROW视频

BT-601NARROW

aipp_op { aipp_mode: static input_format : YUV420SP_U8 csc_switch : true rbuv_swap_switch : true matrix_r0c0 : 298 matrix_r0c1 : 0 matrix_r0c2 : 409 matrix_r1c0 : 298 matrix_r1c1 : -100 matrix_r1c2 : -208 matrix_r2c0 : 298 matrix_r2c1 : 516 matrix_r2c2 : 0 input_bias_0 : 16 input_bias_1 : 128 input_bias_2 : 128 }输入数据为BT-601WIDE视频

BT-601WIDE

aipp_op { aipp_mode: static input_format : YUV420SP_U8 csc_switch : true rbuv_swap_switch : true matrix_r0c0 : 256 matrix_r0c1 : 0 matrix_r0c2 : 359 matrix_r1c0 : 256 matrix_r1c1 : -88 matrix_r1c2 : -183 matrix_r2c0 : 256 matrix_r2c1 : 454 matrix_r2c2 : 0 input_bias_0 : 0 input_bias_1 : 128 input_bias_2 : 128 }输入数据为BT-709NARROW视频

BT-709NARROW

aipp_op { aipp_mode: static input_format : YUV420SP_U8 csc_switch : true rbuv_swap_switch : true matrix_r0c0 : 298 matrix_r0c1 : 0 matrix_r0c2 : 459 matrix_r1c0 : 298 matrix_r1c1 : -55 matrix_r1c2 : -136 matrix_r2c0 : 298 matrix_r2c1 : 541 matrix_r2c2 : 0 input_bias_0 : 16 input_bias_1 : 128 input_bias_2 : 128 }输入数据为BT-709WIDE视频

BT-709WIDE

aipp_op { aipp_mode: static input_format : YUV420SP_U8 csc_switch : true rbuv_swap_switch : true matrix_r0c0 : 256 matrix_r0c1 : 0 matrix_r0c2 : 403 matrix_r1c0 : 256 matrix_r1c1 : -48 matrix_r1c2 : -120 matrix_r2c0 : 256 matrix_r2c1 : 475 matrix_r2c2 : 0 input_bias_0 : 0 input_bias_1 : 128 input_bias_2 : 128 }

YVU420SP_U8转BGR

输入数据为BT-601NARROW视频

BT-601NARROW

aipp_op { aipp_mode: static input_format : YUV420SP_U8 csc_switch : true rbuv_swap_switch : true matrix_r0c0 : 298 matrix_r0c1 : 516 matrix_r0c2 : 0 matrix_r1c0 : 298 matrix_r1c1 : -100 matrix_r1c2 : -208 matrix_r2c0 : 298 matrix_r2c1 : 0 matrix_r2c2 : 409 input_bias_0 : 16 input_bias_1 : 128 input_bias_2 : 128 }输入数据为BT-601WIDE视频

BT-601WIDE

aipp_op { aipp_mode: static input_format : YUV420SP_U8 csc_switch : true rbuv_swap_switch : true matrix_r0c0 : 256 matrix_r0c1 : 454 matrix_r0c2 : 0 matrix_r1c0 : 256 matrix_r1c1 : -88 matrix_r1c2 : -183 matrix_r2c0 : 256 matrix_r2c1 : 0 matrix_r2c2 : 359 input_bias_0 : 0 input_bias_1 : 128 input_bias_2 : 128 }输入数据为BT-709NARROW视频

BT-709NARROW

aipp_op { aipp_mode: static input_format : YUV420SP_U8 csc_switch : true rbuv_swap_switch : true matrix_r0c0 : 298 matrix_r0c1 : 541 matrix_r0c2 : 0 matrix_r1c0 : 298 matrix_r1c1 : -55 matrix_r1c2 : -136 matrix_r2c0 : 298 matrix_r2c1 : 0 matrix_r2c2 : 459 input_bias_0 : 16 input_bias_1 : 128 input_bias_2 : 128 }输入数据为BT-709WIDE视频

BT-709WIDE

aipp_op { aipp_mode: static input_format : YUV420SP_U8 csc_switch : true rbuv_swap_switch : true matrix_r0c0 : 256 matrix_r0c1 : 475 matrix_r0c2 : 0 matrix_r1c0 : 256 matrix_r1c1 : -48 matrix_r1c2 : -120 matrix_r2c0 : 256 matrix_r2c1 : 0 matrix_r2c2 : 403 input_bias_0 : 0 input_bias_1 : 128 input_bias_2 : 128 }

RGB888_U8转RGB

aipp_op {

aipp_mode: static

input_format : RGB888_U8

csc_switch : false

rbuv_swap_switch : false

}

RGB888_U8转BGR

aipp_op {

aipp_mode : static

input_format : RGB888_U8

csc_switch : false

rbuv_swap_switch : true

}

RGB888_U8转YUV444

输入数据为BT-601NARROW视频

BT-601NARROW

aipp_op { aipp_mode: static input_format : RGB888_U8 csc_switch : true rbuv_swap_switch : false matrix_r0c0 : 66 matrix_r0c1 : 129 matrix_r0c2 : 25 matrix_r1c0 : -38 matrix_r1c1 : -74 matrix_r1c2 : 112 matrix_r2c0 : 112 matrix_r2c1 : -94 matrix_r2c2 : -18 output_bias_0 : 16 output_bias_1 : 128 output_bias_2 : 128 }输入数据为BT-601WIDE视频

BT-601WIDE

aipp_op { aipp_mode: static input_format : RGB888_U8 csc_switch : true rbuv_swap_switch : false matrix_r0c0 : 77 matrix_r0c1 : 150 matrix_r0c2 : 29 matrix_r1c0 : -43 matrix_r1c1 : -85 matrix_r1c2 : 128 matrix_r2c0 : 128 matrix_r2c1 : -107 matrix_r2c2 : -21 output_bias_0 : 0 output_bias_1 : 128 output_bias_2 : 128 }输入数据为BT-709NARROW视频

BT-709NARROW

aipp_op { aipp_mode: static input_format : RGB888_U8 csc_switch : true rbuv_swap_switch : false matrix_r0c0 : 47 matrix_r0c1 : 157 matrix_r0c2 : 16 matrix_r1c0 : -26 matrix_r1c1 : -87 matrix_r1c2 : 112 matrix_r2c0 : 112 matrix_r2c1 : -102 matrix_r2c2 : -10 output_bias_0 : 16 output_bias_1 : 128 output_bias_2 : 128 }输入数据为BT-709WIDE视频

BT-709WIDE

aipp_op { aipp_mode: static input_format : RGB888_U8 csc_switch : true rbuv_swap_switch : false matrix_r0c0 : 55 matrix_r0c1 : 183 matrix_r0c2 : 19 matrix_r1c0 : -29 matrix_r1c1 : -99 matrix_r1c2 : 128 matrix_r2c0 : 128 matrix_r2c1 : -116 matrix_r2c2 : -12 output_bias_0 : 0 output_bias_1 : 128 output_bias_2 : 128 }

RGB888_U8转YVU444

输入数据为BT-601NARROW视频

BT-601NARROW

aipp_op { aipp_mode: static input_format : RGB888_U8 csc_switch : true rbuv_swap_switch : false matrix_r0c0 : 66 matrix_r0c1 : 129 matrix_r0c2 : 25 matrix_r1c0 : 112 matrix_r1c1 : -94 matrix_r1c2 : -18 matrix_r2c0 : -38 matrix_r2c1 : -74 matrix_r2c2 : 112 output_bias_0 : 16 output_bias_1 : 128 output_bias_2 : 128 }输入数据为BT-601WIDE视频

BT-601WIDE

aipp_op { aipp_mode: static input_format : RGB888_U8 csc_switch : true rbuv_swap_switch : false matrix_r0c0 : 77 matrix_r0c1 : 150 matrix_r0c2 : 29 matrix_r1c0 : 128 matrix_r1c1 : -107 matrix_r1c2 : -21 matrix_r2c0 : -43 matrix_r2c1 : -85 matrix_r2c2 : 128 output_bias_0 : 0 output_bias_1 : 128 output_bias_2 : 128 }输入数据为BT-709NARROW视频

BT-709NARROW

aipp_op { aipp_mode: static input_format : RGB888_U8 csc_switch : true rbuv_swap_switch : false matrix_r0c0 : 47 matrix_r0c1 : 157 matrix_r0c2 : 16 matrix_r1c0 : 112 matrix_r1c1 : -102 matrix_r1c2 : -10 matrix_r2c0 : -26 matrix_r2c1 : -87 matrix_r2c2 : 112 output_bias_0 : 16 output_bias_1 : 128 output_bias_2 : 128 }输入数据为BT-709WIDE视频

BT-709WIDE

aipp_op { aipp_mode: static input_format : RGB888_U8 csc_switch : true rbuv_swap_switch : false matrix_r0c0 : 55 matrix_r0c1 : 183 matrix_r0c2 : 19 matrix_r1c0 : 128 matrix_r1c1 : -116 matrix_r1c2 : -12 matrix_r2c0 : -29 matrix_r2c1 : -99 matrix_r2c2 : 128 output_bias_0 : 0 output_bias_1 : 128 output_bias_2 : 128 }

RGB888_U8转GRAY

aipp_op {

aipp_mode: static

input_format : RGB888_U8

csc_switch : true

rbuv_swap_switch : false

matrix_r0c0 : 76

matrix_r0c1 : 150

matrix_r0c2 : 30

matrix_r1c0 : 0

matrix_r1c1 : 0

matrix_r1c2 : 0

matrix_r2c0 : 0

matrix_r2c1 : 0

matrix_r2c2 : 0

output_bias_0 : 0

output_bias_1 : 0

output_bias_2 : 0

}

BGR888_U8转GRAY

aipp_op {

aipp_mode: static

input_format : RGB888_U8

csc_switch : true

rbuv_swap_switch : true

matrix_r0c0 : 76

matrix_r0c1 : 150

matrix_r0c2 : 30

matrix_r1c0 : 0

matrix_r1c1 : 0

matrix_r1c2 : 0

matrix_r2c0 : 0

matrix_r2c1 : 0

matrix_r2c2 : 0

output_bias_0 : 0

output_bias_1 : 0

output_bias_2 : 0

}

BGR888_U8转RGB

aipp_op {

aipp_mode: static

input_format : RGB888_U8

csc_switch : false

rbuv_swap_switch : true

}

BGR888_U8转BGR

aipp_op {

aipp_mode: static

input_format : RGB888_U8

csc_switch : false

rbuv_swap_switch : false

}

XRGB8888_U8转RGB

aipp_op {

aipp_mode: static

input_format : XRGB8888_U8

csc_switch : false

rbuv_swap_switch : false

ax_swap_switch : true

}

XRGB8888_U8转BGR

aipp_op {

aipp_mode : static

input_format : XRGB8888_U8

csc_switch : false

rbuv_swap_switch : true

ax_swap_switch : true

}

XRGB8888_U8转YUV444

输入数据为BT-601NARROW视频

BT-601NARROW

aipp_op { aipp_mode: static input_format : XRGB8888_U8 csc_switch : true rbuv_swap_switch : false ax_swap_switch : true matrix_r0c0 : 66 matrix_r0c1 : 129 matrix_r0c2 : 25 matrix_r1c0 : -38 matrix_r1c1 : -74 matrix_r1c2 : 112 matrix_r2c0 : 112 matrix_r2c1 : -94 matrix_r2c2 : -18 output_bias_0 : 16 output_bias_1 : 128 output_bias_2 : 128 }输入数据为BT-601WIDE视频

BT-601WIDE

aipp_op { aipp_mode: static input_format : XRGB8888_U8 csc_switch : true rbuv_swap_switch : false ax_swap_switch : true matrix_r0c0 : 77 matrix_r0c1 : 150 matrix_r0c2 : 29 matrix_r1c0 : -43 matrix_r1c1 : -85 matrix_r1c2 : 128 matrix_r2c0 : 128 matrix_r2c1 : -107 matrix_r2c2 : -21 output_bias_0 : 0 output_bias_1 : 128 output_bias_2 : 128 }输入数据为BT-709NARROW视频

BT-709NARROW

aipp_op { aipp_mode: static input_format : XRGB8888_U8 csc_switch : true rbuv_swap_switch : false ax_swap_switch : true matrix_r0c0 : 47 matrix_r0c1 : 157 matrix_r0c2 : 16 matrix_r1c0 : -26 matrix_r1c1 : -87 matrix_r1c2 : 112 matrix_r2c0 : 112 matrix_r2c1 : -102 matrix_r2c2 : -10 output_bias_0 : 16 output_bias_1 : 128 output_bias_2 : 128 }输入数据为BT-709WIDE视频

BT-709WIDE

aipp_op { aipp_mode: static input_format : XRGB8888_U8 csc_switch : true rbuv_swap_switch : false ax_swap_switch : true matrix_r0c0 : 55 matrix_r0c1 : 183 matrix_r0c2 : 19 matrix_r1c0 : -29 matrix_r1c1 : -99 matrix_r1c2 : 128 matrix_r2c0 : 128 matrix_r2c1 : -116 matrix_r2c2 : -12 output_bias_0 : 0 output_bias_1 : 128 output_bias_2 : 128 }

XRGB8888_U8转YVU444

输入数据为BT-601NARROW视频

BT-601NARROW

aipp_op { aipp_mode: static input_format : XRGB8888_U8 csc_switch : true rbuv_swap_switch : false ax_swap_switch : true matrix_r0c0 : 66 matrix_r0c1 : 129 matrix_r0c2 : 25 matrix_r1c0 : 112 matrix_r1c1 : -94 matrix_r1c2 : -18 matrix_r2c0 : -38 matrix_r2c1 : -74 matrix_r2c2 : 112 output_bias_0 : 16 output_bias_1 : 128 output_bias_2 : 128 }输入数据为BT-601WIDE视频

BT-601WIDE

aipp_op { aipp_mode: static input_format : XRGB8888_U8 csc_switch : true rbuv_swap_switch : false ax_swap_switch : true matrix_r0c0 : 77 matrix_r0c1 : 150 matrix_r0c2 : 29 matrix_r1c0 : 128 matrix_r1c1 : -107 matrix_r1c2 : -21 matrix_r2c0 : -43 matrix_r2c1 : -85 matrix_r2c2 : 128 output_bias_0 : 0 output_bias_1 : 128 output_bias_2 : 128 }输入数据为BT-709NARROW视频

BT-709NARROW

aipp_op { aipp_mode: static input_format : XRGB8888_U8 csc_switch : true rbuv_swap_switch : false ax_swap_switch : true matrix_r0c0 : 47 matrix_r0c1 : 157 matrix_r0c2 : 16 matrix_r1c0 : 112 matrix_r1c1 : -102 matrix_r1c2 : -10 matrix_r2c0 : -26 matrix_r2c1 : -87 matrix_r2c2 : 112 output_bias_0 : 16 output_bias_1 : 128 output_bias_2 : 128 }输入数据为BT-709WIDE视频

BT-709WIDE

aipp_op { aipp_mode: static input_format : XRGB8888_U8 csc_switch : true rbuv_swap_switch : false ax_swap_switch : true matrix_r0c0 : 55 matrix_r0c1 : 183 matrix_r0c2 : 19 matrix_r1c0 : 128 matrix_r1c1 : -116 matrix_r1c2 : -12 matrix_r2c0 : -29 matrix_r2c1 : -99 matrix_r2c2 : 128 output_bias_0 : 0 output_bias_1 : 128 output_bias_2 : 128 }

XRGB8888_U8转GRAY

aipp_op {

aipp_mode: static

input_format : XRGB8888_U8

csc_switch : true

rbuv_swap_switch : false

ax_swap_switch : true

matrix_r0c0 : 76

matrix_r0c1 : 150

matrix_r0c2 : 30

matrix_r1c0 : 0

matrix_r1c1 : 0

matrix_r1c2 : 0

matrix_r2c0 : 0

matrix_r2c1 : 0

matrix_r2c2 : 0

output_bias_0 : 0

output_bias_1 : 0

output_bias_2 : 0

}

XBGR8888_U8转GRAY

aipp_op {

aipp_mode: static

input_format : XRGB8888_U8

csc_switch : true

rbuv_swap_switch : true

ax_swap_switch : true

matrix_r0c0 : 76

matrix_r0c1 : 150

matrix_r0c2 : 30

matrix_r1c0 : 0

matrix_r1c1 : 0

matrix_r1c2 : 0

matrix_r2c0 : 0

matrix_r2c1 : 0

matrix_r2c2 : 0

output_bias_0 : 0

output_bias_1 : 0

output_bias_2 : 0

}

RGBX8888_U8转GRAY

aipp_op {

aipp_mode: static

input_format : XRGB8888_U8

csc_switch : true

rbuv_swap_switch : false

ax_swap_switch : false

matrix_r0c0 : 76

matrix_r0c1 : 150

matrix_r0c2 : 30

matrix_r1c0 : 0

matrix_r1c1 : 0

matrix_r1c2 : 0

matrix_r2c0 : 0

matrix_r2c1 : 0

matrix_r2c2 : 0

output_bias_0 : 0

output_bias_1 : 0

output_bias_2 : 0

}

BGRX8888_U8转GRAY

aipp_op {

aipp_mode: static

input_format : XRGB8888_U8

csc_switch : true

rbuv_swap_switch : true

ax_swap_switch : false

matrix_r0c0 : 76

matrix_r0c1 : 150

matrix_r0c2 : 30

matrix_r1c0 : 0

matrix_r1c1 : 0

matrix_r1c2 : 0

matrix_r2c0 : 0

matrix_r2c1 : 0

matrix_r2c2 : 0

output_bias_0 : 0

output_bias_1 : 0

output_bias_2 : 0

}

YUV400_U8转GRAY

aipp_op {

aipp_mode: static

input_format : YUV400_U8

csc_switch : false

}

RGB888_U8转FP32 RGB

aipp_op {

aipp_mode: static

related_input_rank: 0

input_format : RGB888_U8

src_image_size_w : 640

src_image_size_h : 640

mean_chn_0 : 0

mean_chn_1 : 0

mean_chn_2 : 0

var_reci_chn_0 : 1.0

var_reci_chn_1 : 1.0

var_reci_chn_2 : 1.0

}

归一化配置说明¶

归一化就是要把需要处理的数据经过处理后限制在一定范围内,方便后面数据的处理。AIPP支持的归一化设置,通过减均值和乘系数的操作完成,这样的能力不仅能用于常规的归一化,还能用于不同数据格式的转化。

比如在由uint8转为fp16时,其转换可以视作如下公式。其中,mean_chn_i表示每个通道的均值,min_chn_i表示每个通道的最小值,var_reci_chn_i表示每个通道方差的倒数,各通道的这三个值都是需要进行配置的参数。

pixel_out_chx(i)=[pixel_in_chx(i)-mean_chn_i-min_chn_i]*var_reci_chn_i

Crop/Padding配置说明¶

原图大小为srcImageSizeW、srcImageSizeH的图像经过图像预处理后变为模型预期的dstImageSizeW、dstImageSizeH图像尺寸。

说明: 图中实线框表示当前图片size,虚线框表示经过右侧箭头上的AIPP操作处理后的图片size。

从执行角度看,我们需要在配置文件中指出裁剪的起始位置左上点坐标loadStartPosW、loadStartPosH以及裁剪后的图像大小crop_size_w、crop_size_h。在padding环节,我们需要指明在裁剪后的图像四周padding的尺寸,即left_padding_size、right_padding_size、top_padding_size和bottom_padding_size。而经过图像尺寸改变之后最终图片大小,需要跟模型文件输入的图像大小即**--input_shape**中的宽和高相等。

对于YUV420SP_U8图片类型,load_start_pos_w、load_start_pos_h参数必须配置为偶数。配置样例如下:

aipp_op {

aipp_mode: static

input_format: YUV420SP_U8

src_image_size_w: 320

src_image_size_h: 240

crop: true

load_start_pos_w: 10

load_start_pos_h: 20

crop_size_w: 50

crop_size_h: 60

padding: true

left_padding_size: 20

right_padding_size: 15

top_padding_size: 20

bottom_padding_size: 15

padding_value: 0

}

AIPP对模型输入大小的校验说明¶

如果有配置AIPP,无论静态AIPP还是动态AIPP,最终生成离线模型的输入大小(即input_size)均会被Crop、Padding等操作影响。本节给出对模型输入大小的约束说明。

假设模型的Batch数量为N(如果为动态batch场景,N为最大档位数的取值),模型输入图片的宽为src_image_size_w,高为src_image_size_h,最后模型输入的Size的计算公式如下所示。

静态AIPP对模型输入大小的校验

不支持该特性。

动态AIPP对模型输入大小的校验

不支持该特性。

如果为动态AIPP,模型转换时,ATC会为动态AIPP新增一个模型输入,用于接收模型推理阶段通过调用aclmdlSetInputAIPP接口后传入的AIPP参数,该场景下新增输入节点大小计算公式如下,接口详细说明请参见《AscendCL应用开发指南 (C&C++)》手册中的“acl API参考 > 模型管理 > 模型执行 > aclmdlSetInputAIPP”。

sizeof(kAippDynamicPara) - sizeof(kAippDynamicBatchPara) + batch_count * sizeof(kAippDynamicBatchPara)

kAippDynamicPara以及kAippDynamicBatchPara参数解释请参见动态AIPP的参数输入结构。

配置文件模板¶

AIPP配置文件通过本章节给出的模板进行配置,内容需要满足prototxt格式,用户根据场景决定配置哪些参数,修改为合适的取值另存后供模型转换使用;使用配置模板之前需要先查看相关约束。

模板使用整体约束

使用配置文件模板时,请将需要配置的参数去注释,并改为合适的值。

模板中参数取值都为默认值,实际使用时,如果配置文件中某些参数未配置,则模型转换时自动设置成该模板中相应参数的默认值。

静态AIPP场景下,input_format属性为必选属性,其余属性均为可选配置,如果未配置,则模型转换时自动设置成该模板中相应参数的默认值。

由于硬件处理逻辑的限制,配置文件中的参数有如下处理顺序要求:通道交换(rbuv_swap_switch)>图像裁剪(crop )> 色域转换(通道交换) > 数据减均值/归一化 > 图像边缘填充(padding)。

AIPP当前支持色域转换、图像裁剪、减均值、乘系数、通道交换、单行模式的能力,输入图片的类型仅支持RAW和UINT8格式。

若输入图片为RGB(由R、G、B三个分量组成的图片),其对应的输入、输出通道顺序,从高地址到低地址依次为:{R,G,B}。

动态AIPP的参数每次推理需要计算,计算需要耗时,所以动态AIPP的性能比静态AIPP性能要差。

经过AIPP处理后的图片,统一采用NC1HWC0的五维数据格式进行存储:

以原始模型要求的图片为RGB(由R、G、B三个分量组成的图片)为例进行说明,配置了AIPP功能场景下:

ONNX框架数据格式只能设置为NCHW(数据存储格式为RRRRRRGGGGGGBBBBBB)

TensorFlow框架数据格式只能设置为NHWC(数据存储格式为RGBRGBRGBRGBRGBRGB)或NCHW(数据存储格式为RRRRRRGGGGGGBBBBBB)。

实际提供的图片经过AIPP色域转换功能处理后,输出的离线模型中图片为RGB,并以NC1HWC0五维数据格式进行存储(关于NC1HWC0详细介绍请参见关键概念):若AIPP输出数据类型为FP16,则C0=16,从高位到低位依次为R,G,B,其余位数补0;C1=1。

模型转换是否开启AIPP功能,执行推理业务时,对输入图片数据的要求:

模型转换时开启AIPP:在进行推理业务时,输入图片数据要求为NHWC排布,该场景下最终与AIPP连接的输入节点的格式被强制改成NHWC,可能与模型转换命令中--input_format参数指定的格式不一致。

模型转换时没有开启AIPP:在进行推理业务时,模型的Format需与输入图片的Format保持一致。例如,输入图片的Format为NHWC,但某模型默认的Format为NCHW,此时输入图片和模型的Format不一致,用户可在模型转换时指定--input_format调整模型的Format,也可以选择符合模型要求的输入图片。

对于输入图像格式YUV420SP,根据UV分量顺序不同,YUV420SP又分为YUV420SP_UV(NV12)和YUV420SP_VU(NV21),分别对应色域转换配置说明中的YUV420SP_U8、YVU420SP_U8,默认为YUV420SP_UV(NV12)。

对于AIPP配置文件中的input_format参数,需始终配置为NV12格式(YUV420SP_U8),通过rbuv_swap_switch参数控制实际提供给AIPP的图片格式:

若rbuv_swap_switch设置为false,则实际提供的图片格式为YUV420SP_U8。

若rbuv_swap_switch设置为true,则实际提供的图片格式为YVU420SP_U8。

AIPP不同图像格式对应C轴取值约束。

表 1 不同图像格式对应C轴取值

AIPP的输入图像格式(input_format)

C轴取值

YUV420SP_U8

C=1

RGB888_U8

C=3

XRGB8888_U8

C=4

YUV400_U8

C=1

AIPP针对各种图像格式的典型参数配置如下表所示。

表 2 各种图像格式的典型参数配置

AIPP的输入图像格式(input_format)

输入图像内存排布格式

对应原始输入图像格式

AIPP输出格式

关于AIPP配置文件中相关参数的说明

RGB888_U8

NHWC

RGB package

NC1HWC0

rbuv_swap_switch通常设置为false

RGB888_U8

NHWC

BGR package

NC1HWC0

rbuv_swap_switch通常设置为true,内部先转为RGB package再做后续处理

YUV420SP_U8

/

YUV420 sp NV12 8bit

NC1HWC0

rbuv_swap_switch通常设置为false

YUV420SP_U8

/

YUV420 sp NV21 8bit

NC1HWC0

rbuv_swap_switch通常设置为true,内部先转为NV12格式再做后续处理

YUV400_U8

NHWC

灰度图

NC1HWC0

/

XRGB8888_U8

NHWC

- XRGB package

- XBGR package

- RGBX package

- BGRX package

NC1HWC0

- XRGB package

rbuv_swap_switch通常设置为false,ax_swap_switch通常设置为true

- XBGR package

rbuv_swap_switch通常设置为true,ax_swap_switch通常设置为true,内部先转为XRGB package再做后续处理

- RGBX package

rbuv_swap_switch通常设置为false,ax_swap_switch通常设置为false,内部先转为XRGB package再做后续处理

- BGRX package

rbuv_swap_switch通常设置为true,ax_swap_switch通常设置为false,内部先转为XRGB package再做后续处理

配置文件模板

# AIPP的配置以aipp_op开始,标识这是一个AIPP算子的配置,aipp_op支持配置多个

aipp_op {

#========================= 全局设置(start) ===========================================================================================================================================================

# aipp_mode指定了AIPP的模式,必须配置

# 类型:enum

# 取值范围:dynamic/static,dynamic表示动态AIPP,static表示静态AIPP

aipp_mode:

# related_input_rank参数为可选,标识对模型的第几个输入做AIPP处理,从0开始,默认为0。例如模型有两个输入,需要对第2个输入做AIPP,则配置related_input_rank为1。

# 类型:整型

# 配置范围 >= 0

related_input_rank: 0

#========================= 全局设置(end) =============================================================================================================================================================

#========================= 动态AIPP需设置,静态AIPP无需设置(start) ===================================================================================================================================

# 输入图像最大的size,动态AIPP必须配置(如果为动态batch场景,N为最大档位数的取值)

# 类型:int

max_src_image_size: 0

# 若输入图像格式为YUV420SP_U8,则max_src_image_size>=N * src_image_size_w * src_image_size_h * 1.5。

# 若输入图像格式为,则max_src_image_size>=N * src_image_size_w * src_image_size_h * 4。

# 若输入图像格式为RGB888_U8,则max_src_image_size>=N * src_image_size_w * src_image_size_h * 3。

# 是否支持旋转,保留字段,暂不支持该功能

# 类型:bool

# 取值范围:true/false,true表示支持旋转,false表示不支持旋转

support_rotation: false

#========================= 动态AIPP需设置,静态AIPP无需设置(end) =======================================================================================================================================

#========================= 静态AIPP需设置,动态AIPP无需设置(start)======================================================================================================================================

# 输入图像格式,必选

# 类型: enum

input_format:

# 说明:模型转换完毕后,在对应的om离线模型文件中,上述参数分别以枚举值呈现。

# 原始图像的宽度、高度

# 类型:int32

# 取值范围&约束:宽度取值范围为[2,4096]或0;高度取值范围为[1,4096]或0,对于YUV420SP_U8类型的图像,要求原始图像的宽和高取值是偶数

src_image_size_w: 0

src_image_size_h: 0

# 说明:请根据实际图片的宽、高配置src_image_size_w和src_image_size_h;只有crop,padding功能都没有开启的场景,src_image_size_w和src_image_size_h才能取值为0或不配置,该场景下会取网络模型输入定义的w和h,并且网络模型输入定义的w取值范围为[2,4096],h取值范围为[1,4096]。

# C方向的填充值,保留字段,暂不支持该功能

# 类型: float16

# 取值范围:[-65504, 65504]

cpadding_value: 0.0

#========= crop参数设置(配置样例请参见AIPP配置 > Crop/Padding配置说明) =========

# AIPP处理图片时是否支持抠图

# 类型:bool

# 取值范围:true/false,true表示支持,false表示不支持

crop: false

# 抠图起始位置水平、垂直方向坐标,抠图大小为网络输入定义的w和h

# 类型:int32

# 取值范围&约束: [0,4095]

# 说明:load_start_pos_w<src_image_size_w,load_start_pos_h<src_image_size_h

load_start_pos_w: 0

load_start_pos_h: 0

# 抠图后的图像size

# 类型:int32

# 取值范围&约束: [0,4096]、load_start_pos_w + crop_size_w <= src_image_size_w、load_start_pos_h + crop_size_h <= src_image_size_h

crop_size_w: 0

crop_size_h: 0

说明:若开启抠图功能,并且没有配置padding,该场景下crop_size_w和crop_size_h才能取值为0或不配置,此时抠图大小(crop_size[W|H])的宽和高取值来自模型文件--input_shape中的宽和高,并且--input_shape中的宽和高取值范围为[1,4096]。

# 抠图约束如下:

# 若input_format取值为其他值,对load_start_pos_w、load_start_pos_h无约束。

# 若开启抠图功能,则src_image_size[W|H] >= crop_size[W|H]+load_start_pos[W|H]。

#================================== resize参数设置 ================================

# AIPP处理图片时是否支持缩放

# 类型:bool

# 取值范围:true/false,true表示支持,false表示不支持

resize: false

# 缩放后图像的宽度和高度

# 类型:int32

# 取值范围&约束:resize_output_h:[16,4096]或0;resize_output_w:[16,1920]或0;resize_output_w/resize_input_w∈[1/16,16]、resize_output_h/resize_input_h∈[1/16,16]

resize_output_w: 0

resize_output_h: 0

# 说明:若开启了缩放功能,并且没有配置padding,该场景下resize_output_w和resize_output_h才能取值为0或不配置,此时缩放后图像的宽和高取值来自模型文件--input_shape中的宽和高,并且--input_shape中的高取值范围为[16,4096],宽取值范围为[16,1920]。

#======== padding参数设置(配置样例请参见AIPP配置 > Crop/Padding配置说明) =========

# AIPP处理图片时padding使能开关

# 类型:bool

# 取值范围:true/false,true表示支持,false表示不支持

padding: false

# H和W的填充值,静态AIPP配置

# 类型: int32

# 取值范围:[0,32]

left_padding_size: 0

right_padding_size: 0

top_padding_size: 0

bottom_padding_size: 0

# 说明:AIPP经过padding后,输出的H和W要与模型需要的H和W保持一致

# 上下左右方向上padding的像素取值,静态AIPP配置

# 类型:uint8/int8/float16

# 取值范围分别为:[0,255]、[-128, 127]、[-65504, 65504]

padding_value: 0

# 说明:该参数取值需要与最终AIPP输出图片的数据类型保持一致。

#================================ rotation参数设置 ==================================

# AIPP处理图片时的旋转角度,保留字段,暂不支持该功能

# 类型:uint8

# 范围:{0, 1, 2, 3} 0不旋转,1顺时针90°,2顺时针180°,3顺时针270°

rotation_angle: 0

#========= 色域转换参数设置(配置样例请参见AIPP配置 > 色域转换配置说明) =============

# 色域转换开关,静态AIPP配置

# 类型:bool

# 取值范围:true/false,true表示开启色域转换,false表示关闭

csc_switch: false

# R通道与B通道交换开关/U通道与V通道交换开关

# 类型:bool

# 取值范围:true/false,true表示开启通道交换,false表示关闭

rbuv_swap_switch :false

# RGBA->ARGB, YUVA->AYUV交换开关

# 类型:bool

# 取值范围:true/false,true表示开启,false表示关闭

ax_swap_switch: false

# 单行处理模式(只处理抠图后的第一行)开关,保留字段,暂不支持该功能

# 类型:bool

# 取值范围:true/false,true表示开启单行处理模式,false表示关闭

single_line_mode: false

# 若色域转换开关为false,则本功能不起作用。

# 若输入图片通道数为4,则忽略A通道或X通道。

# YUV转BGR:

# | B | | matrix_r0c0 matrix_r0c1 matrix_r0c2 | | Y - input_bias_0 |

# | G | = | matrix_r1c0 matrix_r1c1 matrix_r1c2 | | U - input_bias_1 | >> 8

# | R | | matrix_r2c0 matrix_r2c1 matrix_r2c2 | | V - input_bias_2 |

# BGR转YUV:

# | Y | | matrix_r0c0 matrix_r0c1 matrix_r0c2 | | B | | output_bias_0 |

# | U | = | matrix_r1c0 matrix_r1c1 matrix_r1c2 | | G | >> 8 + | output_bias_1 |

# | V | | matrix_r2c0 matrix_r2c1 matrix_r2c2 | | R | | output_bias_2 |

# 3*3 CSC矩阵元素

# 类型:int16

# 取值范围:[-32677 ,32676]

matrix_r0c0: 298

matrix_r0c1: 516

matrix_r0c2: 0

matrix_r1c0: 298

matrix_r1c1: -100

matrix_r1c2: -208

matrix_r2c0: 298

matrix_r2c1: 0

matrix_r2c2: 409

# RGB转YUV时的输出偏移

# 类型:uint8

# 取值范围:[0, 255]

output_bias_0: 16

output_bias_1: 128

output_bias_2: 128

# YUV转RGB时的输入偏移

# 类型:uint8

# 取值范围:[0, 255]

input_bias_0: 16

input_bias_1: 128

input_bias_2: 128

#============================== 减均值、乘系数设置 =================================

# 计算规则如下:

# 当uint8->uint8时,本功能不起作用

# 当uint8->fp16时,pixel_out_chx(i) = [pixel_in_chx(i) – mean_chn_i – min_chn_i] * var_reci_chn_i

# 每个通道的均值

# 类型:uint8

# 取值范围:[0, 255]

mean_chn_0: 0

mean_chn_1: 0

mean_chn_2: 0

mean_chn_3: 0

# 每个通道的最小值

# 类型:float16

# 取值范围:[0, 255]

min_chn_0: 0.0

min_chn_1: 0.0

min_chn_2: 0.0

min_chn_3: 0.0

# 每个通道方差的倒数

# 类型:float16

# 取值范围:[-65504, 65504]

var_reci_chn_0: 1.0

var_reci_chn_1: 1.0

var_reci_chn_2: 1.0

var_reci_chn_3: 1.0

#========================= 静态AIPP需设置,动态AIPP无需设置(end)=====================================================================================================================================

}

典型场景样例参考¶

YUV400_U8转GRAY格式¶

场景说明:

AIPP输入图像格式为YUV400_U8、输出图像格式为GRAY,输入图像尺寸为224*224,有效数据区域从左上角(0, 0)像素开始;原始网络模型的C=1,H和W均为220。

该场景下涉及以下AIPP配置:

开启抠图功能参数crop;

抠图起始位置水平、垂直方向坐标load_start_pos_h、load_start_pos_w为0;

无需配置crop_size_w和crop_size_h参数,此时抠图大小(crop_size[W|H])的宽和高取值来自模型转换时**--input_shape**参数中的宽和高,将从(0, 0)点开始选取220*220区域的数据;

无需配置色域转换开关csc_switch,并且对于同一个原始网络模型,如果AIPP输入的是YUV420SP_U8图像,则可以使用同一套AIPP配置,即只取了Y通道的数据。

AIPP配置文件示例如下:

aipp_op{ aipp_mode: static csc_switch: false crop: true input_format: YUV400_U8 load_start_pos_h: 0 load_start_pos_w: 0 src_image_size_w: 224 src_image_size_h: 224 # 归一化系数需要根据用户模型实际需求配置,如下所列常见值仅作为示例 mean_chn_0: 128 min_chn_0: 0.0 var_reci_chn_0: 0.00390625 }

YUV420SP_U8转BGR格式¶

场景说明:

AIPP输入图像格式为YUV420SP_U8(NV12)、输出图像格式为BGR,输入图像尺寸为256*256;原始网络模型的C=3,H和W与AIPP输入图像尺寸相同。

该场景涉及以下AIPP配置:

无需配置抠图功能参数crop;

需要配置色域转换开关csc_switch和相应的CSC矩阵参数。

AIPP配置文件示例如下:

aipp_op { aipp_mode: static input_format: YUV420SP_U8 csc_switch: true # 如果输入的是YVU420SP_U8(NV21)图像,则需要将rbuv_swap_switch参数设置为true rbuv_swap_switch: false related_input_rank: 0 src_image_size_w: 256 src_image_size_h: 256 crop: false matrix_r0c0: 298 matrix_r0c1: 516 matrix_r0c2: 0 matrix_r1c0: 298 matrix_r1c1: -100 matrix_r1c2: -208 matrix_r2c0: 298 matrix_r2c1: 0 matrix_r2c2: 409 input_bias_0: 16 input_bias_1: 128 input_bias_2: 128 # 归一化系数需要根据用户模型实际需求配置,如下所列常见值仅作为示例 # 归一化系数应用于色域转换和通道交换之后的通道 mean_chn_0: 104 mean_chn_1: 117 mean_chn_2: 123 min_chn_0: 0.0 min_chn_1: 0.0 min_chn_2: 0.0 var_reci_chn_0: 1.0 var_reci_chn_1: 1.0 var_reci_chn_2: 1.0 }

RGB888_U8转RGB(或BGR)格式¶

场景说明:

AIPP输入图像格式为RGB888_U8、输出图像格式为RGB,输入图像尺寸为250*250,有效数据区域从左上角(0, 0)像素开始;原始网络模型的C=3,H和W均为240。

该场景下涉及以下AIPP配置:

开启抠图功能参数crop;

抠图起始位置水平、垂直方向坐标load_start_pos_h、load_start_pos_w为0;

无需配置crop_size_w和crop_size_h参数,此时抠图大小(crop_size[W|H])的宽和高取值来自模型转换时**--input_shape**参数中的宽和高,将从(0, 0)点开始选取240*240区域的数据;

无需配置通道交换开关参数rbuv_swap_switch、色域转换开关参数csc_switch和CSC矩阵参数。

AIPP配置文件示例如下:

aipp_op { aipp_mode: static input_format: RGB888_U8 csc_switch: false related_input_rank: 0 src_image_size_w: 250 src_image_size_h: 250 crop: true load_start_pos_w: 0 load_start_pos_h: 0 # 如果原始模型需要的是BGR格式,则需要将rbuv_swap_switch参数设置为true rbuv_swap_switch: false # 归一化系数需要根据用户模型实际需求配置,此处取默认值,即不改变像素的值 # 若配置归一化系数,将应用于通道交换之后的通道 }

单算子模型转换**(该版本不支持单算子特性)**¶

本节给出单算子描述文件转成离线模型的详细步骤。

什么是单算子描述文件¶

单算子描述文件是基于Ascend IR定义的单个算子的定义文件,包括算子的输入、输出及属性等信息,借助该文件转换成适配昇腾AI处理器的离线模型适配NPU IP加速器的离线模型后,可以验证单算子的功能。

单算子描述文件是由OpDesc数组构成的JSON文件,参数构成以及解释如下:

表 1 OpDesc参数说明

属性名 |

类型 |

说明 |

是否必填 |

|---|---|---|---|

compile_flag |

INT32 |

该参数废弃,不建议使用,后续版本将会删除。 编译类型。取值如下:

默认值为0。 使用约束:当前仅支持transformer网络模型涉及的算子。 |

否 |

op |

string |

算子类型。 |

是 |

name |

string |

单算子模型文件的名称。 如果不设置name参数,则模型文件名的命名规则默认为:序号_算子类型_输入的描述(dataType_format_shape)_输出的描述(dataType_format_shape),例如,0_Add_3_2_3_3_3_2_3_3_3_2_3_3.om。 dataType以及format对应枚举值请从${INSTALL_DIR}/include/graph/types.h文件中查看,枚举值依次递增。其中,${INSTALL_DIR}请替换为CANN软件安装后文件存储路径。以root安装举例,安装后文件默认存储路径为:/usr/local/Ascend/latest。 |

否 |

input_desc |

TensorDesc数组 |

算子输入描述。 |

是 |

output_desc |

TensorDesc数组 |

算子输出描述。 |

是 |

attr |

Attr数组 |

算子属性。 |

否 |

表 2 TensorDesc数组参数说明

属性名 |

类型 |

说明 |

|---|---|---|

dynamic_input |

string |

可选。动态输入,取值必须和算子信息库中该算子定义的输入name相同。 该参数用于设置算子动态输入的分组与动态输入的个数,例如算子原型定义中某算子的动态输入为: .DYNAMIC_INPUT(x,...) .DYNAMIC_INPUT(y,...) 则表示动态输入有两组,分别为x,y。每一组的输入个数,根据dynamic_input的个数确定。具体设置原则可以参见TensorDesc数组中name参数的说明。

|

format |

string |

必填。Tensor计算过程中实际使用的格式,又称运行时格式,对应Device上计算使用的格式。 当前支持的Format格式以及对应的枚举如下:

模型转换完毕,上述Format在对应om离线模型文件名中以对应的枚举呈现,例如若输入为NHWC格式,则展示为1。 |

origin_format |

string |

可选。Tensor输入时的原始格式,指未经任何转换的原始图像格式。 不带此字段时,默认Tensor计算过程中使用的Format与原始Format一致。 |

name |

string |

可选。Tensor的名称。算子的输入为动态输入时,需要设置该字段。 该参数用于设置每一组动态输入中,具体输入的名称,每一个输入名称为算子原型中定义的输入名称+编号,编号根据dynamic_input的个数确定,从0开始依次递增。

|

shape |

int数组 |

必填。Tensor计算过程中实际使用的Shape,例如[1, 224, 224, 3],实际Shape乘积不能超过int32最大值(2147483647)。

|

origin_shape |

string |

可选。Tensor输入时的原始Shape。 不带此字段时,默认Tensor计算过程中使用的Shape与原始Shape一致。 |

type |

string |

必填。Tensor的数据类型,支持的type以及对应的枚举如下:

模型转换完毕,上述type在对应om离线模型文件名中以对应的枚举呈现,例如若输入为int8类型,则展示为2。 |

shape_range |

int[2]数组 |

可选。Shape为动态时(不包括-2场景),unknow shape的取值范围。 例如,若Shape取值为[16,-1,20,-1]:其中的-1表示unknow shape。 shape_range取值为[1,128],[1,-1]:[1,128]表示从1到128的取值范围,对应Shape参数中第一个-1;[1,-1]表示从1到无穷大的取值范围,对应Shape参数中第二个-1。 |

is_const |

bool |

可选,表示输入是否为常量:

|

const_value |

list |

可选,常量取值。 当前仅支持一维list配置,list中具体配置个数由Shape取值决定。例如,Shape取值为2,则const_value中列表个数为2。 取值类型由type决定,假设type取值为float16,则单算子编译时会自动将const_value中的取值转换为float16格式的取值。 |

表 3 Attr数组参数说明

属性名 |

类型 |

说明 |

|---|---|---|

name |

string |

必填。属性名。 |

type |

string |

必填。属性值的类型,支持的类型有:

|

value |

由type的取值决定 |

必填。属性值,根据type不同,属性值不同,举例如下:

|

配置文件样例¶

不同输入或者不同Format场景,单算子描述文件配置不同,本章节给出各场景的配置示例。 描述文件支持定义多组算子JSON文件配置,一组配置包括算子类型、算子输入和输出信息、视算子情况决定是否包括属性信息。 动态Shape场景,单算子描述文件根据场景不同,内容也有差异,本章节就给出不同场景下的配置样例。

单算子描述文件配置¶

不同输入或者不同Format场景,单算子描述文件配置不同,本章节给出各场景的配置示例。

本章节中的单算子是基于Ascend IR定义的,描述文件为JSON格式。关于JSON描述文件中各参数的解释请参见表1,关于单算子的Ascend IR定义请参见《AOL算子加速库接口参考》 >“CANN算子规格说明” 。

Format为ND:

该示例中的单算子转换后的离线模型为:add.om

[ { "op": "Add", "name": "add", "input_desc": [ { "format": "ND", "shape": [3,3], "type": "int32" }, { "format": "ND", "shape": [3,3], "type": "int32" } ], "output_desc": [ { "format": "ND", "shape": [3,3], "type": "int32" } ] } ]

Format为NCHW:

该示例中的单算子转换后的离线模型为:conv2d.om

[ { "op": "Conv2D", "name": "conv2d", "input_desc": [ { "format": "NCHW", "shape": [1, 3, 16, 16], "type": "float16" }, { "format": "NCHW", "shape": [3, 3, 3, 3], "type": "float16" } ], "output_desc": [ { "format": "NCHW", "shape": [1, 3, 16, 16], "type": "float16" } ], "attr": [ { "name": "strides", "type": "list_int", "value": [1, 1, 1, 1] }, { "name": "pads", "type": "list_int", "value": [1, 1, 1, 1] }, { "name": "dilations", "type": "list_int", "value": [1, 1, 1, 1] } ] } ]

Tensor计算过程中使用的Format与原始Format不同

ATC模型转换时,会将origin_format与origin_shape转成离线模型需要的format与shape。

该示例中的单算子转换后的离线模型为:add.om

[ { "op": "Add", "name": "add", "input_desc": [ { "format": "NC1HWC0", "origin_format": "NCHW", "shape": [8, 1, 16, 4, 16], "origin_shape": [8, 16, 16, 4], "type": "float16" }, { "format": "NC1HWC0", "origin_format": "NCHW", "shape": [8, 1, 16, 4, 16], "origin_shape": [8, 16, 16, 4], "type": "float16" } ], "output_desc": [ { "format": "NC1HWC0", "origin_format": "NCHW", "shape": [8, 1, 16, 4, 16], "origin_shape": [8, 16, 16, 4], "type": "float16" } ] } ]

输入指定为常量

该场景下,支持设置为常量的输入,新增is_const和const_value两个参数,分别表示是否为常量以及常量取值,const_value当前仅支持一维list配置,具体配置个数由shape取值决定,例如,如下样例中shape为2,则const_value中列表个数为2;const_value中取值类型由type决定,假设type取值为float16,则单算子编译时会自动将const_value中的取值转换为float16格式的取值。

该示例中的单算子转换后的离线模型为:resizeBilinearV2.om

[ { "op": "ResizeBilinearV2", "name": "resizeBilinearV2", "input_desc": [ { "format": "NHWC", "name": "x", "shape": [ 4, 16, 16, 16 ], "type": "float16" }, { "format": "NHWC", "is_const": true, "const_value": [49, 49], "name": "size", "shape": [ 2 ], "type": "int32" } ], "output_desc": [ { "format": "NHWC", "name": "y", "shape": [ 4, 48, 48, 16 ], "type": "float" } ], "attr": [ { "name": "align_corners", "type": "bool", "value": false }, { "name": "half_pixel_centers", "type": "bool", "value": false } ] } ]

可选输入(optional input):

当存在可选输入,且可选输入没有输入数据时,则必须将可选输入的format配置为RESERVED,同时将type配置为UNDEFINED;若可选输入有输入数据时,则按其输入数据的format、type配置即可。

该示例中的单算子转换后的离线模型为:matMulV2.om

[ { "op": "MatMulV2", "name": "matMulV2", "input_desc": [ { "format": "ND", "shape": [16, 16], "type": "float" }, { "format": "ND", "shape": [16, 16], "type": "float" }, { "format": "RESERVED", "shape": [], "type": "UNDEFINED" }, { "format": "RESERVED", "shape": [], "type": "UNDEFINED" } ], "attr": [ { "name": "transpose_x1", "type": "bool", "value": false }, { "name": "transpose_x2", "type": "bool", "value": false } ], "output_desc": [ { "format": "ND", "shape": [16, 16], "type": "float" } ] } ]

输入个数不确定(动态输入场景):

该场景下,单算子的输入个数不确定。此处以AddN单算子为例。该示例中的单算子转换后的离线模型为:addN.om

构造的单算子JSON文件使用动态输入dynamic_input参数,而不使用Tensor的名称name参数。

该场景下算子的dynamic_input取值必须和算子信息库中该算子定义的输入name的取值相同。具体设置几个输入,由AddN单算子描述文件属性参数中N的取值决定,用户可以自行修改输入的个数,但是必须和属性中N的取值匹配。(该说明仅针对AddN算子生效,其他动态输入算子的约束以具体算子为准。)

[ { "op": "AddN", "name": "addN", "input_desc": [ { "dynamic_input": "x", "format": "NCHW", "shape": [1,3,166,166], "type": "float32" }, { "dynamic_input": "x", "format": "NCHW", "shape": [1,3,166,166], "type": "int32" }, { "dynamic_input": "x", "format": "NCHW", "shape": [1,3,166,166], "type": "float32" } ], "output_desc": [ { "format": "NCHW", "shape": [1,3,166,166], "type": "float32" } ], "attr": [ { "name": "N", "type": "int", "value": 3 } ] } ]

构造的单算子JSON文件使用Tensor的名称name参数,而不使用动态输入dynamic_input参数。

该场景下算子的name取值必须和算子原型定义中算子的输入名称相同,根据输入的个数自动生成x0、x1、x2……。具体设置几个Tensor名称,由AddN单算子描述文件属性参数中N的取值决定,用户可以自行修改Tensor名称的个数,但是必须和属性中N的取值匹配,例如N取值为3,则name取值分别设置为x0、x1、x2。(该说明仅针对AddN算子生效,其他动态输入算子的约束以具体算子为准。)

[ { "op": "AddN", "name": "addN", "input_desc": [ { "name":"x0", "format": "NCHW", "shape": [1,3,166,166], "type": "float32" }, { "name":"x1", "format": "NCHW", "shape": [1,3,166,166], "type": "int32" }, { "name":"x2", "format": "NCHW", "shape": [1,3,166,166], "type": "float32", } ], "output_desc": [ { "format": "NCHW", "shape": [1,3,166,166], "type": "float32" } ], "attr": [ { "name": "N", "type": "int", "value": 3 } ] } ]

多组算子描述文件配置¶

描述文件支持定义多组算子JSON文件配置,一组配置包括算子类型、算子输入和输出信息、视算子情况决定是否包括属性信息。

如果JSON文件配置了多组算子,则模型转换完成后,会生成多组算子对应的om离线模型文件。如下配置文件只是样例,请根据实际情况进行修改。

[

{

"op": "MatMul",

"name": "matMul01",

"input_desc": [

{

"format": "ND",

"shape": [

16,

16

],

"type": "float16"

},

... ...

],

"output_desc": [

{

"format": "ND",

"shape": [

16,

16

],

"type": "float16"

}

],

"attr": [

{

"name": "alpha",

"type": "float",

"value": 1.0

},

... ...

]

},

{

"op": "MatMul",

"name": "matMul02",

"input_desc": [

{

"format": "ND",

"shape": [

256,

256

],

"type": "float16"

},

... ...

],

"output_desc": [

{

"format": "ND",

"shape": [

256,

256

],

"type": "float16"

}

],

"attr": [

{

"name": "alpha",

"type": "float",

"value": 1.0

},

... ...

]

}

]

动态Shape单算子描述文件配置¶

动态Shape场景,单算子描述文件根据场景不同,内容也有差异,本章节就给出不同场景下的配置样例。

模型编译时不指定Shape,模型执行时根据输入静态Shape,能推导出具体输出Shape:

[ { "op": "Add", "name": "add", "input_desc": [ { "format": "ND", "shape": [-1,16], "shape_range": [[0, 32]], "type": "int64" }, { "format": "ND", "shape": [-1,16], "shape_range": [[0, 32]], "type": "int64" } ], "output_desc": [ { "format": "ND", "shape": [-1,16], "shape_range": [[0,32]], "type": "int64" } ] } ]

模型编译时不指定Shape,模型执行时根据输入静态Shape和常量,能推导出具体输出Shape:

[ { "op": "TopK", "name": "topK", "input_desc": [ { "format": "ND", "shape": [-1], "shape_range": [[1,-1]], "type": "int32" }, { "format": "ND", "shape": [], #推理时会传入常量 "type": "int32" } ], "output_desc": [ { "format": "ND", "shape": [-1], "shape_range": [[1,-1]], "type": "int32" }, { "format": "ND", "shape": [-1], "shape_range": [[1,-1]], "type": "int32" }], "attr": [ { "name": "sorted", "type": "bool", "value": true } ] } ]

模型编译时不指定Shape,模型执行时根据输入静态Shape,无法得到算子的准确输出Shape,但可以得到输出Shape的范围。

该场景下在输出参数output_desc中将算子输出TensorDesc中Shape为动态维度的纬度值记为“-1”,并对其“-1”的维度给出shape_range取值范围:

[ { "op": "Where", "name": "where", "input_desc": [ { "format": "ND", "shape": [-1], "shape_range": [[1,-1]], "type": "int32" } ], "output_desc": [ { "format": "ND", "shape": [-1, 1], "shape_range": [[1,-1]], "type": "int64" } ] } ]

如何将算子描述文件转成离线模型¶

本节给出单算子描述文件转成离线模型的详细步骤。

参见什么是单算子描述文件中的参数解释以及配置文件样例构造单算子描述文件。本章节以构造format为ND的Add单算子add.json为例进行说明。

以CANN软件包运行用户,将步骤1构造的单算子描述文件上传到开发环境任意目录,例如_$HOME/singleop/_目录下。

执行如下命令生成离线模型。(如下命令中使用的目录以及文件均为样例,请以实际为准)

atc --singleop=$HOME/singleop/add.json --output=$HOME/singleop/out/op_model --soc_version=<soc_version>--singleop:用于指定_add.json_单算子描述文件。

--output:转换后的离线模型存放路径。

--soc_version:NPU IP加速器的型号。

关于参数的详细解释请参见参数说明。

若提示如下信息,则说明模型转换成功。若模型转换失败,请参见《故障处理》> “错误码参考”章节进行辅助定位。

ATC run success, welcome to the next use.成功执行命令后,在output参数指定的路径下,可查看离线模型文件*.om。

参数说明¶

使用ATC工具转换模型之前,首先查看使用工具过程中的一些限制,然后借助本章节提供的参数概览功能,可以快速预览相关参数。

参数概览¶

使用ATC工具转换模型之前,首先查看使用工具过程中的一些限制,然后借助本章节提供的参数概览功能,可以快速预览相关参数。

总体约束

在进行模型转换前,请务必查看如下约束要求:

支持原始框架类型为TensorFlow(IPV035不支持)、MindSpore(IPV035不支持)、ONNX的模型转换:

当原始框架类型为MindSpore(IPV035不支持)、ONNX时,输入数据类型为FP32(IPV035不支持)、FP16、UINT8(通过配置数据预处理--insert_op_conf实现)。

当原始框架类型为TensorFlow(IPV035不支持)时,输入数据类型为FP16、FP32、UINT8、INT32、INT64、BOOL。

模型中的所有层算子除const算子外,输入和输出需要满足dim!=0。

只支持《AOL算子加速库接口参考》>“CANN算子规格说明”中的算子,并需满足算子限制条件。

由于软件约束(动态shape场景下暂不支持输入数据为DT_INT8),量化后的部署模型使用ATC工具进行模型转换时,不能使用动态shape相关参数,例如--dynamic_batch_size和--dynamic_image_size等,否则模型转换会失败。

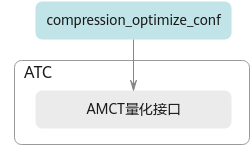

使用AMCT工具量化后的部署模型,使用ATC工具进行模型转换时,不能再使用高精度特性,比如不能再通过--precision_mode参数配置force_fp32或must_keep_origin_dtype(原图fp32输入);不能再通过--precision_mode_v2参数配置origin;不能通过--op_precision_mode配置high_precision参数等。在高精度模式下设置量化参数,既拿不到量化的性能收益,也拿不到高精度模式的精度收益。

参数概览

须知:

如果通过atc --help命令查询出的参数未解释在表1,则说明该参数预留或适用于其他产品,用户无需关注。

使用atc命令进行模型转换时,命令有两种方式,用户根据实际情况进行选择,本手册以选择第一种方式为例进行说明:

atc param1=value1 param2=value2 ...(value值前面不能有空格,否则会导致截断,param取的value值为空)

atc param1 value1 param2 value2 ...

使用ATC参数时,参数名支持以**--作为前缀(例如--help),也支持以-作为前缀(例如-help),当使用-作为前缀时,在执行atc命令时,会自动转换为--。本文的参数名均以--**前缀为例。

使用ATC参数时,参数名称支持以下划线连接两个字符串(例如soc_version),也支持以中划线连接两个字符串(例如soc-version)。本文的参数名称均以下划线连接两个字符串(例如soc_version)为例。

表1中的“是否必选”列,需要根据--mode取值具体区分。

表 1 ATC参数概览

ATC参数名称 |

参数简述(具体说明见参数描述章节) |

是否必选(--mode=0或3时) |

默认值 |

|---|---|---|---|

--help或--h |

显示帮助信息。 |

否 |

不涉及 |

--mode |

运行模式。 |

否 |

0 |

--framework |

原始框架类型。 |

是 |

不涉及 |

--model |

原始模型文件路径与文件名。 |

是 |

不涉及 |

--weight |

权重文件路径与文件名。 |

否 |

不涉及 |

--input_format |

输入数据格式。 |

否 |

MindSpore、ONNX默认为NCHW;TensorFlow默认为NHWC |

--input_shape |

模型输入数据的shape。 |

否 |

不涉及 |

--dynamic_batch_size |

设置动态batch档位参数,适用于执行推理时,每次处理图片数量不固定的场景。 |

否 |

不涉及 |

--dynamic_image_size |

设置输入图片的动态分辨率参数。适用于执行推理时,每次处理图片宽和高不固定的场景。 |

否 |

不涉及 |

--dynamic_dims |

设置ND格式下动态维度的档位。适用于执行推理时,每次处理任意维度的场景。 |

否 |

不涉及 |

--om |

需要转换为JSON格式的离线模型或原始模型文件的路径和文件名。 |

否 |

不涉及 |

--singleop |

单算子定义文件,将单个算子JSON文件转换成适配NPU IP加速器的离线模型。 |

否 |

不涉及 |

--output |

|

是 |

不涉及 |

--output_type |

指定网络输出数据类型或指定某个输出节点的输出类型。 |

否 |

不涉及 |

--check_report |

预检结果保存文件路径和文件名。 |

否 |

执行atc命令当前路径生成check_result.json |

--json |

离线模型或原始模型文件转换为JSON格式文件的路径和文件名。 |

否 |

不涉及 |

--host_env_os |

若模型编译环境的操作系统及其架构与模型运行环境不一致时,则需使用本参数设置模型运行环境的操作系统类型。 |

否 |

执行atc --help命令查看“--host_env_os”参数的默认值或查看${INSTALL_DIR}/opp/scene.info文件中的取值 |

--host_env_cpu |

若模型编译环境的操作系统及其架构与模型运行环境不一致时,则需使用本参数设置模型运行环境的操作系统架构。 |

否 |

执行atc --help命令查看“--host_env_cpu”参数的默认值或查看${INSTALL_DIR}/opp/scene.info文件中的取值 |

--soc_version |

模型转换时指定芯片版本。 |

是 |

不涉及 |

--aicore_num |

设置模型编译时使用的aicore数目。 |

否 |

默认值为最大值 |

--out_nodes |

指定输出节点。 |

否 |

不涉及 |

--input_fp16_nodes |

指定输入数据类型为FP16的输入节点名称。 |

否 |

不涉及 |

--insert_op_conf |

插入算子的配置文件路径与文件名,例如aipp预处理算子。 |

否 |

不涉及 |

--external_weight |

生成om离线模型时,是否将原始网络中的Const/Constant节点的权重保存在单独的文件中,同时将节点类型转换为FileConstant类型。 |

否 |

0 |

--op_name_map |

扩展算子(非标准算子)映射配置文件路径和文件名,不同的网络中某扩展算子的功能不同,可以指定该扩展算子到具体网络中实际运行的扩展算子的映射。 |

否 |

不涉及 |

--is_input_adjust_hw_layout |

用于指定网络输入数据类型是否为FP16,数据格式是否为NC1HWC0。 |

否 |

false |

--is_output_adjust_hw_layout |

用于指定网络输出的数据类型是否为FP16,数据格式是否为NC1HWC0。 |

否 |

false |

--buffer_optimize |

是否开启数据缓存优化。 |

否 |

l2_optimize |

--disable_reuse_memory |

内存复用开关。 |

否 |

0 |

--enable_scope_fusion_passes |

指定编译时需要生效的融合规则列表。 |

否 |

不涉及 |

--fusion_switch_file |

融合开关配置文件路径以及文件名。 |

否 |

不涉及 |

--enable_small_channel |

是否使能small channel的优化,使能后在channel<=4的首层卷积会有性能收益。 |

否 |

0 |

--quant_dumpable |

是否采集量化算子的dump数据。 |

否 |

0 |

--compression_optimize_conf |

压缩优化功能配置文件路径以及文件名。 |

否 |

不涉及 |